大.家好。今天咱们不聊车的外.观内饰,我想.聊.点最近特别火的——自动驾驶大模型。就是那种号称“能自.己理解交通”的AI,说白了,它要学会开车,首先得看够“好片.子”,也就是靠海量.的训练数据。那这个数据到底.有什么.讲.究?我这两天研究.了一.下,跟大.家掰扯掰扯。

先.说.最显眼的——数据质.量。大模型不.像咱刷视频那种凑数量,它要的是精准、丰富、有代表.性的.场.景。比如暴.雨夜里逆光有水花的街道、无人区乱窜的动物、十.字路口那.种鬼探头……这些都得录下来、标好、喂.给算法。听起来像.搞科研,其实就.像开车慢动作回放,一.帧一帧教它“这时候人该怎么反应”。很多人以.为光堆视频量就行,其实不行,垃圾数.据越多,模.型越蠢。我看头.部厂商现在都提“以.质取胜”,不.追.求上亿张图,而是要每个标得准、标得细。

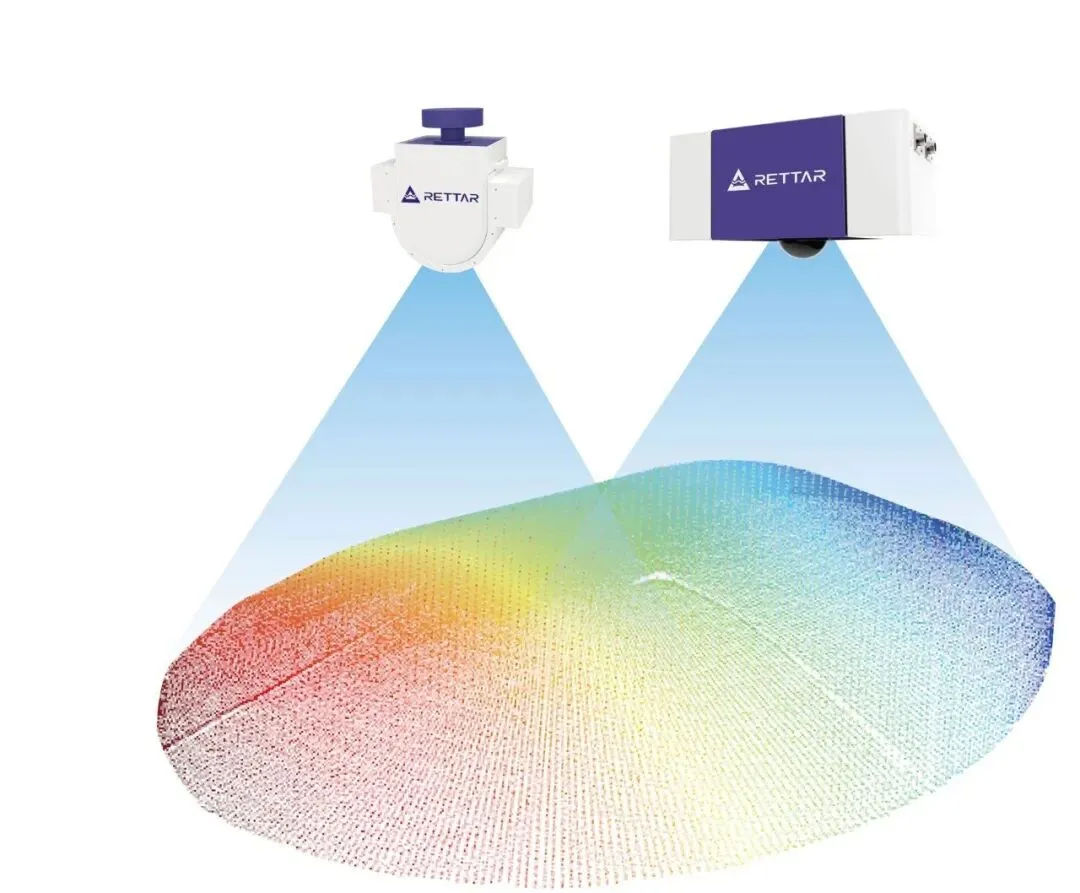

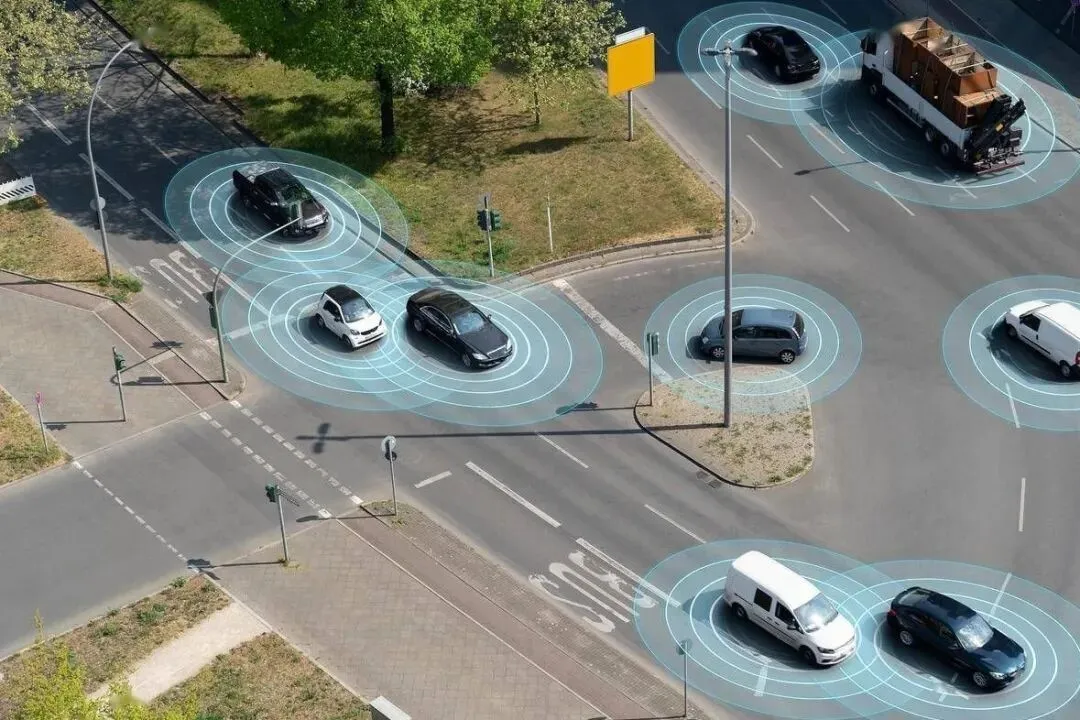

然.后是多模.态数据.融合。这词有点.玄,我简单说:车.不光.要看,还要“听”“感知”。摄像头.负责图像,激光雷达画出3D轮廓,毫米.波雷达补盲.区,GPS给位置。它.们都要同步,一帧.对.一帧,错一点点都可能让.模型“懵圈”。打个比方吧,就.像我.盯着.仪表转速在升,但耳朵听到发动机没变声——一个假信号就会出大事。现在很多厂商都在搞视觉+语言模型,比如DriveGPT4,就.能用视频加文.本训练,你说“慢点靠右”,模型就学会对应.动.作。

说到这我就想起那次试驾智己的车,导航区有块限时通行的地砖字,它识别半天.才反应过来,这就.是文字级别的标注没做.到位。自动驾.驶大模型要识别的不只.是障碍物,还有文字提示、交通标.识,甚至广告牌反光的误识别,这些细节都得.靠数据打磨。还.有一.点特.别关键——长尾场景。你平.时遇不到.的情.况,AI更要见识。比如前车突然掉物、人行横道跑.出小孩,这.类“稀有.事件”越多,模型学得越灵。

标注.这活儿真是累,一般流程是AI先.标一.遍,人再精修,专.家再复核。不.信你.去看,那一.帧帧画小框框,人和车、影子和反光都要分开标。稍.有错位,训练出.来的模型开车.就像神.游。还有厂商提“边缘计算实时标.注”,也就是车.上边跑边学,直接把标过的数据回传云端,这种.闭环效率特别高。

最.后我.想说.的是合规问题。这几年国家在强调数据安全,特别是.带人脸、车牌的.那种素材,必.须脱敏。还有就是要可追溯,你不能拿来路不.明.的数据.去训.练。现.在大家都讲“数据飞轮”,意思是模型跑.得越多,反.馈越多,这些新数据反过来又能让它变聪明。我觉.得这跟.我们调试车挺像——跑得越.多,问.题越清楚,改得越准。

总结一下.啊,自动驾驶大模型的.训练数据要高质量、多模态、长.尾.充分、标注严谨、合规安全。这.五.个词看着简单,背后是几百万.人次的采集和几千万帧的标注。我个人感觉,这就是AI版的“筑路工程”,表面.飘在云.端,其实.脚踩泥地。就像我.开.车那样,算法再.聪明,也离不开一次.次真实路测的数据打磨。

行.吧,今.天就先.聊到这。下次有机会我带大家看看真实的自.动驾驶测试场.景,看看.它到.底聪明到什么程度。文章写.作不易,还望大.家多多支持,点赞评论收藏一.下,感谢大家。