基于端到端神经网络的自动驾驶系统迁移至 具身智能的研究

20260306

——以Tesla FSD v12系统为例探讨类人机器人技术演进路径

摘要

Tesla FSD v12系统采用端到端神经网络架构,实现了从原始传感器输入到控制输出的直接映射,代表了自动驾驶技术范式的重大转变。本文探讨将该系统的核心技术架构迁移至具身智能领域的可行性及技术路径。研究表明,FSD v12的视觉感知、场景理解、决策规划等核心能力与具身机器人的感知-认知-执行闭环具有高度同构性。通过适当的域适应(Domain Adaptation)和迁移学习(Transfer Learning),FSD v12的技术框架有望催生新一代具备强泛化能力的类人机器人。本文系统分析了技术迁移的关键挑战、解决方案及预期技术突破。

一、引言

具身智能(Embodied Intelligence)作为人工智能领域的前沿方向,强调智能体通过物理身体与环境交互实现认知能力的涌现。类人机器人作为具身智能的重要载体,其核心挑战在于实现鲁棒的感知、灵活的决策和精准的执行三者的有机统一。

Tesla公司于2023年底发布的FSD v12系统,采用纯视觉方案和端到端神经网络架构,摒弃了传统自动驾驶系统中的人工设计规则,实现了从原始图像输入到车辆控制输出的端到端学习。这一技术范式的突破,为具身智能领域提供了新的技术参照。

本文旨在探讨FSD v12系统核心技术向具身机器人领域迁移的理论基础、技术路径及预期影响,为新一代类人机器人的研发提供学术参考。

二、FSD v12系统的技术架构分析

2.1 端到端神经网络架构

FSD v12系统的核心创新在于采用端到端(End-to-End)神经网络架构。与传统自动驾驶系统的模块化设计不同,端到端架构直接学习从原始传感器输入到控制输出的映射关系,避免了中间模块间的误差累积问题。

该架构基于深度神经网络,输入为多摄像头采集的原始图像序列,输出为车辆的方向盘转角、加速踏板和制动踏板的控制信号。网络通过大规模真实驾驶数据进行监督学习,自动提取与驾驶决策相关的视觉特征,无需人工设计特征工程。

从信息论角度,端到端架构实现了从高维视觉空间到低维控制空间的最优压缩映射。网络内部隐式地完成了目标检测、场景分割、轨迹预测、行为规划等传统模块的功能,但这些功能的实现是通过数据驱动的方式自动习得的。

2.2 视觉感知与场景理解

FSD v12采用纯视觉方案,通过8个摄像头实现360度环境感知。系统利用神经网络从2D图像中重建3D场景信息,包括道路几何结构、交通参与者位置、可行驶区域等。

该系统的视觉感知能力基于大规模预训练的视觉基础模型(Vision Foundation Model)。通过在海量驾驶视频数据上的自监督学习,模型习得了丰富的视觉表征能力,能够泛化到各种复杂场景。

场景理解方面,FSD v12能够识别并理解道路标志、交通信号灯、行人意图、车辆行为等语义信息。这种理解能力是通过端到端学习隐式获得的,而非通过显式的规则编码。

2.3 决策规划与控制执行

FSD v12的决策规划模块采用神经网络直接输出控制指令。系统通过模仿学习(Imitation Learning)从人类驾驶员的行为中学习驾驶策略,实现了类人的驾驶决策。

控制执行方面,系统输出连续的控制信号,实现了平滑的车辆操控。这种端到端的控制方式避免了传统系统中规划与控制之间的接口问题,提高了系统的整体性能。

图1 端到端神经网络架构的技术融合示意

三、具身智能与自动驾驶的同构性分析

3.1 感知-认知-执行闭环

自动驾驶系统和具身机器人系统均遵循感知-认知-执行(Perception-Cognition-Action, PCA)闭环范式。感知模块负责环境信息的获取和理解,认知模块负责决策规划,执行模块负责物理动作的实现。

从系统论角度,两类系统具有高度的结构同构性。自动驾驶车辆可视为一种特殊的具身智能体,其"身体"是车辆平台,"感知器官"是传感器阵列,"执行器官"是转向、驱动、制动系统。类人机器人则具有更复杂的身体结构和更丰富的感知-执行通道。

3.2 环境交互与任务执行

两类系统都需要在动态、不确定的环境中执行任务。自动驾驶需要在复杂交通环境中安全导航,类人机器人需要在人类生活环境中完成各种操作任务。两者都面临环境感知、障碍规避、路径规划等共同挑战。

从任务角度,自动驾驶可视为一种特殊的具身智能任务——导航任务。类人机器人需要执行的任务更加多样化,包括操作、交互、协作等,但这些任务的核心能力要素与自动驾驶任务高度重叠。

3.3 学习范式与泛化能力

FSD v12采用的端到端学习范式,与具身智能领域倡导的"从交互中学习"(Learning from Interaction)理念高度契合。两者都强调通过大规模数据驱动的方式习得智能行为,而非依赖人工设计的规则。

泛化能力是两类系统的共同追求。FSD v12需要在各种未见过的场景中安全驾驶,类人机器人需要在各种新环境中完成任务。端到端学习通过大规模数据训练获得的丰富表征,为泛化能力提供了基础。

维度 | 自动驾驶系统 | 具身机器人系统 | 同构性 |

感知模态 | 视觉为主 | 视觉、触觉、听觉等多模态 | 视觉感知高度同构 |

执行空间 | 车辆运动空间 | 全身运动空间 | 运动规划原理相通 |

任务类型 | 导航为主 | 导航、操作、交互等 | 导航能力可直接迁移 |

环境特征 | 结构化道路环境 | 非结构化人类环境 | 环境理解能力可迁移 |

学习范式 | 端到端学习 | 强化学习、模仿学习 | 学习框架兼容 |

表1 自动驾驶系统与具身机器人系统的同构性分析

四、技术迁移的关键挑战与解决方案

4.1 感知模态扩展

【挑战】FSD v12采用纯视觉方案,而类人机器人需要整合视觉、触觉、听觉、本体感觉等多模态信息。如何将视觉主导的感知架构扩展为多模态感知架构,是技术迁移的首要挑战。

【解决方案】采用多模态融合网络架构,将触觉、听觉等模态作为附加输入通道融入现有视觉感知网络。具体技术路径包括:(1)早期融合:在特征提取前融合多模态数据;(2)中期融合:在特征空间融合多模态表征;(3)晚期融合:在决策层融合多模态信息。

4.2 执行空间扩展

【挑战】FSD v12的输出空间为车辆控制信号(方向盘转角、踏板位置),维度较低。类人机器人的执行空间涉及全身关节的运动控制,自由度高达数十甚至上百,输出空间维度显著增大。

【解决方案】采用分层控制架构。高层网络负责任务规划和运动原语(Motor Primitive)选择,中层网络负责运动原语到关节轨迹的映射,底层控制器负责关节级别的伺服控制。通过分层抽象,降低端到端学习的难度。

4.3 域适应与迁移学习

【挑战】FSD v12在驾驶域训练获得的知识,如何有效迁移到机器人操作域?两个域之间存在显著的分布偏移(Distribution Shift)。

【解决方案】采用迁移学习和域适应技术。具体策略包括:(1)特征迁移:将FSD v12的视觉特征提取网络作为预训练模型,在机器人数据上微调;(2)知识蒸馏:将FSD v12的场景理解能力蒸馏到机器人感知模块;(3)元学习:学习跨域迁移的通用能力,实现快速适应新任务。

4.4 数据效率与安全约束

【挑战】FSD v12依赖数百万小时的真实驾驶数据进行训练。类人机器人的数据采集成本更高,且机器人在物理空间中的操作涉及安全风险,难以进行大规模试错学习。

【解决方案】采用仿真到现实(Sim-to-Real)迁移技术。在高保真仿真环境中进行大规模训练,再通过域随机化(Domain Randomization)和域适应技术迁移到真实机器人。同时,引入安全约束机制,确保机器人在学习过程中的行为安全性。

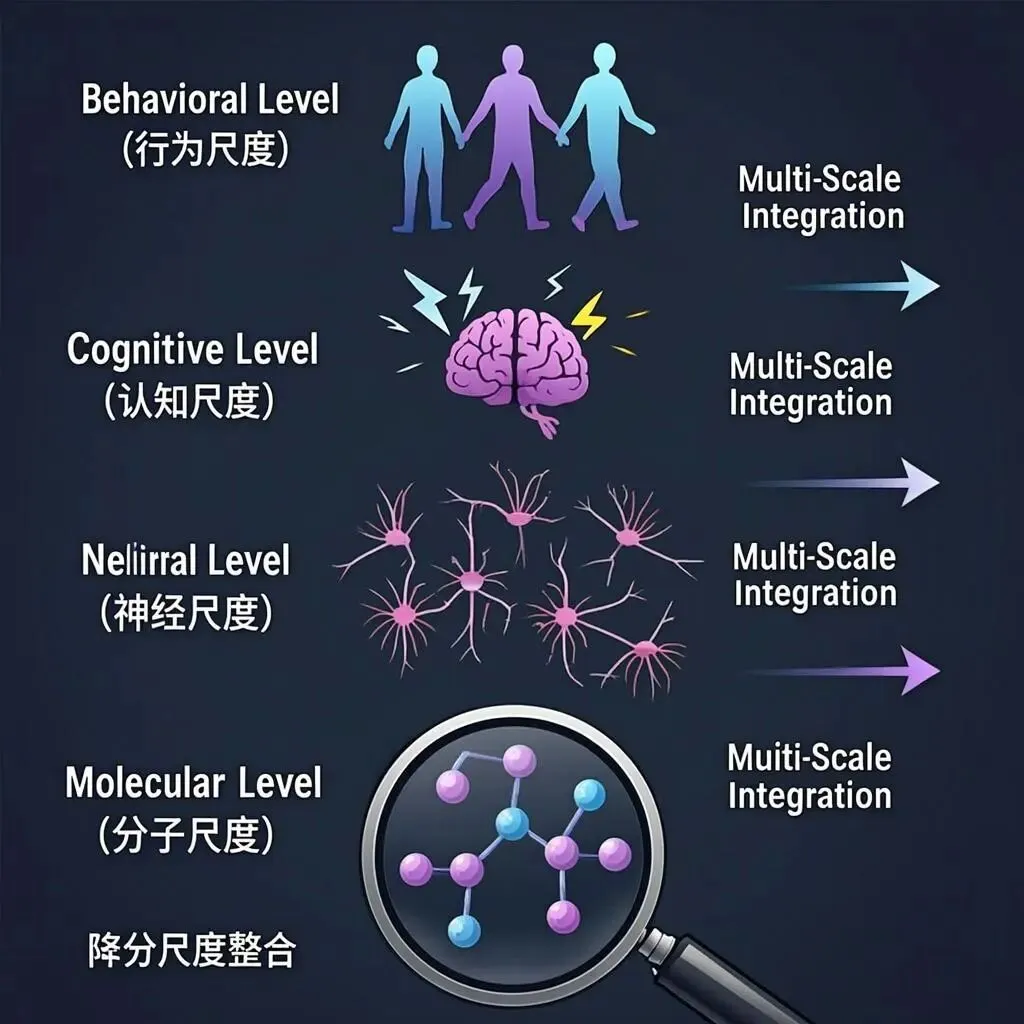

图2 跨域技术迁移的多尺度分析框架

五、新一代类人机器人的预期特征

基于FSD v12技术迁移的新一代类人机器人,预期将具备以下特征:

【强泛化能力】通过端到端学习和大规模数据训练,机器人能够在各种未见过的环境中执行任务,无需针对每个场景进行专门编程。

【类人行为模式】通过模仿学习从人类行为中习得操作策略,机器人的动作将更加自然、流畅,符合人类的直觉预期。

【实时决策能力】端到端架构消除了模块间的通信开销,实现了从感知到执行的快速响应,满足实时交互需求。

【持续学习能力】系统具备在线学习能力,能够在实际运行中不断优化行为策略,适应新的任务需求。

【安全可控性】通过引入安全约束和可解释性技术,确保机器人的行为在安全边界内,且人类能够理解和干预。

六、结论与展望

本文系统分析了Tesla FSD v12系统向具身机器人领域迁移的理论基础和技术路径。研究表明,自动驾驶系统与具身机器人系统在感知-认知-执行闭环、环境交互、学习范式等方面具有高度同构性,为技术迁移提供了理论基础。

技术迁移面临的主要挑战包括感知模态扩展、执行空间扩展、域适应和数据效率等。通过多模态融合、分层控制、迁移学习、仿真到现实迁移等技术手段,这些挑战有望得到有效解决。

展望未来,基于端到端神经网络的新一代类人机器人将具备强泛化能力、类人行为模式、实时决策能力等特征,有望在家庭服务、工业生产、医疗护理等领域发挥重要作用。这一技术演进路径代表了具身智能领域的重要发展方向,值得学术界和产业界持续关注。

关键词:端到端神经网络;自动驾驶;具身智能;类人机器人;迁移学习;域适应;FSD v12

Key Terms: End-to-End Neural Network; Autonomous Driving; Embodied Intelligence; Humanoid Robot; Transfer Learning; Domain Adaptation; FSD v12; Perception-Cognition-Action Loop; Imitation Learning; Sim-to-Real Transfer