深度学习的未来:从风格迁移到自动驾驶,再到反向传播的奥秘

今天我们来聊聊深度学习的未来——这个领域已经不再局限于学术圈的论文实验,而是悄然渗透到我们生活的方方面面。从艺术创作到自动驾驶,从图像生成到游戏博弈,深度学习正在重塑世界。同时,我也会带大家深入底层,看看支撑这一切的“反向传播”是如何一步步自动化的。让我们一起探索吧!

一、深度学习的前沿应用

1. 图像风格变换:当AI遇见梵高

你有没有想过,让一张普通的照片拥有梵高的笔触?这就是图像风格变换的魅力。如图8-23所示,我们输入两张图像:一张是“内容图像”(比如你的旅行照),另一张是“风格图像”(比如梵高的《星空》)。深度学习会生成一张新图像,它保留了内容图像的形状,却融入了风格图像的色彩和纹理。

这项技术来自论文“A Neural Algorithm of Artistic Style”,一经发表便引爆全球。其核心思想是:在神经网络的学习过程中,让生成图像的中间层特征逼近内容图像的特征,同时通过“风格矩阵”让生成图像在纹理统计上与风格图像一致。简单来说,就是一边“描形”,一边“仿神”。

图8-23 图像风格变换示例

图8-23 图像风格变换示例2. 图像的生成:DCGAN,从零画出卧室

如果说风格变换还需要两张输入,那么生成对抗网络(GAN)则更神奇:它可以凭空创造出从未存在过的图像。图8-24展示了DCGAN(深度卷积生成对抗网络)生成的卧室图像,它们逼真得仿佛真实照片,但实际上完全是AI虚构的。

DCGAN由两个网络组成:生成器(Generator)和判别器(Discriminator)。生成器负责伪造图像,判别器负责鉴定真伪。两者相互博弈、共同成长——生成器越来越擅长以假乱真,判别器则越来越火眼金睛。最终,生成器能够画出足以乱真的图像,这为艺术创作、数据增强等领域带来了无限可能。

图8-24 DCGAN生成的卧室图像

图8-24 DCGAN生成的卧室图像3. 自动驾驶:让AI看懂世界

自动驾驶的实现离不开对周围环境的精准识别。图8-25展示了基于深度学习的图像分割技术:输入一张街景图像,神经网络能够将像素级地划分为道路、建筑物、行人、车辆等。这种精细的识别能力是自动驾驶安全性的基石。

随着深度学习模型的不断优化,分割的精度和速度都在提升。未来,当汽车能够实时理解复杂的交通场景时,自动驾驶的全面普及就不再遥远。

图8-25 图像分割在自动驾驶中的应用

图8-25 图像分割在自动驾驶中的应用4. Deep Q-Network:强化学习的突破

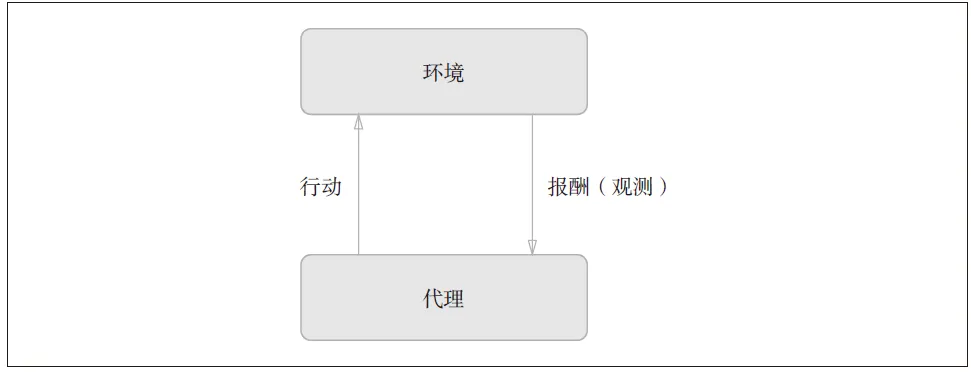

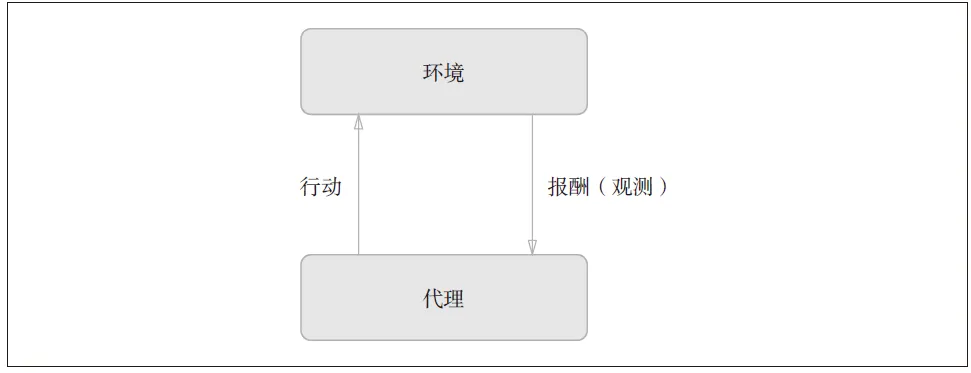

强化学习让AI通过试错自主学习,就像我们学骑自行车一样。而Deep Q-Network(DQN)则将深度学习与Q学习结合,实现了从游戏画面直接学习操作的能力。图8-26展示了强化学习的基本框架:智能体(Agent)根据环境状态选择动作,环境反馈奖励,智能体不断优化策略以获取最大累积奖励。

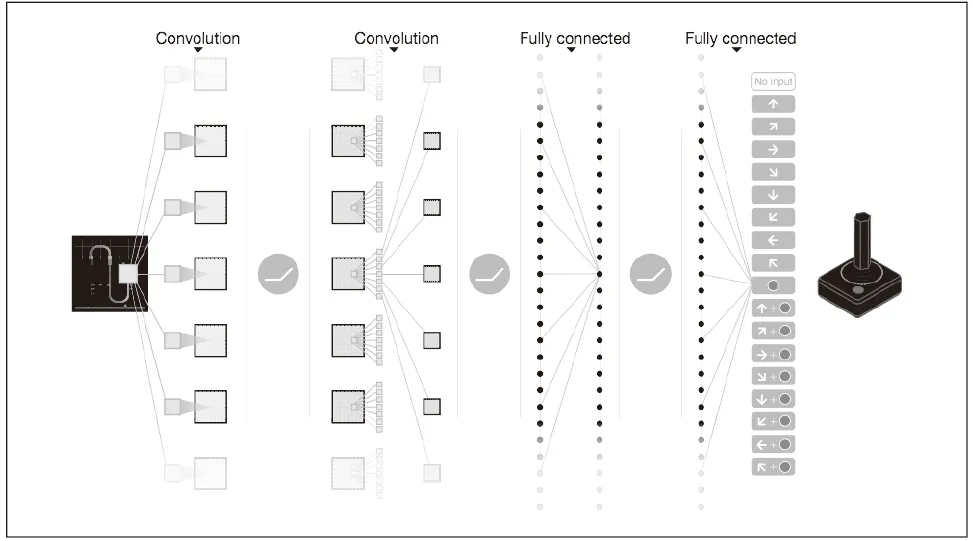

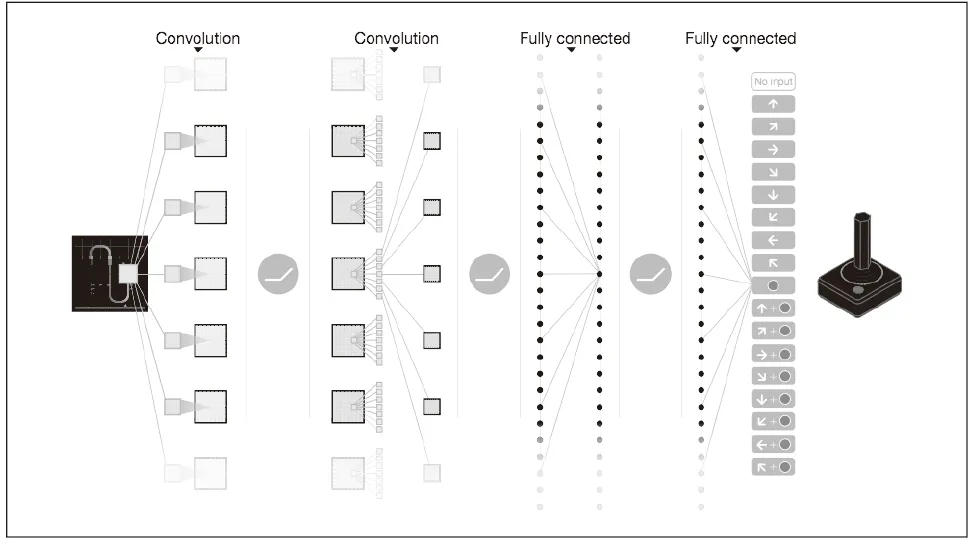

DQN的突破在于:它不需要人工提取游戏状态特征,仅凭原始像素(连续4帧图像)就能学会玩《吃豆人》《太空侵略者》等数十款游戏,甚至在多数游戏中超越人类职业选手。图8-27展示了DQN的网络结构,输入是游戏画面,输出是各个手柄动作的“价值”。

图8-26 强化学习基本框架

图8-26 强化学习基本框架 图8-27 DQN学习游戏操作

图8-27 DQN学习游戏操作二、反向传播:深度学习背后的引擎

上面这些炫酷的应用,都离不开一个核心算法——反向传播。正是它让神经网络能够从数据中学习。下面,我们就从零开始,用代码实现自动反向传播,揭开它的神秘面纱。

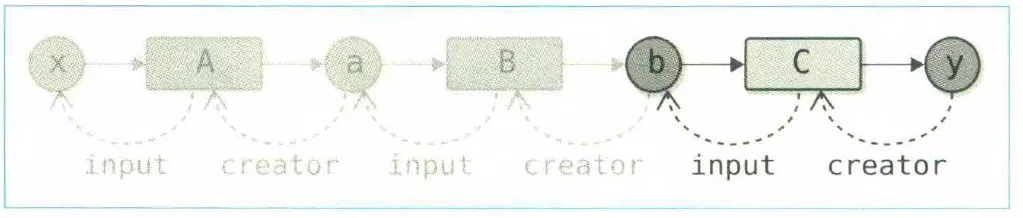

从计算图到手动反向传播

假设我们有这样一个计算图:

x -> A (Square) -> a -> B (Exp) -> b -> C (Square) -> y

即:y = C(B(A(x))),其中A和C是平方函数,B是指数函数。

我们先手动实现反向传播。从y开始,设y.grad = 1.0。

y.grad = np.array(1.0)# 从y到bC = y.creatorb = C.inputb.grad = C.backward(y.grad)# 从b到aB = b.creatora = B.inputa.grad = B.backward(b.grad)# 从a到xA = a.creatorx = A.inputx.grad = A.backward(a.grad)print(x.grad)

每一步都是:获取创建当前变量的函数 -> 获取函数的输入 -> 调用函数的backward方法。这种重复很机械,我们可以让它自动化。

给Variable类添加backward方法

我们将这个逻辑封装到Variable类的backward方法中,使其可以递归调用。

classVariable:def__init__(self, data): self.data = data self.grad = None self.creator = Nonedefset_creator(self, func): self.creator = funcdefbackward(self): f = self.creatorif f isnotNone: x = f.input x.grad = f.backward(self.grad) x.backward()

现在,只需要调用y.backward(),反向传播就会自动完成。

A = Square()B = Exp()C = Square()x = Variable(np.array(0.5))a = A(x)b = B(a)y = C(b)y.grad = np.array(1.0)y.backward()print(x.grad) # 输出结果与手动计算一致

这样,我们就搭建了自动微分的基础。正是这种机制,让深度学习框架能够高效地计算梯度,从而优化数百万甚至数十亿的参数。

结语

从风格迁移到自动驾驶,从图像生成到游戏博弈,深度学习的未来充满无限可能。而这一切的根基,是像反向传播这样优雅的数学算法。作为开发者,理解这些底层原理,能让我们更好地驾驭上层应用。

希望今天的分享能让你对深度学习既有宏观视野,又有微观洞察。如果你对某个方向特别感兴趣,欢迎留言,我们后续深入探讨!