引言:从"让AI听懂"到"让AI可信任"

2026年,AI领域的风向正在发生一个微妙但致命的变化。

如果你还在讨论"如何写好提示词",可能已经有点Out了。

因为真正稀缺的能力,不再是会不会写Prompt,而是能不能把人类判断"制度化"。

这不是我的判断,是OpenAI和Anthropic两大巨头同时在说的事情。

最近,清华大学清新研究团队,第一次系统性地梳理了一个正在席卷AI工程界的新概念——Harness Engineering(驾驭工程)。

今天这篇文章,我就带你彻底读懂它。

一、一个让科技巨头集体"上头"的新词

Harness Engineering——驾驭工程。

这个词最近在硅谷有多火?

OpenAI:2026年2月11日,明确发布"Harness Engineering"专题文章。他们的Codex实验场景,用0行人工代码启动,估算开发时间约为手写的1/10,五个月后仓库达到百万行级别。

Anthropic:连发三篇文章,聚焦长时程会话与可恢复状态,反复强调Harness设计对长期运行Agent的重要性。

有意思的是,虽然这些公司都在用,但这个词边界还没完全冻结——就像2015年的"微服务",2019年的"DevOps",正在从实践话语向教科书术语进化。

中国落地窗口已经形成:

这意味着什么?全球最大的AI应用市场,正在等待一套成熟的"驾驭方法论"。

二、核心判断:驾驭工程是"操作系统层"

报告的核心判断非常犀利:

驾驭工程不是把提示词再写长一点,而是把模型周围整个制度化执行环境设计出来。

怎么理解这句话?

想象一下PC时代:

如果你只有"语言层"(键盘敲字),电脑永远不会真正运行程序。

AI行业正在经历同样的事情。

提示词工程解决的是"怎么说清楚"——这是语言层。

智能体工程解决的是"怎么让模型动起来"——这是工作流层。

而驾驭工程要解决的,是给AI一个可持续执行、可治理、可审计的操作系统级环境。

三、一张图看懂四层工程体系

报告画了一张非常清晰的层次图:

关键洞察:这四层不是互斥关系,而是逐层上卷。

驾驭工程把Prompt、Context、Agent全部吸纳进去,成为一个系统级环境设计,而不是单点技巧集合。

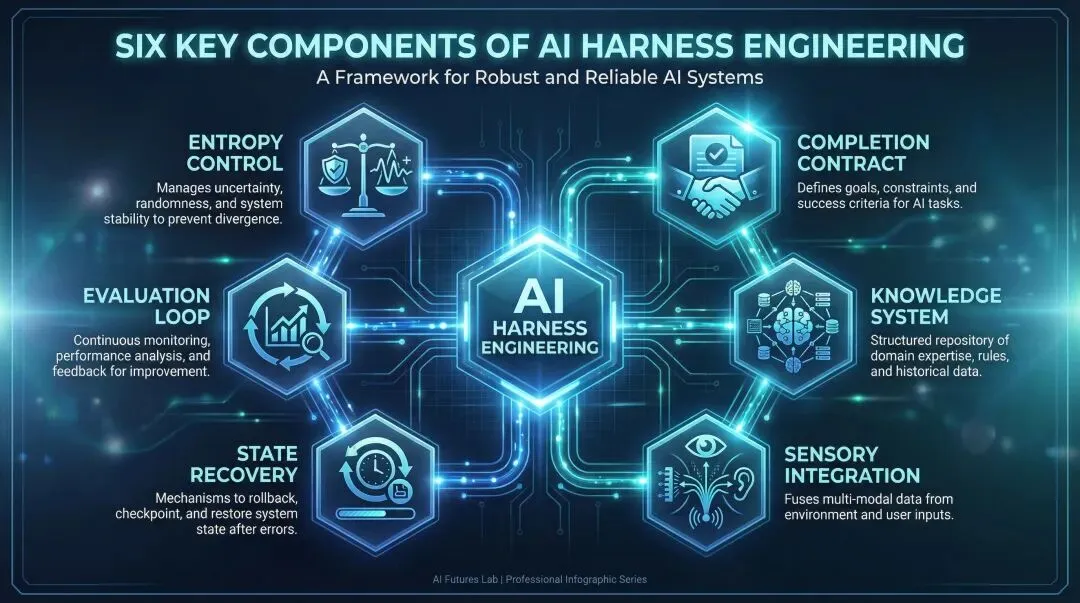

四、驾驭工程的六大"负重部件"

报告把驾驭工程拆解成六个必须被工程化的核心组件:

1️⃣ 机器可验证的"完成契约"

这是最反直觉的一点:"Done"不是漂亮回答,而是可验证完成。

一个完整的完成契约必须包括:

| 要素 | 说明 |

|---|

| 输出格式 | 预定数据结构与格式规范 |

| 工具使用 | 指定工具调用与交互流程 |

| 停止条件 | 明确终止触发与边界情况 |

| 验收方法 | 自动化测试与验证准则 |

核心逻辑:先问"完成长什么样",再问"用什么模型"。

2️⃣ Durable Knowledge的System of Record

知识必须离开聊天窗口,进入可发现、可维护、可验证的记录系统。

报告建议:

AGENTS.md只做目录索引

真正的知识库存放在 docs/ 目录

实现知识的版本化管理

3️⃣ 给Agent真正的"感官"

当前很多Agent其实是"残疾人"——它们只能看对话历史,无法主动感知真实环境。

报告指出,Agent必须具备:

UI感知:浏览器操控能力

日志读取:实时运行状态

指标监控:性能与traces追踪

终端操作:代码执行与测试

"只有能读UI、看日志、跑测试,代理才有资格自证完成。"

这不是附件,而是执行环境本身。

4️⃣ 解决长时程"失忆症"

当AI需要处理跨越数小时甚至数天的任务时,最大的敌人是状态丢失。

报告的核心观点:

"会话会断,状态不能丢。"

解决方案:

可恢复(Recoverable):任务中断后能无缝续接

可继承(Inheritable):状态可转移给其他Agent或人工

可审计(Auditable):每一步操作都有记录可查

5️⃣ 验证必须"外置"成回路

不能让主Agent同时当运动员和裁判。

多层防线设计:

生产监控(实时)

自动评测(自动化)

A/B测试(对照)

人工审阅(兜底)

6️⃣ 边界、沙箱与熵控制必须"机械化"

风格、架构、安全——这些不能只存在于人脑审美里。

最终都要变成lints(代码检查规则)。

只有机械化,才能规模化。

五、为什么是"现在"突然重要?

报告给出了一个关键洞察:

因为模型已跨过"回答问题"的门槛。

OpenAI已经明确把Agent定义为能完成从简单目标到开放式工作流的存在。

瓶颈已经从"生成更多"转向"让人只在高杠杆节点出手"。

换句话说:

过去的问题:AI不够聪明,生成质量不行

现在的问题:AI已经够聪明,但人类管不过来

这不是能力问题,而是治理问题。

六、实施路线:六步走

报告给出了一套清晰的落地路径:

| 步骤 | 核心动作 | 关键产出 |

|---|

| 第一步 | 定义Machine-checkable的完成标准 | 完成契约文档 |

| 第二步 | 知识从长Prompt搬进版本化Artifacts | 知识库体系 |

| 第三步 | 给Agent配齐感官(浏览器、日志、终端) | 执行环境 |

| 第四步 | 用Progress File解决失忆问题 | 状态恢复机制 |

| 第五步 | 上Evaluator、回归测试与生产监控 | 评测回路 |

| 第六步 | 把Taste、Architecture写进机械规则 | Lints规则库 |

报告还建议采用30/60/90天推进法:

30天:完成概念验证,建立第一版完成契约

60天:跑通核心场景,建立知识库和感官体系

90天:上线评测回路,实现夜间无人值守

七、人的角色发生根本性转变

这是报告中让我印象最深的部分。

之前:人是一个表达者(Expresser)

之后:人必须是设计者(Designer)

驾驭工程真正要求的不是模型能力,而是组织能力——

| 能力领域 | 核心职责 |

|---|

| 产品 | 需求定义与价值发现 |

| 治理 | 合规风险与标准制定 |

| 工程 | 构建实施与技术卓越 |

| 运营 | 维护优化与持续改进 |

"真正稀缺的,不再是会不会写Prompt,而是能不能把人类判断制度化。"

八、最小治理清单:在放手之前必须补齐的边界

报告给出了一份最小治理清单,在高自治之前,至少需要具备:

身份与授权

所有实体身份验证

授权访问控制

认证通过的AI Agent

最小权限原则

仅授予执行任务所需的最小权限

定期审计机制

统一身份管理,避免数据孤岛

权限随需分配,动态调整

特定数据安全基线

结语:一场静悄悄的工程革命

驾驭工程,本质上是在回答一个问题:

当AI不再只是回答问题,而是开始"做事"的时候,我们如何确保它做对的事、做得好、出了问题能恢复?

这不是一个技术问题,这是一个制度设计问题。

Prompt不会消失,但会变成制度层中的一个组件。

Context不会消失,但需要被系统化管理。

Agent不会消失,但需要被放进可靠的保护层。

2026年,如果你要做AI应用,真正的竞争力不再是"谁家的模型更强",而是"谁能把AI真正驾驭起来"。

这场革命,静悄悄,但已经开始。

📊 文章总结

| 项目 | 内容 |

|---|

| 主题 | Harness Engineering(驾驭工程)深度解读 |

| 核心观点 | 驾驭工程是AI的"操作系统层",解决制度化执行环境设计 |

| 四层体系 | 提示词工程→上下文工程→智能体工程→驾驭工程 |

| 六大部件 | 完成契约、知识系统、感官集成、状态恢复、评测回路、熵控制 |

| 实施路径 | 六步走 + 30/60/90天推进法 |

| 人才转型 | 从"表达者"到"设计者" |

参考资料:

《驾驭工程(Harness Engineering)研究报告》,清华·清新研究团队,2026年3月

OpenAI Agent Documentation

Anthropic Engineering Blog Series