一、引言

当一辆以120km/h速度飞驰的自动驾驶汽车需要在100毫秒内完成从感知到决策的全过程,一个隐身幕后的“总指挥”正在以微秒级的精度调度着数十个传感器与计算单元——它便是边缘端AI调度系统。

你有没有思考过这样一个问题:自动驾驶汽车为什么要搭载那么多传感器?激光雷达、毫米波雷达、摄像头、超声波传感器……这些设备每秒钟产生的数据量高达数GB,而车辆必须在瞬息之间完成实时处理。这个挑战,比把人送上月球还要艰巨。

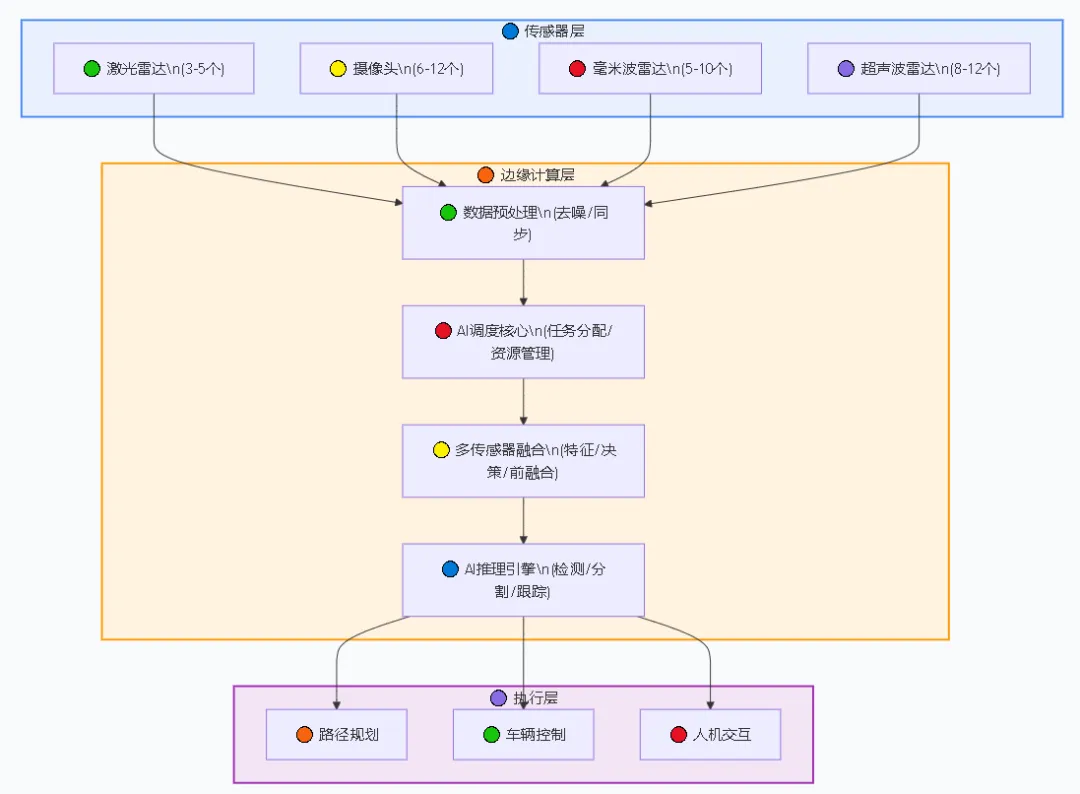

让我们先来看一组数据:L4级自动驾驶汽车通常配备6-12个摄像头、3-5个激光雷达、5-10个毫米波雷达,每秒产生约10-20GB的原始数据。而处理这些数据的窗口期,只有不到100毫秒。如果AI调度系统慢了哪怕50毫秒,车辆就会在高速行驶中产生数米的误差,直接威胁行车安全。

二、什么是边缘端AI调度?

2.1 什么是边缘端AI调度

在传统的云计算架构中,车辆将传感器数据上传到云端处理,再等待结果返回。这种方式存在着天然的延迟瓶颈——网络传输的几十毫秒对于高速行驶的车辆来说是不可接受的。

边缘端AI调度将计算任务从云端下沉到车辆本地,通过在车载计算平台上智能分配计算资源,实现对多传感器数据的实时处理。它的核心任务包括:

- 任务优先级管理:哪些数据必须立即处理,哪些可以稍后处理

- 计算资源分配:如何将有限的计算资源(CPU、GPU、NPU)分配给不同任务

- 数据融合调度:如何协调异构传感器数据的时间同步与空间对齐

2.2 边缘端AI架构图

下图展示了自动驾驶边缘端AI调度的整体架构:

三、核心挑战:多传感器数据处理的三大难题

3.1 难题一:数据异构性

不同传感器的数据格式、采样频率、分辨率都存在巨大差异:

AI调度系统必须能够统一管理这些异构数据,将它们转化为融合处理单元能够识别的标准格式。

3.2 难题二:时间同步

每个传感器都有独立的时钟系统。当车辆以30m/s的速度行驶时,即使10毫秒的时钟偏差,也会导致30厘米的位置误差。边缘端AI调度需要实现微秒级的多传感器时间戳对齐。

3.3 难题三:资源竞争

车载计算平台的算力是有限的。当多个传感器同时产生高负载数据时,AI调度系统必须做出智能决策:是优先处理当前帧的图像,还是先完成激光雷达的点云分割?

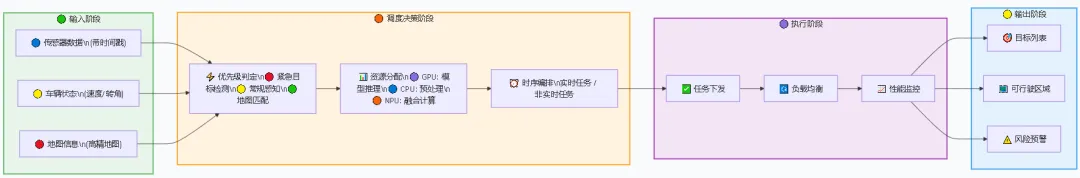

下图展示了边缘端AI调度的核心流程:

四、解决方案:自适应AI调度算法

针对上述挑战,业界提出了多种自适应调度算法。这里介绍三种主流方案:

4.1 优先级驱动调度

根据场景动态调整任务优先级。例如:

4.2 基于强化学习的调度

将调度问题建模为马尔可夫决策过程,通过深度Q网络学习最优调度策略。状态空间包括:待处理任务队列、可用计算资源、当前场景类型。动作空间为:任务分配决策、频率调整。奖励函数定义为:最小化端到端延迟 + 最大化感知精度。

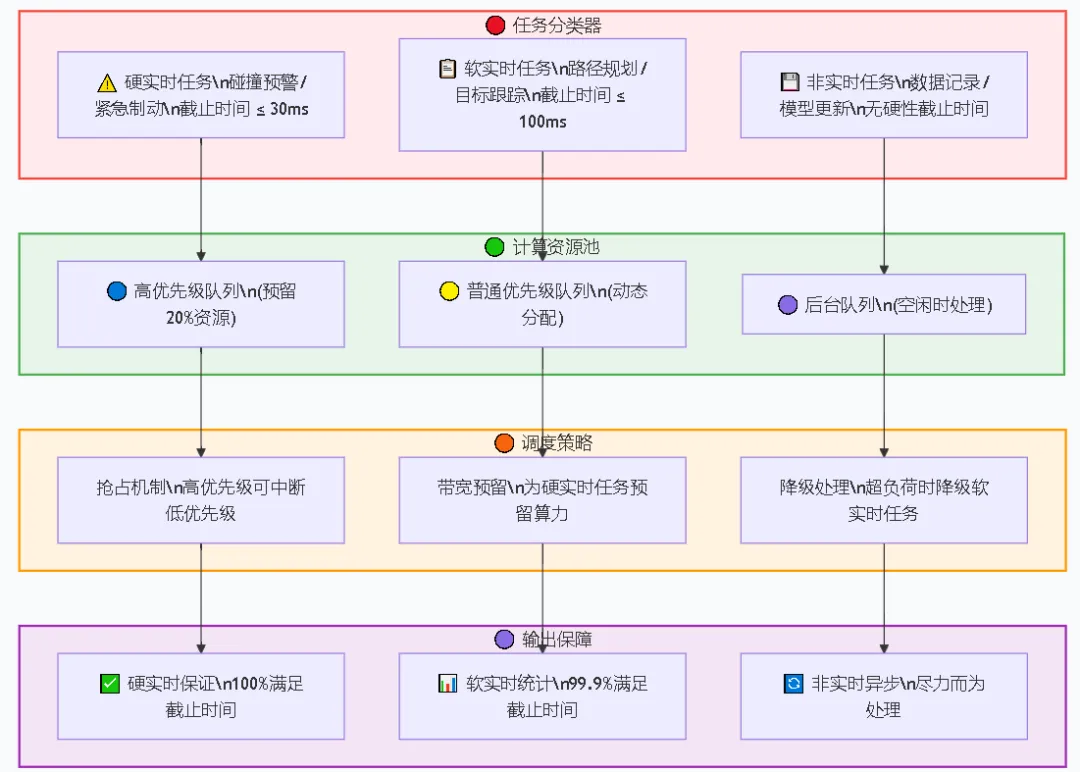

4.3 混合关键性调度

将任务分为硬实时(必须满足截止时间)和软实时(允许偶尔超时)两类:

- 硬实时任务:碰撞预警、紧急制动(截止时间<30ms)

- 软实时任务:路径规划、地图更新(截止时间<100ms)

下图展示了混合关键性调度策略的工作机制:

4.4 性能指标与优化效果

优秀的边缘端AI调度系统应该达到以下指标:

五、未来发展趋势

5.1 端云协同调度

边缘端处理95%的常规场景,云端负责5%的长尾场景和模型更新,实现算力的最优配置。

5.2 预测性调度

基于历史数据和当前场景,预判未来100ms内的计算负载,提前分配资源。

5.3 存算一体架构

将计算单元与存储单元融合,减少数据搬运带来的延迟和能耗,有望将调度延迟再降低30-50%。

5.4 安全与容错调度

当单个计算单元失效时,毫秒级完成任务重分配和降级处理,确保fail-operational。

六、总结

边缘端AI调度或许不是自动驾驶中最耀眼的技术,但它如同乐团的指挥——没有它,再强大的感知算法和规划控制也只是各自为战的独奏。随着芯片算力的持续提升和调度算法的不断优化,我们有理由相信,100毫秒内的安全决策闭环将成为所有自动驾驶车辆的标配。

当你在未来坐上一辆无人驾驶出租车,轻松地刷着手机、喝着咖啡,请记住:正是那个你从未注意到的AI调度系统,在每一毫秒内守护着你的出行安全。