3DGS近期工作盘点:从端到端自动驾驶到物理仿真,高斯溅射的下一站......

- 2026-03-09 03:10:24

「3DGS 的真正潜力在哪?」

自2023年横空出世,3DGS以其惊人的渲染速度和质量席卷了三维视觉领域。但它的潜力远不止于“好看”。

步入2026年,学术界风向骤变:3DGS正从单纯的图形渲染技术,极速进化为自动驾驶、SLAM、机器人操作等核心任务的认知基石。 它不仅能“画”出世界,更开始尝试“理解”物理规律与动态逻辑。

本文精选近期(2025年底至2026年初)10篇顶尖工作,涵盖端到端自动驾驶、雷达SLAM、物理仿真等前沿方向,带你一览3DGS如何从“视觉重建”迈向“具身智能”。

需要特别说明的是,入选并不意味着这些工作在质量上优于同期其他论文——事实上,同一时期涌现出的优秀研究远不止于此。受限于篇幅,大量同样出色甚至更具影响力的工作未能在本文中得到呈现,这是选题取舍的结果,而非价值判断。如有遗漏您认为值得关注的重要工作,欢迎在评论区留言补充,我们也会持续追踪和介绍这一领域的最新进展。

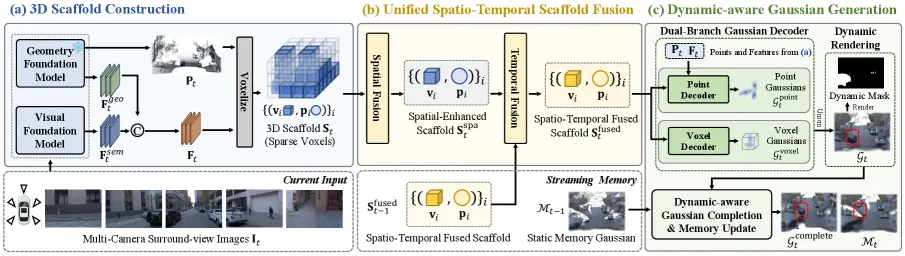

主要内容: 现有的动态驾驶场景重建方法普遍面临一个两难困境:如何在前馈式架构中,同时处理稀疏、非重叠的多视角输入和复杂的场景动态?以往的方法要么难以维持一个统一的时空连贯潜在表示,要么在处理遮挡和运动时捉襟见肘。

UniSplat的核心洞察在于:构建一个统一的3D潜在支架(3D latent scaffold),作为时空信息的融合中心。 这个支架就像一个全局的3D画布,它首先利用预训练模型从多视角图像中提取几何和语义先验,形成一个初始的场景理解骨架。随后,一个新颖的融合机制在这个支架内部直接整合空间(多视角)和时间(多帧)信息。最后,一个双分支解码器通过"点锚定优化"和"体素化生成"相结合的方式,生成动态感知的高斯点云,同时维护一个静态高斯点的持久化记忆,以流式补全场景。这种设计巧妙地解决了动态与静态、当前与历史信息的统一建模问题。

在Waymo和nuScenes数据集上的实验结果令人印象深刻,PSNR分别达到29.58和25.37,后者更是将SOTA水平提升了1.10dB,证明了该框架在复杂动态场景重建中的鲁棒性和高保真度。

地址: https://arxiv.org/abs/2511.04595

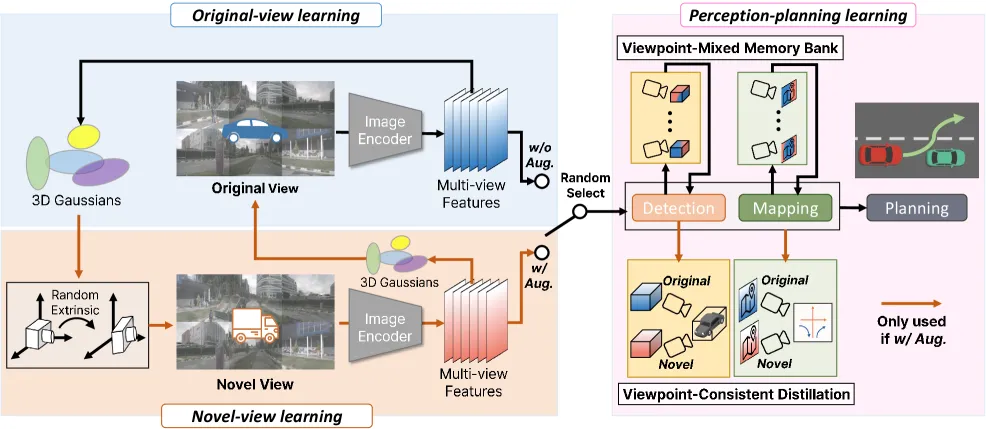

主要内容: 端到端自动驾驶(E2E-AD )系统的一个致命弱点是其对摄像头视角的敏感性。由于不同车型的摄像头安装位置各异,模型在训练数据之外的视角下往往表现不佳,而为每一种可能的视角收集数据又是不现实的。

VR-Drive的解决方案极具启发性:将3D场景重建作为辅助任务,在E2E-AD框架内部联合学习,从而赋予模型"脑补"新视角的能力。 它不再需要额外的标注数据,而是利用3DGS模块从原始视角重建出三维场景,然后从这个三维场景中渲染出任意新视角的图像,用于数据增强。为了解决合成图像与真实图像之间的域差异,VR-Drive设计了"视角混合记忆库"和"视角一致性蒸馏"策略,确保规划模块能从合成数据中学到鲁棒的驾驶知识。

在nuScenes数据集上,面对未见过的相机视角,VR-Drive的平均L2误差仅为0.68米,碰撞率低至0.11%,显著优于DiffusionDrive等先前方法(L2误差1.17米,碰撞率0.41%)。这证明了通过3DGS进行内生式的视角增强,是解决端到端模型泛化性难题的一条有效路径。

地址:https://arxiv.org/abs/2510.23205

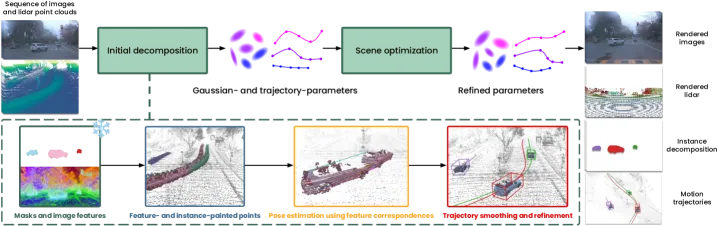

主要内容: 为了进行真实的自动驾驶仿真 ,我们需要能够对场景中的动态物体进行单独控制和编辑。然而,现有方法要么依赖昂贵的人工标注来获取物体轨迹,要么无法在重建中显式地分离出不同的物体实例。

IDSplat提出了一种优雅的自监督解决方案:将动态物体建模为具有可学习刚性变换的连贯实例,而不是一堆非结构化的时变基元。 它首先利用一个零样本的语言-视觉视频跟踪器(如Grounded-SAM-2)在2D图像上生成实例掩码,然后结合LiDAR数据将这些掩码提升到3D。通过DINOv3特征匹配和RANSAC算法估计物体位姿,并利用"协调转弯"运动模型进行平滑。最后,联合优化物体轨迹和高斯参数,实现对整个场景的实例级分解重建。

在Waymo NOTR数据集上,IDSplat的动态场景PSNR达到了26.19,远超DeSiRe-GS(19.59)和AD-GS(21.38),展示了其在无需人工标注的情况下,实现高保真、可控动态场景重建的强大能力。

地址:https://arxiv.org/abs/2511.19235

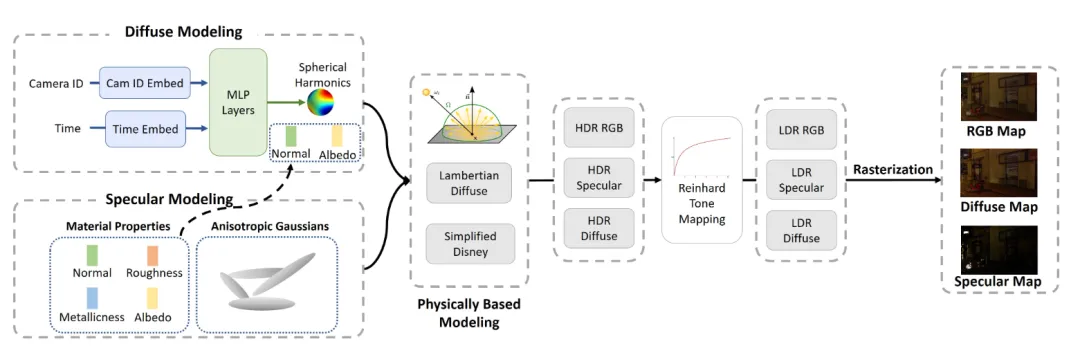

主要内容: 3DGS在光照良好的场景中表现出色 ,但在夜间驾驶等复杂光照条件下,其性能会急剧下降。这是因为标准3DGS将光照和材质耦合在一起,无法应对夜间场景中点状光源、高光和阴影等复杂现象。

这篇工作创造性地将基于物理的渲染(PBR)思想引入3DGS框架,以应对夜间驾驶场景的挑战。其核心是将场景光照分解为漫反射和镜面反射两个分量。利用球谐函数(SH)和各向异性球形高斯(ASGs)分别对全局光照和每个高斯基元的镜面反射进行建模,并引入双向反射分布函数(BRDF)作为物理约束。这种设计使得模型能够更真实地还原夜间场景的复杂光照效果。

在Waymo夜间数据集上,该方法的PSNR达到了31.9dB,SSIM为0.781,均显著优于之前的SOTA方法,证明了物理渲染与神经渲染结合的巨大潜力。

地址:https://arxiv.org/abs/2602.13549

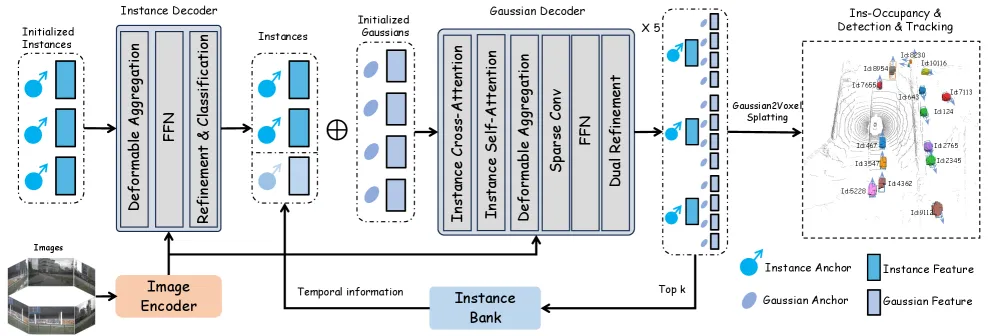

主要内容: 传统的3D边界框无法精确表示异形障碍物(如路边的树、倾倒的自行车 ),而体素化的占据预测方法又过于消耗计算资源。GUIDE提出了一种全新的范式:用一组稀疏的3D高斯基元来表示每个物体实例。

这个统一框架能够在一个端到端模型中同时完成实例级的占据预测、3D检测和跟踪。它首先通过实例解码器识别出物体,然后为每个物体分配一组3D高斯基元。这种稀疏表示极大地提高了效率,并通过一种名为"高斯到体素溅射"的技术生成精细的实例级占据图。此外,一个实例库(instance bank)被用来维持时序一致性,实现鲁棒的跨帧跟踪。

在nuScenes数据集上,GUIDE的实例占据mAP达到了21.61,相比之前的SOTA方法SparseOcc提升了50%,同时在3D检测和跟踪任务上也表现出强大的竞争力。

地址:https://arxiv.org/abs/2511.12941

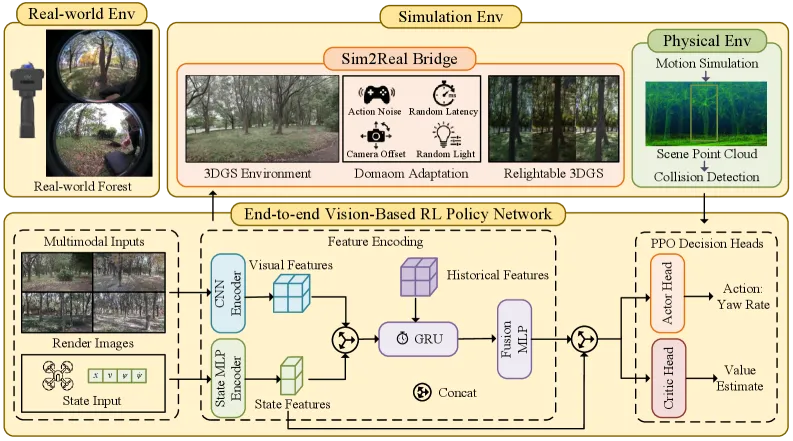

主要内容: 在野外环境中 ,光照的剧烈变化是无人机视觉导航的致命难题。从仿真环境训练出的策略,往往因为现实世界中光照的"领域差异"而失效。这篇工作的核心贡献在于提出了一种可重光照的3DGS(Relightable 3DGS)技术。

它不再像传统3DGS那样将静态光照与场景几何耦合在一起,而是将场景分解为多个物理上有意义的分量,从而允许在神经表示中对环境光照进行显式、符合物理规律的编辑。研究团队利用这种技术,从真实世界数据构建了一个高保真的仿真器,并在其中通过合成各种动态光照条件来训练一个端到端的强化学习策略。这个策略学会了光照不变的视觉特征,能够将原始单目图像直接映射到无人机的连续控制指令。

实验结果令人振奋:在真实的复杂森林环境中,该方法实现了高达10m/s的无碰撞导航,在晴天、阴天和黄昏等不同光照下的成功率都达到了极高的数值,实现了真正的"零样本"光照泛化。

地址:https://arxiv.org/abs/2602.07101

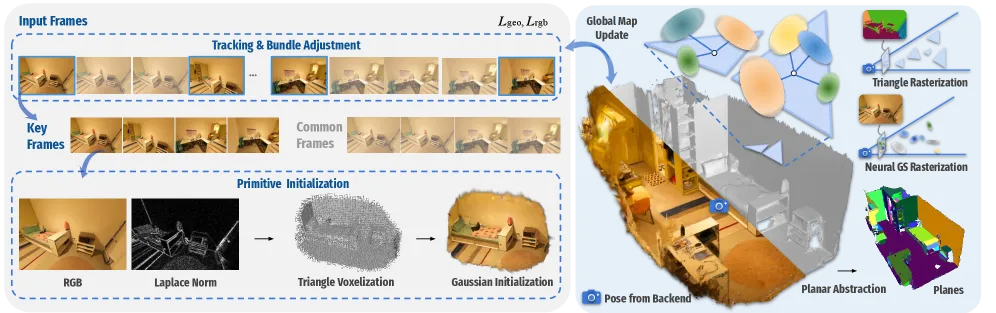

主要内容: 基于3DGS的流式重建方法虽然效果好 ,但往往会产生大量冗余、非结构化的基元,导致计算成本高昂,且难以进行几何编辑。PLANING提出了一种巧妙的混合场景表示来解决这个问题。

它将场景的几何与外观彻底解耦:用可学习的三角面片(triangle primitives)来显式地建模几何结构,同时用锚定在这些三角面片上的神经高斯来渲染外观。 这种设计一举两得:三角面片提供了稳定、紧凑且易于编辑的几何骨架,而神经高斯则保证了高质量的渲染效果。整个框架包含相机跟踪前端、全局位姿优化后端和场景建图器,能够高效地处理流式输入。实验证明,PLANING在ScanNetV2数据集上的重建速度不到100秒,比2DGS快5倍以上,同时几何精度(Chamfer-L2)比PGSR提升了18.52%。

地址:https://arxiv.org/abs/2601.22046

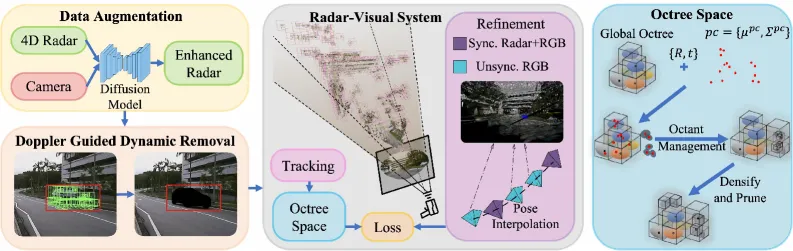

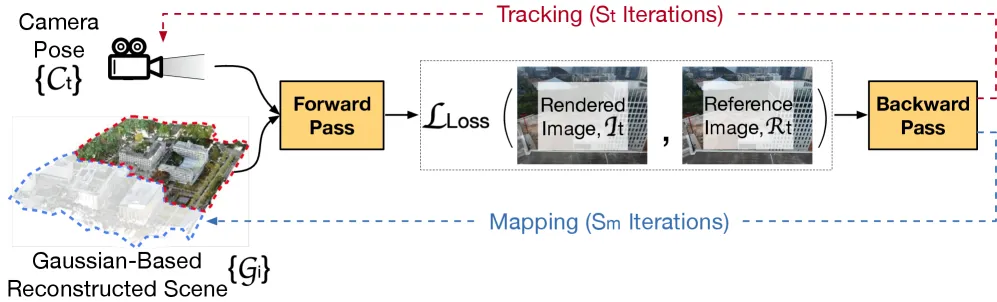

主要内容: 在室外大规模动态环境中,纯视觉SLAM方法极易受到动态物体的干扰。Rad-GS是首个将4D毫米波雷达与3DGS-SLAM结合的工作,其核心创新在于:利用雷达的多普勒速度信息,在单帧内直接识别并剔除动态物体。

这相当于为SLAM系统配备了一个强大的"动态滤镜"。系统首先增强稀疏的雷达点云,然后利用多普勒数据生成图像中的动态物体掩码,从而为SLAM后端提供一个纯净的、无动态干扰的输入。为了处理大尺度场景,Rad-GS还引入了全局八叉树结构来高效管理高斯基元,实现了内存友好的大规模建图。

地址:https://arxiv.org/abs/2511.16091

主要内容: 3DGS-SLAM的巨大计算量使其在手机等资源受限的移动设备上运行如同天方夜谭 。Splatonic通过算法-硬件协同设计,向这一目标迈出了关键一步。在算法层面,它提出了一种自适应的稀疏像素采样策略,显著减少了需要渲染的像素数量。在硬件层面,它设计了一种新颖的、与算法紧密配合的像素级渲染流水线,通过高斯并行渲染和抢占式alpha检查等技术,极大地提升了移动GPU的利用率。

最终,Splatonic在保持与SOTA算法相当精度的情况下,实现了惊人的性能提升:相比移动GPU,速度提升高达274.9倍,能效提升4738.5倍;相比最先进的硬件加速器,速度和能效也分别提升了25.2倍和241.1倍。这项工作为3DGS在移动端的实时应用铺平了道路。

地址: https://arxiv.org/abs/2511.18755

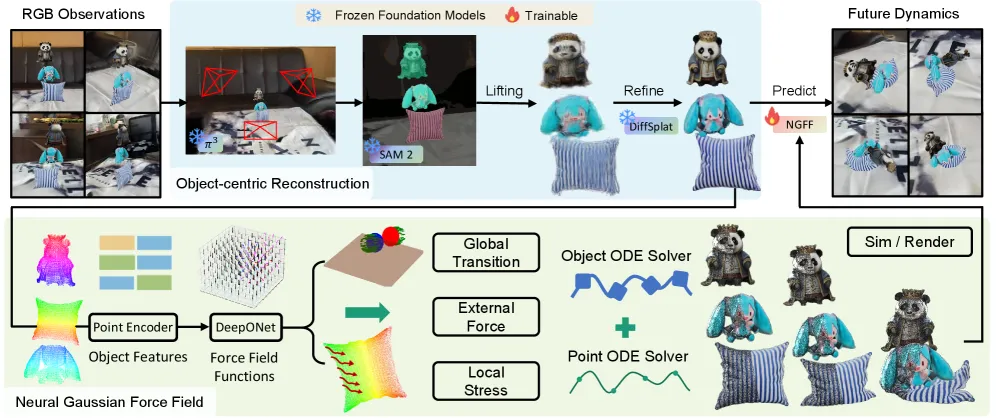

主要内容: 当前的视频生成模型生成的动态过程往往不符合物理规律 ,而传统的物理仿真器又计算昂贵。NGFF(神经高斯力场)框架首次将两者完美结合。其核心思想是:直接从场景的3D高斯表示中,学习一个显式的神经力场(neural force field)。

该框架首先利用一个前馈式Transformer从多视角图像重建出带有物体区分的3D高斯表示。然后,一个神经算子(neural operator)从这些高斯基元中预测出一个以物体为中心的力场。这个力场随后被输入到一个常微分方程(ODE)求解器中,以符合物理规律的方式模拟物体的动态演化。最后,更新后的高斯基元被渲染成视频。整个过程端到端可微,且比传统的MPM仿真器快两个数量级以上(0.363秒 vs 39.29秒)。在GSCollision基准测试中,NGFF的物理预测误差也远低于Pointformer等先前方法。

地址: https://arxiv.org/abs/2602.00148

如果说2024是3DGS的“渲染元年”,那么2026年无疑开启了它的“应用纪元”。从这10篇最新工作中,我们看到了清晰的技术演进脉络:

场景理解深化:3DGS正深度嵌入感知、规划与控制回路,成为自动驾驶与机器人的核心表示(如UniSplat, GUIDE)。

多模态融合:突破纯视觉限制,与LiDAR、4D雷达深度结合,解决极端环境下的建图难题(如Rad-GS, Nighttime AD)。

物理与仿真:引入物理规律约束,实现可交互、可预测的4D动力学生成,为具身智能提供逼真的训练场(如NGFF, Zero-Shot UAV)。

工程化落地:通过软硬协同设计,不仅追求效果,更在移动端算力受限的情况下实现了实时运行(如Splatonic)。

3DGS已不再仅仅是NeRF的加速版,它正在成为构建下一代可交互、可理解的数字物理世界的核心载体。

参考资料:

[1] UniSplat: Unified Spatio-Temporal Fusion via 3D Latent Scaffolds for Dynamic Driving Scene Reconstruction.

[2] VR-Drive: Viewpoint-Robust End-to-End Driving with Feed-Forward 3D Gaussian Splatting.

[3] IDSplat: Instance-Decomposed 3D Gaussian Splatting for Driving Scenes.

[4] Nighttime Autonomous Driving Scene Reconstruction with Physically-Based Gaussian Splatting.

[5] GUIDE: Gaussian Unified Instance Detection for Enhanced Obstacle Perception in Autonomous Driving.

[6] Zero-Shot UAV Navigation in Forests via Relightable 3D Gaussian Splatting.

[7] PLANING: A Loosely Coupled Triangle-Gaussian Framework for Streaming 3D Reconstruction.

[8] Rad-GS: Radar-Vision Integration for 3D Gaussian Splatting SLAM in Outdoor Environments.

[9] Splatonic: Architecture Support for 3D Gaussian Splatting SLAM via Sparse Processing.

[10] Learning Physics-Grounded 4D Dynamics with Neural Gaussian Force Fields.

商务推广/稿件投递请添加:xinran199706(备注商务合作)

· 计划周期:深蓝学院将以3个月为一个周期,建立工程师&学术研究者的「同好社群」

· 覆盖方向:自动驾驶、具身智能(人形、四足、轮式、机械臂)、视觉、无人机、大模型、医学人工智能……16个热门领域

扫码添加阿蓝

选择想要加入的交流群即可

(按照提交顺序邀请,请尽早选择)

👇