🚗 龙哥读论文知识星球来了!还在为看不懂自动驾驶前沿论文发愁?星球每日拆解最新LLM+自动驾驶、机器人、端到端驾驶论文,核心方法、实验结果、开源代码一键获取!👇扫码加入「龙哥读论文」知识星球,让AI前沿驾驶技术为你“导航”!

龙哥推荐理由:

这篇论文瞄准了一个非常“接地气”的未来场景:在真正的无人驾驶出租车上,乘客如何与车辆交互?它没有停留在炫技,而是提出了一个实用且安全的框架,用LLM做“大脑”理解乘客的“人话”,再用传统可靠的规划器做“手脚”来执行,在保证安全的前提下,大幅提升了复杂指令的执行成功率。对于想了解如何将大模型安全落地到自动驾驶的同学来说,这是一篇不可多得的佳作。

原论文信息如下:

论文标题:

Open-Ended Instruction Realization with LLM-Enabled Multi-Planner Scheduling in Autonomous Vehicles

发表日期:

2026年04月

发表单位:

吉林大学,新加坡科技研究局 (A*STAR),同济大学,南开大学等

原文链接:

https://arxiv.org/pdf/2604.08031v1.pdf

想象一下,你坐进一辆全无人驾驶的“Robotaxi”,没有了方向盘和司机,你该如何告诉它你想做什么?是说“请开稳一点”,还是“靠边停一下,我拿个快递”?这正是未来高级别自动驾驶必须面对的“人机交互”终极难题。当前的自动驾驶研究大多盯着怎么“开得好”,却很少琢磨怎么让乘客“说得好”、“车听得懂”。今天要聊的这篇来自吉林大学、新加坡A*STAR等机构的论文,就瞄准了这个核心痛点。它提出了一个聪明的框架:让大型语言模型(LLM)充当“超级调度员”,理解乘客五花八门的“人话”指令,然后调度一队专业的“动作执行员”(传统运动规划器),安全、可靠地把指令变成车子的实际动作。告别方向盘?用自然语言指挥自动驾驶

现有的车载交互系统(HMI),比如车道偏离预警、定速巡航,基本都是为有司机的车设计的。一旦进入L4/L5级别的完全无人驾驶,比如Robotaxi,后座乘客成了交互主体,那些给司机的闪光灯、方向盘震动提醒就完全没用了。自然语言,无疑是最直观的交互方式。“我觉得有点快”、“超过前面那辆慢车”,就像跟人说话一样。大语言模型(LLM)的出现,让机器理解这些模糊、开放式的指令成为了可能。但问题来了:听懂只是第一步,如何安全、可靠、可追溯地执行才是关键。你让LLM直接去控制方向盘和油门?这太危险了!LLM有“幻觉”,可能胡说八道,而且它的输出是概率性的,不符合汽车功能安全(如ISO 26262)对决策链必须透明、可追溯的严苛要求。图1:使用开放式语言指令的类人HMI。“开放式”指的是多样化的自然语言表达方式,就像图中乘客说的“我觉得不安全”、“请开到路边停一下”。挑战A:开放、模糊的“动作级”指令理解真实场景的指令千奇百怪,不像导航命令那样标准。如何让AI理解“我觉得不安全”可能意味着“请变道到左边更通畅的车道”?挑战B:高效的行为调度与切换一个指令可能需要一系列动作组合(如:减速、观察、变道、加速)。如何在动态交通中,根据实时反馈,流畅地调度和切换不同的驾驶行为?挑战C:缺乏高保真、闭环的评估工具现有研究多在公开数据集或游戏级模拟器上做“开环”测试,而真正的“闭环”测试(即AI决策直接影响模拟中的车辆,并接收新的环境反馈)在真实交通模拟中还很欠缺。论文给出的答案,就是下面这个让人眼前一亮的“调度为核心”的框架。LLM化身“超级调度员”

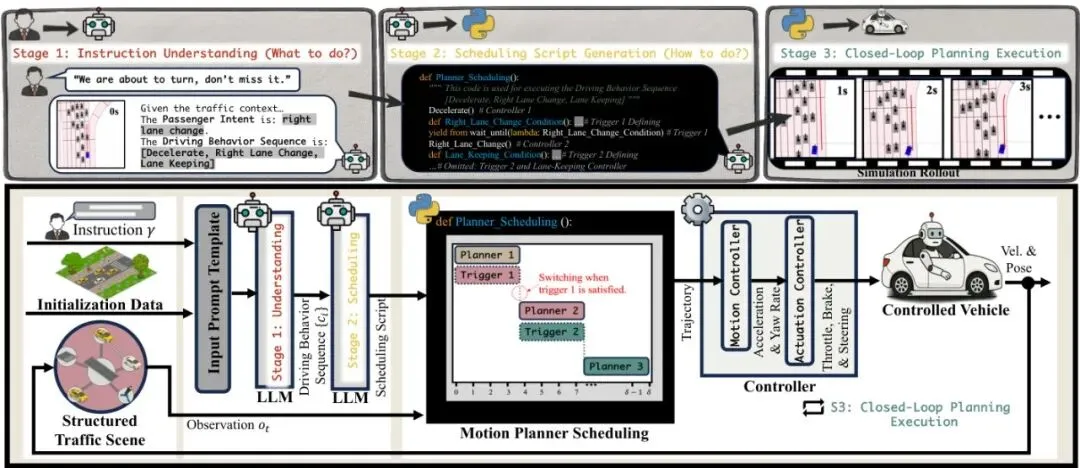

图2:由LLM驱动的以调度为中心的框架。它利用LLM解释乘客指令并生成可执行脚本。然后,该脚本调度多个运动规划器,利用实时反馈来实现指令。整个框架的精髓,可以用一句话概括:“LLM动脑不动手,专业规划器动手保安全”。它清晰地分成了三层:乘客说“我觉得不安全”。系统会把当前的交通状况(如“本车在中间车道,右侧车道车流更稀疏”)转换成一段文字描述,连同指令一起喂给LLM。LLM利用其强大的语义理解和世界知识,输出一个结构化的原子驾驶行为序列,比如:`[减速,向右变道,车道保持]`。这里限定了只有5种原子行为:车道保持、左变道、右变道、加速、减速。这个限制很重要,把天马行空的LLM输出锚定在了可控范围内。

图2:由LLM驱动的以调度为中心的框架。它利用LLM解释乘客指令并生成可执行脚本。然后,该脚本调度多个运动规划器,利用实时反馈来实现指令。整个框架的精髓,可以用一句话概括:“LLM动脑不动手,专业规划器动手保安全”。它清晰地分成了三层:乘客说“我觉得不安全”。系统会把当前的交通状况(如“本车在中间车道,右侧车道车流更稀疏”)转换成一段文字描述,连同指令一起喂给LLM。LLM利用其强大的语义理解和世界知识,输出一个结构化的原子驾驶行为序列,比如:`[减速,向右变道,车道保持]`。这里限定了只有5种原子行为:车道保持、左变道、右变道、加速、减速。这个限制很重要,把天马行空的LLM输出锚定在了可控范围内。第二层:调度脚本生成(还是LLM的活儿,但只干一次)

这是本文最核心的创新!LLM在理解意图后,不会频繁被调用,而是一次性生成一个可执行的“调度脚本”。这个脚本做两件事:1. 规定行为序列的执行顺序;2. 为每个行为切换设置异步触发条件。比如:“先执行‘减速’行为,直到与后车距离大于20米且车速低于60km/h时,触发切换到‘右变道’行为;变道完成后,自动切换到‘车道保持’行为。”图3:从调度角度对LLM驱动的AD方法进行分类。(a) 模式一:LLM在启动时设置系统参数,适用于静态偏好配置。(b) 模式二:LLM在动态交通中持续参与驾驶决策。(c) 模式三(本文):LLM单次调用产生调度脚本,使用异步触发器实现上下文自适应。TC 2-1表示规划器2的第一个触发条件。论文将现有LLM+驾驶的方法分成了三类(图3)。本方法属于模式三,它巧妙结合了模式一(单次调用,低开销)和模式二(能响应动态环境)的优点。脚本生成后,LLM的活儿就干完了。接下来,一个高速运行的“调度-规划-控制”内循环开始工作。“调度器”监控实时感知数据,一旦满足脚本里的触发条件,就切换“规划器”。每个原子行为(如左变道)都有一个对应的、基于模型预测控制的专业运动规划器。MPC规划器利用高精地图和车辆模型,在滚动时域内优化出安全、舒适的轨迹,最后由底层的控制器(如LQR)转换成油门、刹车、方向盘信号。看明白了吗?LLM只负责高层的、低频的语义理解和全局调度决策;而低层的、高频的、安全攸关的连续轨迹规划和车辆控制,完全交给传统、可靠、可验证的规划控制模块。这就好比LLM是公司的CEO,制定战略和计划(脚本),而各个部门的专业经理(MPC规划器)负责具体执行,确保任务安全落地。透明决策链:从“说人话”到“安全开”

这种“解耦”设计带来了一个巨大的优势:透明的决策链。你可以清晰地追溯:乘客的“人话”指令 → LLM理解后生成的“行为序列”和“调度脚本”(人类可读)→ 调度器根据脚本和实时条件触发 → 特定的MPC规划器计算出轨迹 → 控制器输出控制信号。如果出了问题,工程师可以检查是LLM的理解有误,还是脚本的触发条件不合理,或是某个MPC规划器的参数需要调整。这种可追溯性对于通过汽车功能安全认证至关重要。同时,这也形成了一个内置的安全机制:无论乘客的指令多么冒险,或LLM的输出多么“幻觉”,最终执行动作的永远是那些经过验证的、安全约束内的原子规划器。乘客和LLM被放在了“决策环”内,但“控制环”是独立且受保护的。POINT基准:给开放式指令“出考题”

光有方法不行,还得有把好尺子来衡量。论文的另一大贡献是提出了POINT基准。POINT是“Passenger Open-ended INstruction TesTbed”的缩写,即乘客开放式指令测试平台。它基于一个高保真的自动驾驶模拟器——nuPlan(使用了1300小时真实驾驶数据重建),并为其增加了1050对“指令-场景”数据。这些指令由真实指令和LLM生成指令混合而成,并经过人工筛选,确保质量和多样性。图4:指令意图分布。可以看到,约70%的指令涉及高风险横向操纵(如变道、超车、靠边停车),便于在高风险城市场景中进行集中评估。POINT还建立了一套全面的闭环评估指标,涵盖三大方面:

1. 任务相关:意图识别准确率、指令实现成功率。

2. 安全相关:无碰撞完成率、最小碰撞时间裕度。

3. 合规相关:在可行驶区域内的时间占比、遵守限速的时间占比、行驶方向正确的时间占比。有了统一的尺子和考题,就可以公平地比较不同方法了。论文还贴心地提供了多种基线方法,包括专业AD方法(如纯MPC规划器)和其他类型的LLM指令实现方法,为后续研究铺平了道路。实验结果:指令完成率飙升,安全不打折

首先,理解开放式指令确实不容易。如图5所示,只有参数量非常大的模型(如Qwen-2.5-72B, DeepSeekV3)意图识别准确率才能超过85%。这说明,想让车真正“听懂人话”,大模型的能力是基础。图5:不同LLM的意图识别得分。只有大规模模型(如Qwen-2.5-72B, DeepSeekV3, DeepSeek-R1)的识别率超过85%,推理机制和更大的上下文窗口能进一步提升性能。重头戏在指令实现的性能对比(表1)。所有基于LLM的方法都使用相同的DeepSeekV3 backbone,确保公平。表1:指令实现性能的定量比较。所有基于LLM的方法使用共享的骨干网络,指标为多次随机种子的平均值。每个指标在[0,1]范围内。核心结论1:任务完成率大幅领先在“指令实现”这项核心指标上,本方法达到了0.84,而其他两个指令实现基线方法DiLu++和Diffusion-ES分别只有0.51和0.28。这意味着本方法的成功率比它们高出64%到200%!这充分证明了“调度脚本”模式在连贯、可靠地执行复杂指令序列方面的优势。核心结论2:安全性与专业AD方法看齐更牛的是,在追求高任务完成率的同时,本方法在安全性(无碰撞率0.99)和合规性指标上,与顶尖的专业自动驾驶方法(如PDM)不相上下,甚至某些方面更优。这完美验证了其“解耦”设计的安全有效性:执行乘客指令,但绝不以牺牲安全为代价。再来看看消融实验(表2)和延迟分析(图7),进一步揭示了框架成功的原因。表2:关于交通上下文和LLM引导规划器调度的消融研究。消融实验证明:1. 提供交通上下文给LLM,能让意图识别准确率提升约10%。2. 如果没有LLM的高层调度,只是孤立地调用各个原子规划器,任务完成率会惨不忍睹(表中各行单独规划器的REA都很低)。这凸显了全局协调调度的必要性。图7:延迟敏感性分析。随着LLM决策延迟增加,指令实现分数逐渐下降,但安全指标保持稳定。延迟分析证明:本方法对LLM的推理延迟有很强的容忍度。即使引入延迟,任务完成率会下降,但安全性指标依然坚挺。这再次归功于架构:LLM只在开始时被调用一次生成脚本,后续的高频安全控制由独立的内循环保障,不依赖LLM的实时响应。最后,通过图6的定性示例,我们可以直观感受框架的执行过程。图6:指令执行过程中的关键帧。(a) 系统推断出隐含的变道意图,减速并汇入更慢、更密集的车道。(b) 响应靠边停车请求,通过变道并安全停车。未来之路:视觉融合与更智能的触发

当然,这项工作只是一个起点。论文也坦诚地指出了未来的方向:视觉融合:目前LLM理解指令依赖的是文本描述的交通场景,这必然会丢失大量细节。未来需要融合视觉-语言模型,让AI能直接“看”图理解更丰富的语义。更智能的触发:调度脚本的灵活性受限于预设的触发条件表达力。如何让系统能通过试错学习,甚至能在执行中自适应地重新调用LLM来调整计划,是提升通用性的关键。模拟器增强:nuPlan目前缺乏第一视角的图像渲染,限制了端到端视觉语言动作模型的评估。集成像3D高斯泼溅这样的先进技术来重建城市场景,对于全面评估至关重要。龙迷三问

这篇论文到底解决了自动驾驶的什么问题?它解决的是在未来完全无人驾驶(如Robotaxi)场景下,乘客如何用自然语言对车辆进行精细、动态的操控。比如,不只是“去机场”,而是“开稳一点”、“超过那辆慢车”、“靠边停一下”。核心是让AI既“听得懂”这些开放、模糊的指令,又能安全、可靠、可解释地执行。

文中的“MPC”和“调度脚本”具体指什么?

MPC,全称Model Predictive Control,即模型预测控制。它是一种先进的控制方法,通过车辆模型预测未来一段时间内的运动状态,并滚动优化,计算出当前最优的控制指令(方向盘、油门、刹车)。在本文中,它是负责每个具体驾驶动作(如变道)的“专业执行员”。

调度脚本是由LLM一次性生成的、人类可读的程序。它规定了:1. 要按什么顺序执行哪些原子动作(如先减速,再右变道);2. 每个动作切换到下一个动作的触发条件(如“当与后车距离>20米时”)。这个脚本是连接LLM高层理解和底层规划器执行的桥梁,也是实现透明决策的关键。

这种方法和端到端的自动驾驶模型有什么区别?有本质区别。端到端模型(尤其是视觉-语言-动作模型)追求一个模型吃下所有输入(图像、语言),直接输出控制信号。优点是简洁,但缺点是“黑箱”,决策链不透明,且安全性和可靠性难验证。本文的方法则是“白箱”或“灰箱”,它把任务分解,让LLM做它擅长的语义理解和调度,让传统可靠的MPC做它擅长的安全规划,各司其职,中间有清晰的接口(脚本)。这在需要功能安全认证的汽车行业,是更务实、更可能落地的路径。

如果你还有哪些想要了解的,欢迎在评论区留言或者讨论~龙哥点评

论文创新性分数:★★★★☆

将LLM定位为“脚本调度员”,而非直接的控制者或频繁的决策者,这个想法很巧妙。它不是在模型结构上搞花活,而是在系统架构层面做了清晰的职责划分,为解决LLM落地自动驾驶的安全与可解释性难题提供了一个优雅的范式。虽然核心组件(LLM, MPC)本身不新,但组合方式和视角有新意。

实验合理度:★★★★☆

自建POINT基准是一大亮点,填补了该任务评估的空白。实验设计全面,对比了多种类型的基线,并进行了细致的消融和延迟分析。扣一分是因为评估完全在模拟器中进行,尽管nuPlan很逼真,但与真实世界的复杂度和长尾风险仍有差距。

学术研究价值:★★★★★

价值很高。它明确提出了LLM+自动驾驶的一条务实技术路径,强调了安全、可追溯性与性能的平衡。提出的“调度为中心”的视角和三类模式分类,对后续研究有很好的启发性。POINT基准也为社区提供了一个重要的新评测平台。

稳定性:★★★★☆

架构设计本身极大地提升了稳定性。将不稳定的LLM限制在高层、单次调用,底层控制由确定性强的MPC保障,形成了天然的“安全屏障”。稳定性主要取决于集成的原子规划器本身的鲁棒性以及脚本触发条件的完备性。

适应性以及泛化能力:★★★☆☆

适应性受限于预设的原子行为库和手写的触发条件逻辑。对于完全超出库行为和触发条件表达能力的全新指令,系统可能无法处理。泛化能力主要依赖底层LLM的语义理解泛化能力,但执行层面的泛化有限。

硬件需求及成本:★★★☆☆

需要运行大规模LLM(如DeepSeekV3)进行初始理解,对算力有一定要求。但好在只需调用一次。日常运行时的“调度-规划-控制”内循环,其计算成本与使用传统MPC方案的AD系统相当,属于可接受范围。

复现难度:★★★☆☆

框架思路清晰,但完整复现需要:1. 获取并搭建nuPlan仿真环境;2. 接入大型LLM API或部署本地大模型;3. 实现一整套MPC运动规划器。POINT基准的指令数据如果开源将大大降低复现难度。目前看,对于有自动驾驶仿真和规划背景的团队,复现是可行的但有一定工作量。

产品化成熟度:★★☆☆☆

目前仅为研究原型,距离产品化还很远。需要经过真实车辆平台的集成测试、海量场景的闭环验证、功能安全流程认证(ISO 26262)、以及解决如何定义和扩展“原子行为库”和“触发条件”以覆盖足够多的用户指令等工程难题。但其架构理念非常符合车规级产品开发的安全导向。

可能的问题:本文的核心思路是“分工”,但分工的边界(什么归LLM管,什么归传统规划器管)需要精心设计且可能随场景变化。如何系统化地设计、验证和扩展那个“原子行为库”及“触发条件语法”,将是该方法能否真正走向实用化的关键挑战,论文对此着墨较少。

1. 原论文:Jiawei Liu, et al. "Open-Ended Instruction Realization with LLM-Enabled Multi-Planner Scheduling in Autonomous Vehicles." arXiv preprint arXiv:2604.08031 (2026).2. nuPlan 仿真器:https://www.nuscenes.org/nuplan3. POINT 基准(论文中提出):期待作者后续开源。*本文仅代表个人理解及观点,不构成任何论文审核或者项目落地推荐意见,具体以相关组织评审结果为准。欢迎就论文内容交流探讨,理性发言哦~ 想了解更多原文细节的小伙伴,可以点击左下角的"阅读原文",查看更多原论文细节哦!

🚗 想和更多自动驾驶、机器人领域的大佬一起“开车”吗?欢迎加入龙哥读论文粉丝群,

扫描下方二维码或者添加龙哥助手微信号加群:kangjinlonghelper。

一定要备注:研究方向+地点+学校/公司+昵称(如 自动驾驶+北京+清华+龙哥),根据格式备注,可更快被通过且邀请进群。