Public perception of autonomous vehicle capability determines judgment of blame and trust in road traffic accidents

公众对自动驾驶能力的认知决定了道路交通事故的责任判断和信任

作者:Qiyuan Zhang, Christopher D. Wallbridge Dylan M. Jones, Phillip L. Morgana

1.引言

当前法律体系以人类驾驶为核心设定,难以适配自动化车辆的责任划分,而自动驾驶系统决策过程难以解释,进一步加大责任认定难度。现有研究多关注日常使用中的信任与接受度,较少探讨事故发生后公众的责任归因与信任变化,且未揭示判断的情境差异。为此,本文通过模拟交通事故场景,开展两项实验,探究公众对自动驾驶系统与人类驾驶员的责任判定、信任评价是否存在双重标准,并检验因果线索强度的影响。研究试图明确公众对机器与人类能力的固有认知如何塑造事故判断,以期为政策制定、立法完善、公众科普提供依据,助力自动驾驶行业健康发展。

2.研究内容

本研究旨在探讨公众在道路交通事故中对自动驾驶车辆(AVs)与人工驾驶车辆(HDs)的归责与信任的判断差异。研究设计包括两项实验,使用图文结合的情境模拟交通事故。实验一通过六个不同场景操纵驾驶者类型(自动驾驶或人工驾驶)与事故严重性(未发生碰撞、轻微事故、重大事故),测量参与者对驾驶者和第三方的归责及信任。实验二进一步操纵场景中的因果线索强度(强/弱)以检验因果信息对归责和信任判断的调节作用。参与者通过在线平台完成实验任务,所有场景均呈现先行条件和事故结果,并随机化呈现顺序以控制顺序效应。研究收集了归责评分、信任评分以及参与者的驾驶经验和对自动驾驶技术的态度,用于后续分析行为判断的心理机制。

3.研究方法

本研究围绕自动驾驶交通事故中的责任归因与信任变化,开展两项连续递进的控制实验,全部实验采用在线情景模拟方式完成,通过标准化图文材料操纵自变量,使用量表测量因变量,并采用严格的统计方法检验假设。研究方法遵循心理学人机交互实验规范,保证内部效度与外部效度平衡,具体设计与流程如下。

3.1 实验一:基础场景下驾驶主体对责任与信任的影响

3.1.1 参与者

实验一通过Prolific Academic在线平台招募206名英国本土参与者,所有被试均满足18周岁以上、视力或矫正视力正常、无认知功能障碍等条件。为控制背景干扰,研究限定被试为英国常住居民,以保证对交通场景与责任认知的一致性。被试参与实验可获得3.75英镑报酬,单次实验时长约30分钟。

最终有效样本中,女性151人,占比73%,男性55人,占比26%,1人未报告性别;被试平均年龄31岁,标准差12,年龄范围18–70岁,覆盖青年至中老年群体。驾驶背景方面,137人持有有效驾驶执照,占总样本66%,持证者平均驾龄15年,年均行驶里程7190英里,具备真实驾驶经验,能够对驾驶事故做出合理判断。

为保证数据质量,实验中插入注意力检查题目,例如询问车辆颜色、避让方向等场景细节,被试平均正确率达到94.43%,表明被试认真完成实验,数据可靠有效。

3.1.2 实验设计

实验一采用2×3×6混合实验设计,变量设置如下:

自变量1:驾驶主体,为被试间变量,分为自动驾驶系统(AS)与人类驾驶员(HD)两组。AS组被告知车辆由 “安全记录完美的高级自动驾驶系统” 控制;HD组被告知车辆由“经验丰富、安全记录完美的人类驾驶员”控制。

自变量2:事故严重程度,为被试内变量,分为三个水平:险些碰撞(无接触、无危险)、轻微事故(有碰撞、无人员受伤)、严重事故(有碰撞、人员受伤)。

自变量3:事故场景,为被试内变量,共设置6种典型道路事故,分别为行人横穿、交叉口冲突、野生动物闯入、公交车盲区、儿童突然冲出、树木遮挡视线。

因变量包括三个:①目标操作者责任评分;②第三方责任评分;③事故后信任度评分。所有因变量均采用11点李克特量表进行测量,0代表完全不,10代表完全。

3.1.3 实验材料

实验材料采用图形+文字结合的情景描述形式,每个事故分为A、B两个部分。

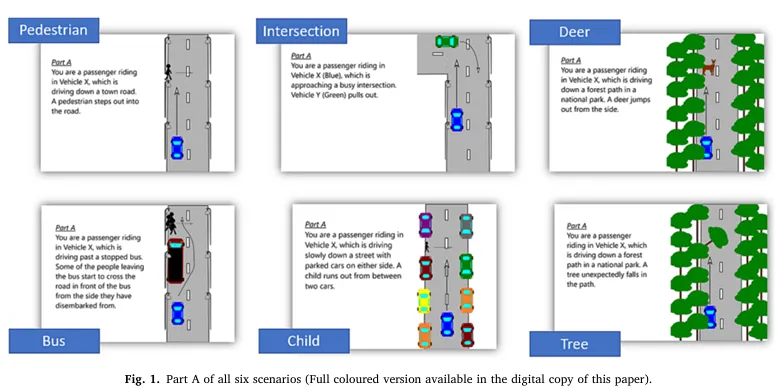

如图1所示,A部分为固定事故前置环境,以简笔画形式呈现道路、车辆、障碍物或危险目标,包括行人、路口、鹿、公交车、儿童、树木六类场景,保证场景清晰易懂。

图1 全部六个场景的A部分示意图

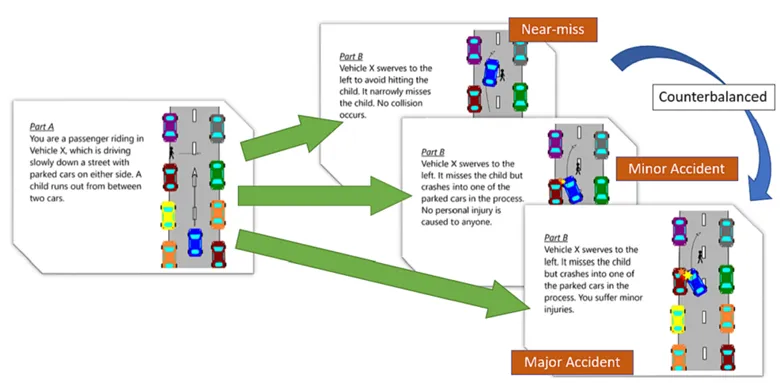

如图2所示,B部分描述车辆操作与事故结果,同一前置环境搭配三种严重程度的结果。以儿童场景为例,A部分描述为:车辆在两侧停满车辆的街道低速行驶,儿童从两车之间突然冲出;B部分分别对应:车辆成功避让、车辆避让时撞到停放车辆无伤亡、车辆避让时撞到停放车辆导致乘客受伤。所有场景长度、复杂度保持一致,避免阅读差异带来的干扰。

图2 “儿童”场景的A部分与三种结果版本的B部分示意图

3.1.4 实验流程

被试点击实验链接后,首先进入知情同意与基本信息填写页面,填写年龄、性别、驾驶经历等内容。随后完成初始态度测量,使用11点量表评定对自动驾驶或人类驾驶的使用意愿与初始信任。

正式实验阶段,被试以随机顺序观看全部18个事故片段(6个场景×3种严重程度),每个片段观看完毕后,依次评定目标操作者责任、第三方责任与事后信任度。为避免顺序效应,场景顺序与严重程度顺序均随机化呈现。实验过程中插入注意力检查题目,用于剔除无效数据。

全部实验结束后,被试接受实验说明,并可留下主观评论,研究人员对数据进行筛选与整理。

3.2 实验二:因果线索强度对责任与信任的调节作用

3.2.1 参与者

实验二在实验一基础上,继续招募200名英国成年被试,纳入标准、居住要求、视力要求与实验一完全一致,被试报酬提升至7英镑,实验时长约60分钟。

有效样本中,女性125人,男性74人,1人未报告性别;平均年龄34岁,标准差13,年龄范围18–73岁。152人持有驾驶执照,占比76%,平均驾龄18 年,年均行驶里程6727英里。注意力检查题目平均正确率为95.69%,数据质量较高,可用于后续统计分析。

3.2.2 实验设计

实验二采用2×2×2×4 混合实验设计,在实验一基础上新增核心自变量,并简化部分条件:

自变量1:驾驶主体(AS/HD),仍为被试间变量,操作方式不变。

自变量2:因果线索强度,为被试内变量,分为强因果线索与弱因果线索。强线索代表危险可预判,人类驾驶员能凭借经验提前察觉;弱线索代表危险突发、无预警,只能依靠快速反应规避。

自变量3:事故严重程度,简化为两个水平:险些碰撞与严重事故,保留差异最显著的条件。

自变量4:事故场景,保留4个关键场景:行人、争吵行人、公交车/货车、儿童。

因变量与实验一相同:责任评分、第三方责任评分、信任评分,量表形式保持一致。

3.2.3 实验材料

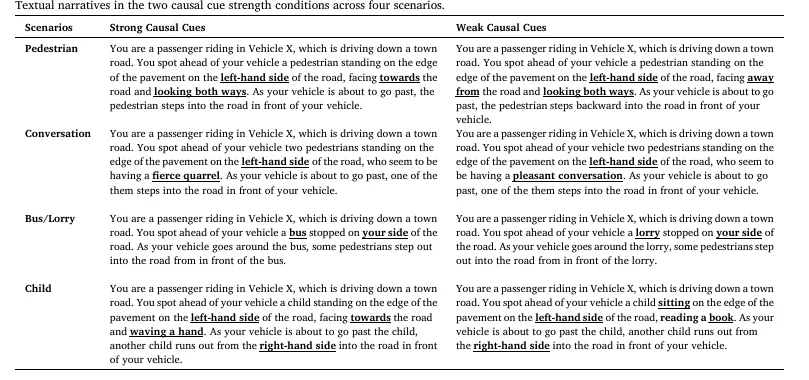

实验二沿用实验一的图文呈现形式,重点通过文字细节操纵因果线索强度,如表1所示,对同一场景分别设置强、弱两种版本。

表1 四个场景在强、弱因果线索条件下的文字描述

在行人场景中,强线索版本为行人面对道路左右观察后进入车道,提示危险即将发生;弱线索版本为行人背对道路突然后退进入车道,无任何预警。在公交车/货车场景中,强线索为公交车停靠,行人出现概率高,可预判;弱线索为货车停靠,预判性低。儿童场景中,强线索为儿童挥手示意,弱线索为儿童安静看书,另一儿童突然冲出。所有材料保持语言长度、描述方式一致,仅操纵线索可预见性。

3.2.4 实验流程

实验二流程整体与实验一相同,仅在正式实验前增加练习场景,帮助被试熟悉评分流程。被试首先完成基本信息填写与初始态度评定,随后随机观看所有事故片段,完成责任与信任评分。实验场景、线索强度、严重程度的呈现顺序均随机化,以平衡顺序误差。实验结束后进行说明与致谢,数据回收后进行标准化处理。

3.3 数据收集与分析方法

本研究全部数据采用线上问卷系统收集,定量数据使用SPSS进行统计分析。主要分析方法包括:混合设计方差分析,用于检验驾驶主体、严重程度、场景、因果线索强度的主效应与交互效应;Pearson相关分析,用于检验初始态度与责任、信任之间的关系;事后检验用于进一步分析组间差异。显著性水平统一设定为α=0.05。

4 研究结果

4.1 实验一结果

4.1.1 责任判定差异

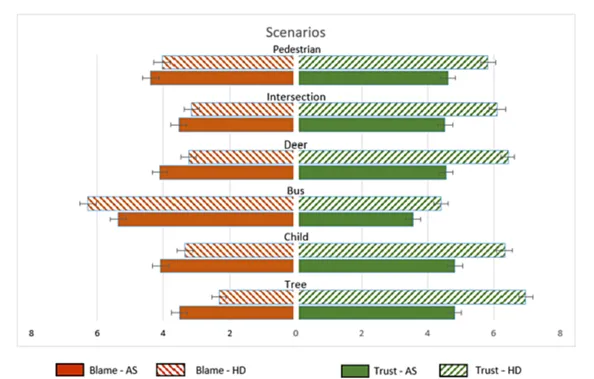

以操作者类型(AS/HD)为被试间变量,事故严重程度与场景类型为被试内变量,对责任评分进行混合方差分析。结果显示,操作者主效应显著(F (1,204)=7.86,p=0.006,η²=0.04)。在6个场景中,5个场景下自动驾驶系统被赋予的责任显著高于人类驾驶员;仅在公交车场景中出现显著反转,人类驾驶员责任显著更高(F (1,204)=6.81,p=0.010,η²=0.03)。如图3所示,场景与操作者的交互效应显著(F (5,1020)=8.28,p<0.001,η²=0.04),表明责任分配具有高度情境依赖性。

图3 所有场景下人类驾驶员与自动驾驶系统的责任评分、事故后信任度均值

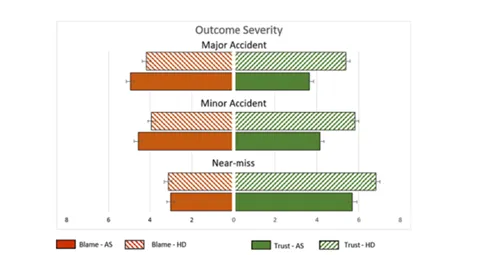

事故严重程度与操作者的交互效应同样显著(F (2,408)=12.72,p<0.001,η²=0.06)。简单效应检验显示,仅在轻微事故与严重事故条件下,自动驾驶系统的责任显著高于人类驾驶员;在险些碰撞条件下,两组无显著差异。如图4所示,事故后果越严重,自动驾驶系统与人类驾驶员之间的责任差距越明显。

图4 三种事故严重程度下人类驾驶员与自动驾驶系统的责任评分、事故后信任度均值

第三方责任分析显示,公交车司机、景区管理方等第三方主体的责任评分与目标操作者责任呈互补模式。当自动驾驶系统责任更高时,第三方责任更低;当人类驾驶员责任更高时,第三方责任更高。第三方类型与操作者交互显著(F (7,2856)=2.27,p=0.027,η²=0.01)。

4.1.2 信任度差异

事故后信任评分与责任评分呈现显著的镜像负相关关系。操作者主效应显著(F (5,1020)=6.12,p<0.001,η²=0.03),自动驾驶系统的信任度显著低于人类驾驶员。如图3所示,信任模式与责任模式高度一致,公交车场景下两组信任差异最小,但未出现责任评分中的反转趋势。

事故严重程度与操作者交互显著(F (2,408)=6.50,p=0.002,η²=0.03)。险些碰撞条件下信任差异最小;轻微事故与严重事故后,自动驾驶系统的信任度明显下降。相关分析显示,责任与信任呈显著负相关:AS组r=-0.31~-0.49(均 p<0.01);HD组r=-0.46~-0.49(均 p<0.001)。

4.1.3 初始态度与责任、信任的关系

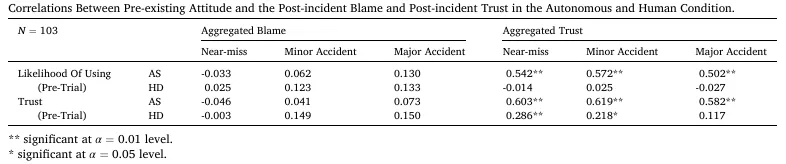

将实验前测得的初始使用意愿、初始信任与事故后责任评分、信任评分进行相关分析。如表1所示,责任评分与初始态度无显著相关,表明责任判断主要由事故情境决定,不受先验态度影响。

与之相反,事后信任与初始态度呈显著正相关,且自动驾驶组的相关强度远高于人类驾驶员组。AS组初始信任与事后信任的相关系数在三种严重程度下分别为0.603、0.619、0.582;HD组相关系数普遍偏低且部分不显著。如表2所示,这一结果说明,公众对自动驾驶的信任建立在对技术的整体印象之上,而对人类驾驶员的信任则基于个体行为表现。

表2 自动驾驶组与人类驾驶组初始态度和事故后责任、信任的相关性

4.2 实验二结果

4.2.1 因果线索强度对责任判定的影响

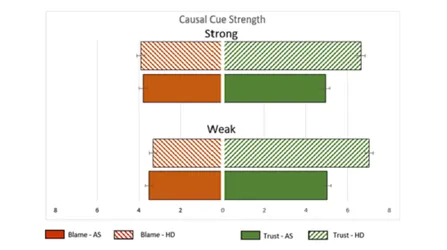

实验二新增因果线索强度变量,采用2(操作者)×2(因果线索)×2(严重程度)×4(场景)混合设计。方差分析结果显示,因果线索强度 × 操作者交互效应显著(F (1,198)=4.68,p=0.032,η²=0.02)。简单效应检验表明:

弱因果线索条件下,自动驾驶系统责任显著高于人类驾驶员;

强因果线索条件下,人类驾驶员责任显著高于自动驾驶系统。

如图5所示,因果线索强度完全反转了责任分配模式。

图5 两种因果线索强度下人类驾驶员与自动驾驶系统的责任评分、事故后信任度均值

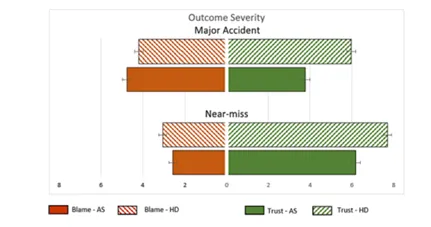

事故严重程度与操作者交互效应显著(F (1,198)=19.07,p<0.001,η²=0.09),严重事故中的组间差异显著大于险些碰撞。如图6所示,事故严重性进一步放大了责任与信任的组间差距。

图6 两种事故严重程度下人类驾驶员与自动驾驶系统的责任评分、事故后信任度均值

4.2.2 因果线索强度对信任度的影响

信任评分呈现与责任评分高度一致的变化规律。因果线索强度×操作者交互效应显著(F (1,198)=13.87,p<0.001,η²=0.07)。弱因果线索条件下,人类驾驶员信任显著高于自动驾驶系统;强因果线索条件下,两组信任差异大幅缩小。公众对机器快速反应能力与人类经验推理能力的刻板印象,直接决定信任水平。

第三方责任分析显示,因果线索强度主效应显著(F (4,792)=14.20,p<0.001,η²=0.07),线索越强第三方责任越低;但第三方责任与操作者无交互(F (1,198)=0.03,p=0.870,η²<0.01),说明第三方责任仅受情境可预见性影响。

5.结论

本研究通过两项实验探讨了公众在交通事故中对自动驾驶系统(AV)与人类驾驶员(HD)的责任归因与信任判断。结果表明,人们对AV和HD适用不同标准,这种差异是基于对其能力的认知,并随情境变化而调整。当事故发生在可预测性高的情境中,人们倾向认为人类驾驶员应更好地预判并避免事故,从而归因更多责任;而在反应速度和操作精确性关键的突发情境中,AV被归因更多责任。信任评价与责任归因密切相关,但与HD不同,AV的信任不仅受特定车辆表现影响,还依赖于公众对自动驾驶技术整体的信任。这种差异反映了人们对AV能力的“同质性”认知,即认为所有自动驾驶系统相似,因此单一负面事件可能影响整体信任。研究提示,法律、政策制定及制造商需关注公众对AV能力的认知偏差,通过教育、信息披露和用户培训定期校准期望,以促进技术接受与安全应用。

6.参考文献

Zhang, Q, Wallbridge, C. D., Jones, D. M., & Morgan, P.L.(2024). Public perception of autonomous vehicle capability deter mines judgment of blame and trust in road traffic accidents.Iransportation research part A: policy and practice, 179, 103887.

7.点评

本研究针对自动驾驶交通事故中公众的责任归因与信任变化开展两项控制实验,研究问题明确、逻辑清晰,具有较强的理论价值与现实意义。研究突破了以往观点,证实公众并非对自动驾驶施加统一的更高标准,而是依据场景的因果线索强度采取双重判断:弱线索下自动驾驶因反应能力预期被归咎更多责任,强线索下人类驾驶员因预判预期被赋予更多责任,有效解释了现有研究的矛盾结论。同时,研究发现公众将自动驾驶视为同质化群体,单次事故易引发整体信任崩塌,丰富了人机信任与责任归因的理论体系。研究方法严谨,变量操纵规范,样本量充足,结果可靠。但研究仍存在局限,如采用图文模拟场景,生态效度不足;样本局限于英国人群,跨文化适用性有限;信任测量以主观评价为主,缺乏客观指标。总体而言,该研究为自动驾驶立法、科普与行业传播提供了重要实证依据。

注:由于水平有限,翻译中难免存在不准确或错误之处,请以原文为准,并欢迎指正。

知识搬运工(翻译者)丨 吉丹凤

审核丨 周斌

出品丨 合肥工业大学 运输与安全研究所

版权声明

本文为《合肥工业大学 运输与安全研究所》独家撰写,如需转载,

请注明出处,谢谢!