▲ 自动驾驶的本质,是在高维黑盒中寻找绝对的安全边界。图片仅示意

▲ 自动驾驶的本质,是在高维黑盒中寻找绝对的安全边界。图片仅示意💥 开篇暴击:狂飙的算力与危险的“大跃进”

现在的智驾算法圈,正蔓延着一种非常危险的“大跃进”风气。

大家为了把动辄几十亿参数的端到端大模型(如 UniAD、VLA 架构)塞进算力捉襟见肘的车端域控制器里,疯狂地搞模型压缩。汇报的 PPT 上写得极其漂亮:

作为带过量产项目的老兵,我每次看到这种数据,后背都会冒冷汗。

为什么?因为深度学习是一个极度非线性的高维黑盒。mAP(平均精度均值)只掉了 0.5%,在统计学上看似完美,但在自动驾驶这种“容错率为零”的场景里,这丢失的 0.5% 如果恰好发生在一个罕见的“前车紧急加塞(Cut-in)”或者“弱光环境下的异形障碍物”特征上,到了规控端(Planning & Control),就会演变成一次导致车毁人亡的“幽灵刹车”或“直撞”。

在自动驾驶这个命悬一线的行业里,“跑得快”只是及格线,“不出错”才是不可妥协的底线。

今天,我们就把大模型部署的遮羞布撕开,深度拆解一条极其严苛的 P0 级标准准出作业流程(SOP),以及如何用数学手段进行白盒级的“多维一致性校验”。

🧠 底层逻辑:扒皮抽筋式的多维一致性校验

一个经过深度加速优化的模型,绝对不能直接拿去上车。在讲校验之前,我们先给非算法背景的兄弟们科普几个“黑话”:

💡 知猷科普时间:模型压缩术语

- 剪枝 (Pruning):就像修剪树枝,把神经网络里不重要的“神经元连接”砍掉,减轻模型重量。

- 量化 (Quantization):把高清的4K电影压缩成720P。用更少的数据位(比如从32位浮点数FP32变成8位整数INT8)来存储模型权重,省空间、提速度。

- PTQ (训练后量化):模型练好了,直接强行压缩。简单粗暴,但容易掉精度。

- QAT (量化感知训练):边训练边模拟压缩,让模型提前适应“变笨”的感觉,精度保留更好。

无论是 PTQ 还是 QAT,模型压缩后必须经历一套标准闭环:需求分析 -> 算子剖析与极致压榨 -> A/B 测试(闭环仿真/影子模式) -> 准出交付。

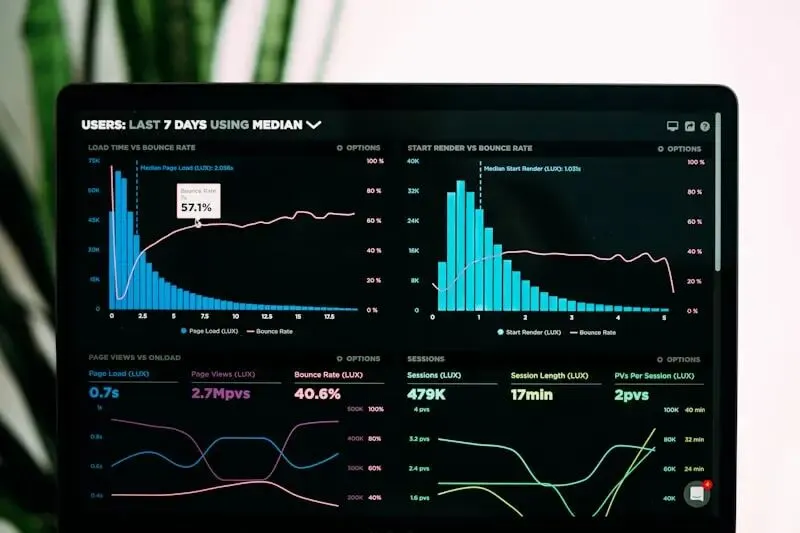

在这个闭环中,最核心的命脉是多维一致性校验(Multi-dimensional Consistency Verification)。这绝不是跑个测试集看看准确率就完事的,它必须从以下三个维度进行比对:

1. 数值一致性:防微杜渐的 Tensor 级对齐

我们不能只看最终输出,必须把大模型像切香肠一样切开,进行逐层特征输出校验。当我们将高精度的 FP32 权重压缩为 INT8 时,必然会产生截断误差。我们需要严格监控其相对误差或余弦相似度(Cosine Similarity)。

如果在网络深层,相似度突然从 0.99 掉到 0.85,说明这一层极有可能出现了激活值异常(Activation Outliers)。特别是 Transformer 架构中,暴力的线性量化会直接抹杀关键注意力权重。遇到这种情况,必须引入 SmoothQuant 等算法平滑异常值,甚至进行混合精度部署。

2. 统计一致性:分布不漂移

把优化前后的模型放在同一个海量验证集里跑,对比输出的概率分布特征。这里通常引入 KL 散度(Kullback-Leibler Divergence)。

通俗解释:KL散度就是衡量两个概率分布差异的尺子。如果量化前的置信度均值是 85%,量化后虽然大部分也预测对了,但分布变得极其扁平,KL 散度飙升。这意味着模型变得“极度不自信”。在下游的规控状态机里,这种不自信会导致车辆在路口频繁地“犹豫、点刹、画龙”。

3. 功能一致性:业务指标咬合

这是最贴近真实驾驶体感的一环。我们需要通过闭环仿真,对比优化前后车辆在同一场景下的动力学表现。关注的核心不再是 Loss 曲线,而是规控硬指标:

同时,利用 WandB (Weights & Biases)(算法工程师的“飞行记录仪”,用于追踪每次实验的参数和指标) 这样的 MLOps 工具,将技术降级指标与业务痛点完美咬合。只要底线指标守得住,量化方案才算达标。

▲ 严苛的白盒校验:不要只看最终结果,要看每一层特征的分布漂移。

▲ 严苛的白盒校验:不要只看最终结果,要看每一层特征的分布漂移。📓 知猷回忆录:一辆凭空消失的清障车

这段避坑史,是实打实用血汗和惊吓砸出来的。

记得 2021 年底,我在某头部大厂带队搞高阶 L4 无人车量产架构时,工程组接到了一个 P0 级任务:将核心的 3D 占据网络(Occupancy Network)和轨迹预测模型,从云端的 FP32 暴力塞进车端的某国产 100+ TOPS 算力芯片中。

第一版 PTQ 跑完,工程兄弟们很兴奋,延迟直接砍了 70%,在内部的 10 万帧测试集上,IoU 只掉了 1%。大家觉得稳了,直接合入主干代码,推到实车上跑封闭测试场。

结果,在测试“大曲率弯道+前方有静止清障车”这个极端场景时,车辆竟然在距离清障车不到 5 米的地方才触发预制动(Pre-brake),最后是安全员一脚将刹车踏板踹到底,才避免了价值百万的测试车报废。

那天晚上整个团队复盘到凌晨四点。我们把出事那一帧的数据落盘,写脚本一层一层地比对 Tensor。最后发现了极其诡异的 Bug:

在量化后的模型眼里,那辆巨大的清障车,直接凭空消失了。

原因在于,在 Transformer 的某一层 Cross-Attention 中,清障车边缘的几个体素产生了一个极大的负激活值。在 FP32 下,这个值被正常传递,使得模型判定前方为“占据”;而在 INT8 静态量化中,由于校准集里没有覆盖到这种极端的清障车长尾场景,截断阈值设得太小,导致这个关键的负激活值直接被“削平”成了 0。

从那以后,我在团队的 MLOps 平台上立下了一条铁律:禁止唯 mAP 论。我们硬生生花了一个月时间,开发了一套基于 KL 散度和余弦相似度的自动化白盒校验流水线。任何量化模型提交,必须过这道“安检仪”。

🛡️ 实战避坑:老兵的3条保命建议

对于正在做端到端大模型部署和底层性能优化的团队,老兵给出 3 条硬核“保命”建议:

- 1. “敏感度分析”是量化的绝对前提:在动手压缩之前,先做一套逐层的敏感度摸底。找出那些对精度极度敏感的层(通常是靠近输出的解码器层、或者包含 Softmax 的 Attention 模块),这些地方必须采用混合精度部署,该用 FP16 的地方一刀都不能切。

- 2. 校准集(Calibration Set)的质量决定生杀大权:做静态量化时,用来计算缩放因子的校准集,绝对不能随便拿 1000 张白天的正常行驶照片凑数。必须包含暴雨、逆光、极端遮挡、异形车等高熵长尾场景。

- 3. 把 WandB 和 CI/CD 刻进团队的 DNA:别再用 Excel 记各种实验的量化参数了。把 WandB 等工具深度集成到流水线里,每一次算子的改动,都必须自动生成与 Baseline 模型的轨迹偏移对比曲线。

▲ 真正的工程化,是把每一次试错都沉淀为自动化的流水线规则。图片仅示意

▲ 真正的工程化,是把每一次试错都沉淀为自动化的流水线规则。图片仅示意💰 变现转化区:拿走我的实战弹药库

🎯 知猷·新能源智库 | 你的随身技术军师

👇 获取更多硬核资源 & 搞钱路子 👇

- 🚗 微信公众号:搜索 “知猷”,关注后点击“发消息”,长期围观老兵的造车手记。

- 📕 小红书号:知猷-新能源智库 或搜 ZhiYou_Auto

- 🐠 闲鱼捡漏:独家脱敏PPT/行业报告/架构脑图(闲鱼搜索用户“知猷新能源咨询”)

💸 打赏随意:如果这篇文章帮你省了加班时间,欢迎打赏,金额随意,交个朋友!

关注知猷君,在浮躁的时代,我们只谈有逻辑的技术。