端到端狂飙突进的 2025 年

注:本文中由于习惯会混用自动驾驶和辅助驾驶,请注意所述自动驾驶严格意义上应对应 SAE 分级中 小于 level4 的辅助驾驶

2025年底,在行业的狂飙突进之下,端到端这个词成为了被各个公司最多提起的关键词。

从 MMT 在高阶 NOA 市场中的一路高歌猛进,到地平线 HSD 的技惊四座,似乎端到端自动驾驶已经成为了行业的最大共识。大家交流之时,最多的话题已经从“你们时空联合规划搞得如何”转变成了“你们一段式端到端什么时候上线”。

站在这个时间节点,领先的领跑者们的数据飞轮在一天天回转,无声却又似乎滴答作响——

追赶者们无不在所谓 rule-base 方案遭遇挫折或者冷遇的情况下痛定思痛,准备紧紧跟随。

似乎,这个时刻,已经说明了自动驾驶的终局。

那么,我们不妨先来关注一条同样发生在年底的新闻:雷锋网:谁杀死了毫末智行

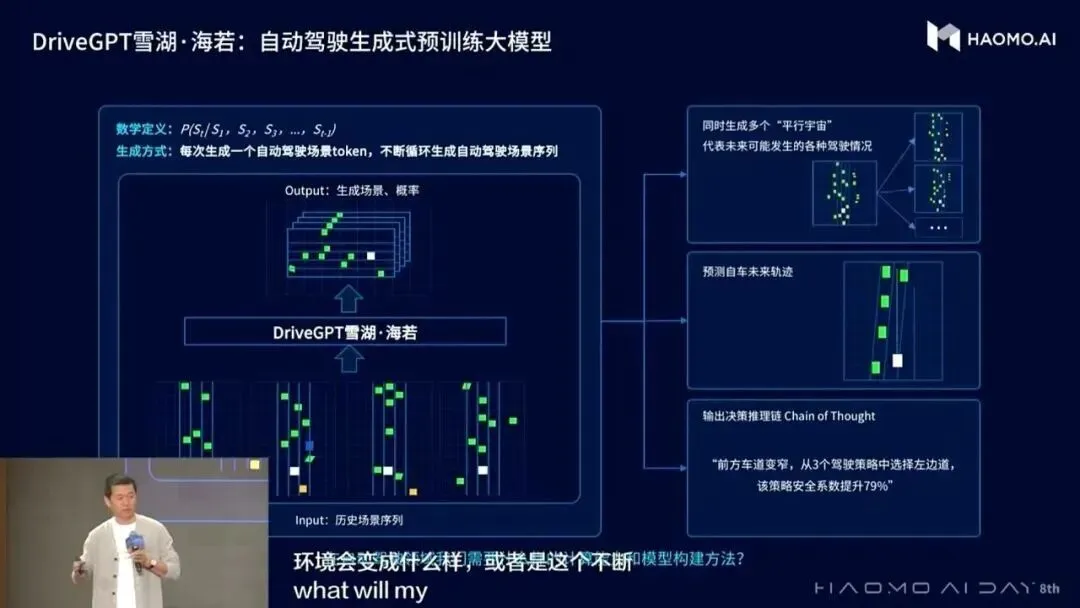

说起这家公司,其实映照在我脑海里面的,首先便是著名的 drivegpt

在刚刚 llm 领域所谓 gpt 时刻之后,毫末似乎是当时最先跟进,并且声量最大的 TIER1,可是后面证明其实他们甚至无法交付合格的高速 NOA

我把毫末的陨落,归因于步子太大:在提出所谓 drivegpt 的当年,感知的范式已经非常成熟(得益于特斯拉 ai day 的大力宣传?笑),也就是说做出一套能满足 L2 级别的 NOA 量产的感知系统其实并不十分困难。以长城的体量和毫末当时的态势,显然工程上并无困难。可是,他们的目光瞄准的是更加复杂的规划模型化,而无论是数据基建还是对于规划的理解,显然无法支撑他们的雄心。

毫末并非是压错了宝,而是根本不具备押宝的条件:因为本身规划任务比感知就要复杂非常之多。

我们经常会在网上看到这样的声音,说感知系统本身就不可能做到百分之百的准确,规划系统需要感知的性能那么高是不可能做到,也是不合理的。这样的声音在作为一个规划背景的工程师看来,确实有一定的道理,但是如果你想要做端到端,特别是一段式端到端你的感知模块的需求其实就是需要百分之百的准确,这就是一个悖论——

比如,你如何做到显然是绿灯的时候依靠右侧的车辆进行推理,刹车避让闯红灯的行人;又比如,你是如何避免模型忽略了像素非常之小的红绿灯,反而学到了其他车辆的减速误认为是因果呢?

这样就引出了端到端的核心问题,只是拟合出关联性便足够吗?

自动驾驶的规划范式:巨量参数的拟合函数足够自动驾驶?

让我们回顾王乃岩老师的文章: 聊聊端到端与下一代自动驾驶系统 - Naiyan Wang的文章 -知乎

其中在 2024 年上半年是对端到端这样判断的:“我个人的观点认为至少并非只有端到端才能解决这些问题,端到端可能也不是解决这些问题最好的一个方案。传统方法是可以解决好这些问题的。当然,在数据量足够大的时候,端到端可能会提供一个还不错的solution。”

站在这个节点,很多人肯定会质疑,你看 MMT 和 HSD 的方案是如此的惊艳,王老师的判断话说早了。在媒体的诸多 PR 的声音中,我们可以总结出,“完全端到端自动驾驶”的以下特点:

- 不可以精确控制时距,不可以精确控制限速

- 左右转或者非对齐的直行路口,一头扎进哪根车道/跨线是不可控制的

就拿第一条来说,这是最初的 L1 级别的辅助驾驶就能很好的解决的问题,号称武林天下第一的端到端反而不能处理,很让人诧异。

这些现象(限速不可控、路口点刹)在物理学中可以被视为系统的相变失控。在 Ising 模型中,当温度接近临界点时,关联长度会趋于无穷大,系统对任何扰动都极度敏感。当前的端到端自动驾驶模型就像一个永远运行在临界区边缘的系统,因为它缺乏哈密顿量(物理约束)的锚定。一个像素点的变化(比如路边闪烁的霓虹灯)可能在几亿个参数的传导下,被放大为一次紧急制动。这种缺乏‘物理守恒’的系统,本质上是在用海量的随机性去博取极小概率的稳定性。”

退一步讲,其实被端到端系统比照下去的,往往是粗糙的 apollo 系统,之所以我说是粗糙 的一词,是很多基于 apollo 构建的 L2 辅助驾驶系统,既没有合理的数据闭环的思路,真的只会用表格记录一个又一个的路试case,修改一波 qp 的参数,然后继续上车,甚至可能之前的正向 case 都变成负向了;又没有很好的理论指导,遇到强交互的场景,要么批判感知性能差(可能感知性能就是很差,笑),要么说 apollo 这个时空分离先 path 后 speed 上限太低云云。

其实,要说 apollo 的上限,可能先预测后决策才是真的上限所在,不过此处按下不表。限制所谓 rule based 系统的,首先没有好的数据闭环就跛了一只脚,然后内部算法没有进行调优又崴了一条腿。正如王老师文章中所言:

传统方法 = rule based if else?

这个观念也是我在和很多人的交流中需要反复纠正的。按照很多人的定义,只要不是纯数据驱动,就叫做rule based。

我以为,假设对于一个规划系统,有着充足的数据闭环产生的燃料,外加一个好的 formulation,自然是可以做好自动驾驶的。而端到端系统,刚好就是战胜了粗糙的 apollo 而已。

如果说,之前的系统是粗笨的 rule based 系统,端到端代表的思路,依然是一种基于数据进行拟合的 imitation based 系统

当然,很多端到端的拥趸会马上说,数据可以 scaling 然后会有涌现,比如加上 VLA 就可以如何云云。我自忖不是这方面的专家,但是我可以从更加剥离的角度跳出具体的名次之争,提供一个视角供大家参考。

显然,端到端的核心思路是,基于海量的专家数据,基于深度神经网络将信息进行无损传递,以执行具体的场景任务——所以本质是从海量数据中进行一个函数的建模,只是说这个函数的形式没有那么显式,其中还有很多难以直接表征的隐变量罢了——正好,从合理观测的有限数据抽离出具体的规律,是从物理学的祖师爷牛顿开始人类科学进步的核心手段。让我们假设回到上个世纪,用端到端的思路做一做统计物理教科书中的经典模型——Ising 模型。

在 Ising 模型临界点,关联长度趋于无穷大,系统极度敏感。自动驾驶的复杂场景就是这个“临界区”,微小的输入扰动在黑盒模型中被指数级放大,最终导致不可预测的输出(如莫名点刹)。

以下是我用 gemini 生成的一个虚拟的假设性的小故事,以此结束本文,并祝各位读者新春快乐!

尾声:一场伊辛模型的追悼会

1924 年,恩斯特·伊辛(Ernst Ising)绝不会想到,一百年后,人类解决问题的方式不是通过逻辑推理,而是通过“大力出奇迹”。

如果把现在的端到端自动驾驶逻辑搬进物理实验室,凝聚态物理的画风大概是这样的:

一、 拒绝建模的“先知”

一位年轻的“大模型物理学家”站在黑板前,黑板上没有哈密顿量,只有一行巨大的代码:model.train(spin_data)。

他充满怜悯地看着那些试图推导磁化强度曲线的老教授,冷笑道:

“教授,您还在纠结相邻格点间的相互作用?太底层了。我喂了 100PB 的格点图像数据给 Transformer。模型虽然不知道什么是‘自旋’,但它能精准预测在 2.269 凯尔文时,图像会变得‘杂乱’。我们管这叫‘端到端相变预测’。至于对称性破缺?那只是高维张量里的一个扰动项罢了。”

二、 普适性的葬礼

在物理学中,普适性(Universality)是最高级的浪漫——它告诉我们,无论你是一块铁还是一个流体,临界指数是一样的。

但端到端流派的首席架构师对此嗤之以鼻:

“为什么要普适性?我这套模型在‘加州阳光牌’铁块上跑得非常稳。如果换成‘西伯利亚牌’铁块报错了,那说明我的数据分布(Distribution)没覆盖到位。只要再采集五万公里的低温格点数据,模型就能‘自适应’。物理规律只是数据量不够时的拙劣借口。”

三、 讽刺的“临界事故”

某天,实验室发生了一场悲剧。

模型预测系统在强磁场下表现完美,但在一个极其微小的扰动下,整个模拟系统突然崩溃。老教授冲上去问:“发生了什么?是关联长度(Correlation Length)发散了吗?是有限尺寸效应吗?”

架构师一边重启服务器,一边轻描淡写地回答:

“不,教授。只是这个格点排列在训练集里没出现过,模型把它识别成了‘红绿灯’,然后触发了紧急刹车。这不是物理问题,这是Corner Case(边界案例)。我们不需要理解它,只需要打个补丁(Fine-tune)。”

四、 科学的终点

短文的结尾,人类终于推导出了“终极物理模型”。

那是一个拥有 10 万亿参数的 .bin 文件。它能模拟从超导到超流的一切现象。人们不再讨论费米面,不再讨论布里渊区。如果有人问:“为什么金属会导电?”

答案不再是能带理论,而是:

“因为我问了模型,模型说是的。”

尾声:来自伊辛的幽灵告白

伊辛的幽灵在实验室飘过,看着那台嗡嗡作响、消耗着几个核电站电力来拟合“水会结冰”这一事实的超级计算机,留下了最后一句话:

“以前我们试图用最简单的公式解释宇宙;现在你们试图用最复杂的模型,去模仿一个连你自己都解释不清的直觉。你们不是在研究物理,你们是在用算力给‘无知’镀金。”