【自动驾驶】自动驾驶世界模型为何如此高效?EPFL的MAD提出“先动后画”新范式

- 2026-03-16 23:56:16

【自动驾驶】自动驾驶世界模型为何如此高效?EPFL的MAD提出“先动后画”新范式

主要传递正能量,顺便分享小知识

初衷是为了方便自己,方便读者快速了解CV领域最新学术动态,偶尔更新若干篇论文概览。内容包括但不限制于目标检测,分割,3D重建,分类,LLM,自动驾驶,机器人,VR、AR,多模态,欢迎大家点赞+关注!

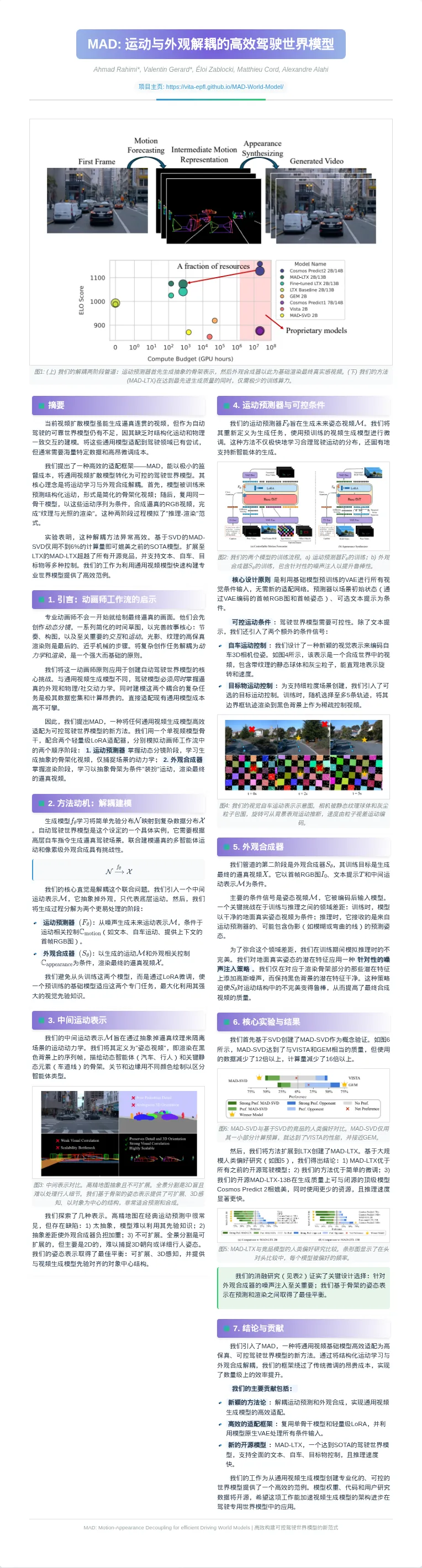

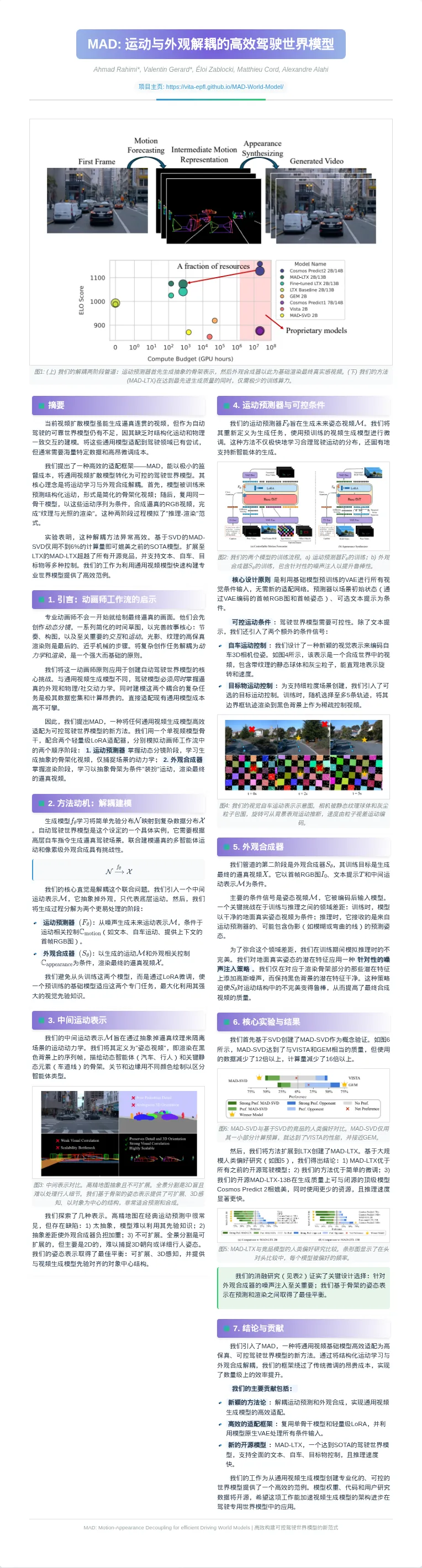

《MAD: Motion Appearance Decoupling for efficient Driving World Models》是瑞士洛桑联邦理工学院(EPFL)与Valeo.ai、索邦大学合作的最新研究。

在自动驾驶领域,构建能够生成逼真且物理规则一致的虚拟世界模型至关重要,但现有视频生成模型往往需要海量数据和巨大算力进行微调,成本高昂。

EPFL团队提出的MAD框架,巧妙地借鉴了专业动画师的创作流程,将世界模型的构建分解为“动态推理”与“外观渲染”两个阶段。其核心创新在于,首先让模型在一个简化的“骨架”世界中学习物理和社会交互的动态规则,确保运动的合理性与一致性;然后,再利用同一骨干网络,根据这些抽象的动态序列“穿上”逼真的纹理和光影,合成最终的RGB视频。这种“先动后画”的解耦范式,实现了学习效率的飞跃。

实验表明,基于SVD模型进行适配时,MAD仅需不到6%的计算量就能达到先前SOTA模型的性能。而扩展后的MAD-LTX模型,在全面支持文本、自车、物体等多模态控制的同时,性能超越了所有开源竞品。这为低成本、高效率地构建高保真自动驾驶仿真环境开辟了新路径。

【一图概览】自动驾驶缺了"思考"能力?VLM-AD如何让AI学会人类推理逻辑

【一图概览】HiP-AD:如何让自动驾驶更安全?闭路性能提升300%的方法来了!

【一图概览】如何用一个模型搞定自动驾驶?Waymo的EMMA给出了答案

本文来自网友投稿或网络内容,如有侵犯您的权益请联系我们删除,联系邮箱:wyl860211@qq.com 。