一篇讲清楚“感知模块”的核心作用(建议收藏)

在自动驾驶系统中,“感知”是最容易被提及、但也最容易被误解的模块之一。

很多人知道它和“摄像头、雷达、AI算法”有关,但如果进一步追问:感知到底在做什么?往往很难说清楚。这篇文章只做一件事——把自动驾驶感知模块的核心工作拆解清楚。

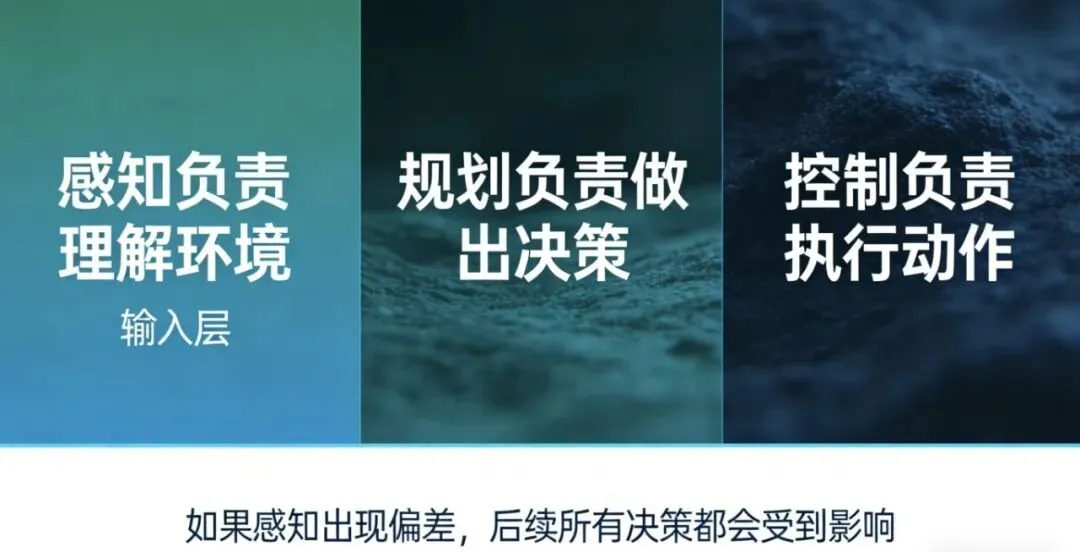

一、感知在系统中的位置

自动驾驶系统可以拆解为:

感知 → 规划 → 控制 → 测试

其中:

可以把感知理解为:整个系统的“输入层”。

如果感知出现偏差,后续所有决策都会受到影响。

二、感知的核心目标是什么?

可以用一句话概括:

让系统知道“周围发生了什么”。

这句话看似简单,但实际包含三个层面的能力:

三、感知具体在做哪些事情?

从技术角度来看,感知模块主要包括以下几个核心任务:

目标检测 → 目标识别 → 状态估计 → 场景理解

1. 目标检测

目标检测的作用是:

在环境中“找出有哪些东西”。

例如:

输出结果通常是:

目标的位置(如二维框或三维框)。

可以理解为:

从“没有信息”到“发现目标”。

2. 目标识别

在检测到目标之后,需要进一步判断:

这个目标“是什么”。

例如:

是行人还是骑车人

是小轿车还是卡车

是静止物体还是可移动目标

可以理解为:

给目标“贴标签”。

3. 状态估计

仅仅知道“是什么”还不够,还需要知道:

目标当前的状态。

包括:

例如:

前方车辆是在正常行驶,还是正在减速,甚至即将急刹。

可以理解为:

判断目标“接下来可能怎么动”。

4. 场景理解

这是更高层的一步。

不仅关注单个目标,还要理解整体环境。

例如:

当前是否在路口

是否有交通信号灯

车道线结构如何

是否存在可通行区域

可以理解为:

从“看物体”到“理解环境”。

四、感知依赖哪些输入?

感知模块依赖多种传感器数据,常见包括:

摄像头(视觉信息)

毫米波雷达(距离与速度)

激光雷达(高精度空间结构)

不同传感器各有特点:

摄像头信息丰富,但受光线影响较大

雷达稳定性高,但分辨率有限

激光雷达精度高,但成本较高

因此实际系统中通常采用:

多传感器融合(Sensor Fusion)

以提升整体可靠性。

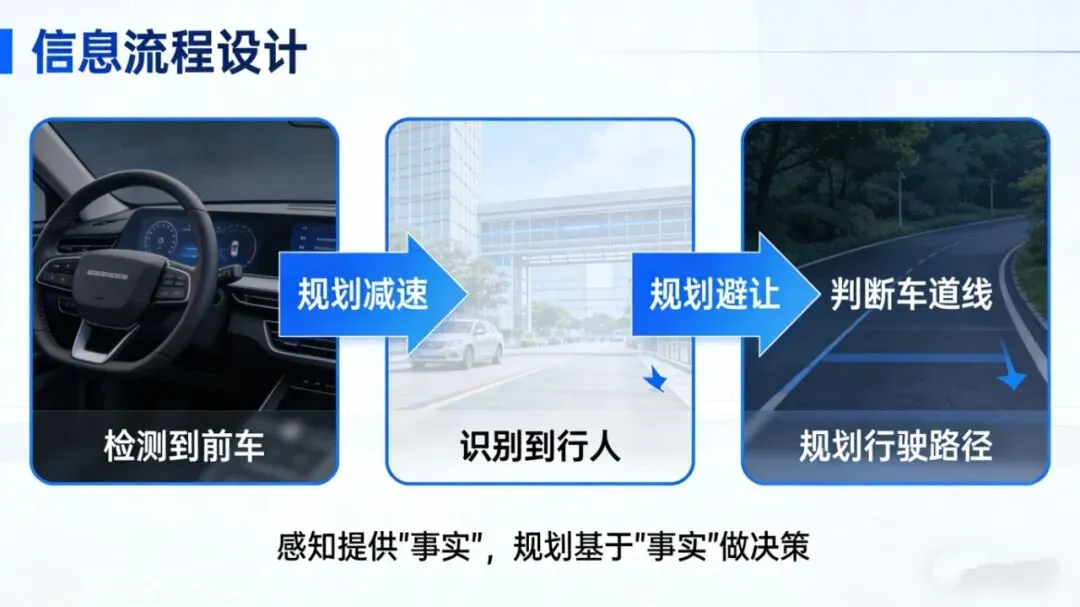

五、感知结果如何被使用?

感知输出的信息,会直接提供给规划模块,用于决策。

例如:

检测到前车 → 规划减速

识别到行人 → 规划避让

判断车道线 → 规划行驶路径

可以理解为:

感知提供“事实”,规划基于“事实”做决策。

六、感知的难点在哪里?

相比其他模块,感知面临的挑战主要来自真实世界的不确定性,例如:

光照变化(白天 / 夜晚 / 逆光)

天气影响(雨雪、雾霾)

遮挡问题(目标被部分遮挡)

非标准行为(行人、车辆异常动作)

这些因素都会直接影响识别结果。

因此,感知系统不仅要“准确”,还需要“稳定”。

七、总结

可以用一个简单结构来理解感知模块:

目标检测:发现有什么目标识别:判断是什么状态估计:理解怎么动场景理解:把握整体环境

从系统角度来看:

感知决定了自动驾驶系统“看到的世界”。

而这个“世界”是否准确,将直接影响后续所有决策与控制。

如果你刚开始接触自动驾驶领域,建议优先理解感知模块的基本逻辑,再逐步深入算法或工程细节。