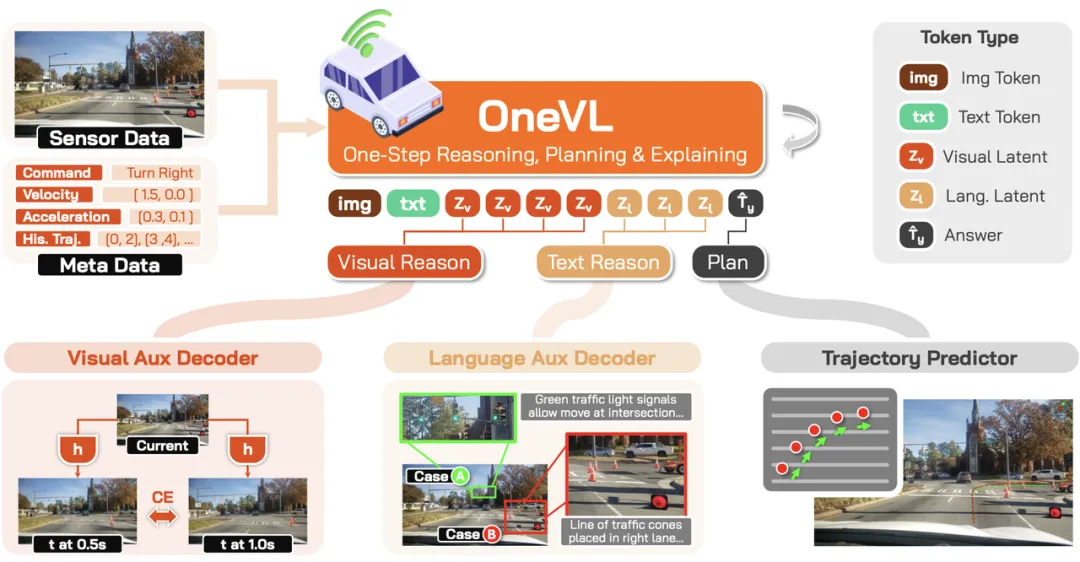

家人们谁懂啊😭小米今天直接把王炸甩桌上了——Xiaomi OneVL自动驾驶模型正式宣布开源!这不是普通的技术更新,这是业内第一个把VLA、世界模型、潜空间推理全给统一了的大一统方案🔥

## 一、小米的野心:把所有路线拧成一股绳

说实话,这个操作真的有点东西💀以前自动驾驶圈子里,VLA和世界模型是两条独立的路线:一个负责看懂场景然后踩油门打方向盘,一个负责预测接下来会发生什么。就像左手和右手各干各的,谁也不搭理谁。

但小米这一波直接整了个大活——Xiaomi OneVL通过潜空间推理,首次把这两条路线统一到同一套框架里!也就是说,这台车不仅知道"现在该往哪开",还知道"接下来会发生什么",而且这两件事是在同一个"脑子"里完成的🤯

## 二、性能有多猛?数据说话

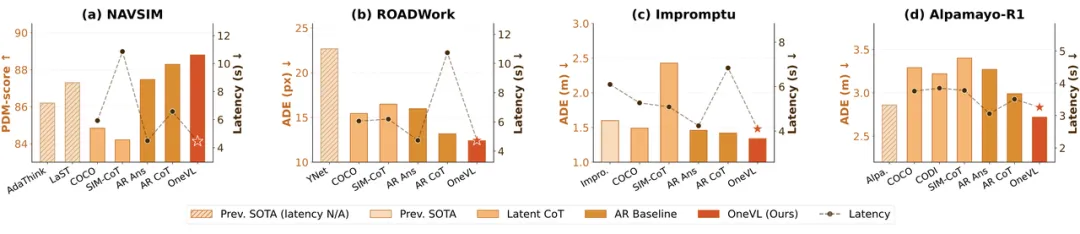

来,懂的都懂,直接上硬货👇

在ROADWork、Impromptu、Alpamayo-R1三项基准上都达到了SOTA(也就是当前最强),在NAVSIM上PDM-score更是飙到了88.84。这个数字什么概念?它是首次在潜空间推理中超越了显式CoT(88.29)的成绩!

更牛的是延迟表现——挂载MLP回归头变体后,延迟降到0.24秒(4.16 Hz),只有VLA自回归推理的5.4%!这意味着什么?意味着这套方案真的能塞进量产车,不是在实验室里自嗨😂

## 三、不仅能开,还能"说人话"

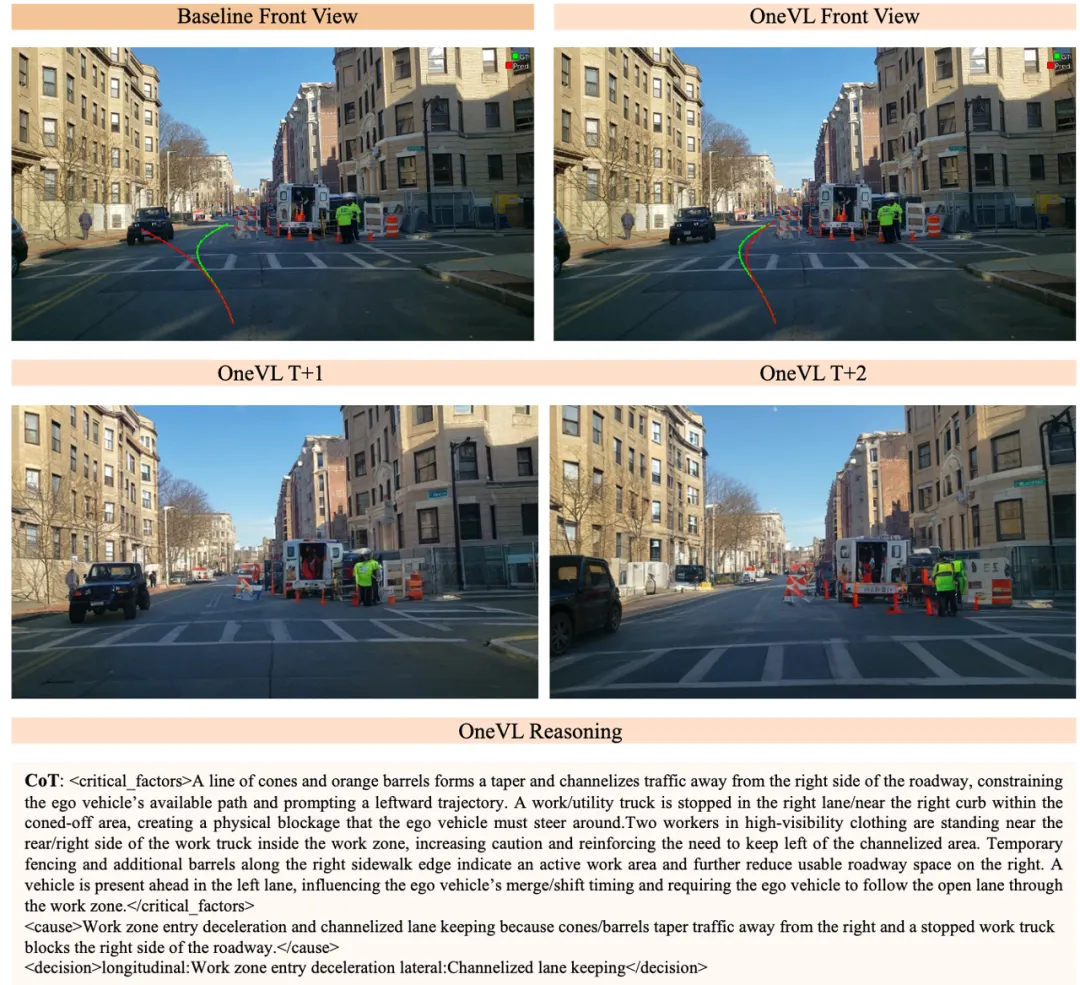

小米这次还有个很骚的操作——Xiaomi OneVL能为模型决策提供语言和视觉双维度的可解释性。

翻译成人话就是:它既能用文字告诉你"为啥我要这么开",还能用画面给你展示"接下来会发生啥"。再也不是那个黑盒子里瞎操作的神秘AI了👀

## 小吉有话说

说实话,小米这一波操作属实让人刮目相看。从手机到汽车再到自动驾驶,这家公司的技术肌肉越来越硬了💪而且选择开源而不是闭门造车,格局打开!

话说,你觉得小米汽车什么时候能真正实现"上车睡觉"的L4自动驾驶?评论区聊起来👇

—— END ——