🚗 自动驾驶“大脑”也要分工合作?还在纠结用大模型还是小模型开车?德州农工大学团队告诉你:小孩子才做选择,成年人全都要!让大模型负责“动嘴”推理,小模型负责“动手”规划,鱼与熊掌这次真的可以兼得!👇想第一时间拆解这种“解耦”思维的顶会论文?扫码加入「龙哥读论文」知识星球,前沿干货、实用资源一站式拿捏~

龙哥推荐理由:

这篇论文解决了一个非常实际的痛点:大视觉语言模型(VLM)语义理解强但控制精度差,小VLM好调教但“脑子”不够用。它提出的“导航员-驾驶员”解耦框架,思路清晰、实现巧妙,不仅提升了端到端规划性能,还天然提供了可解释的中间推理过程,对推动安全、可信的自动驾驶系统很有启发。关键是,开源代码已放出,复现和借鉴的门槛大大降低!

原论文信息如下:

论文标题:

NaviDriveVLM: Decoupling High-Level Reasoning and Motion Planning for Autonomous Driving

发表日期:

2026年03月

发表单位:

德州农工大学 (Texas A&M University) 等

原文链接:

https://arxiv.org/pdf/2603.07901v1.pdf

开源代码链接:

https://github.com/TAMU-CVRL/NaviDrive

大模型懂推理却不会开车?小模型会开车却不懂事?

想象一下,你车上有两位“司机”。一位是“懂王”:上知天文下知地理,能一眼看穿前方有行人、红绿灯变化,还能说出“此时应该减速礼让,因为安全第一”这样的大道理。但让他动手开车?方向盘往哪打,油门踩多深?他可能只会给你画一幅抽象画。🤷♂️

另一位是“老司机”:操控精准,说走就走,说停就停,未来几秒的行驶轨迹算得明明白白。但你问他“刚才为啥要刹车?”,他可能只会回答:“数据告诉我要这么开。” 🚗💨

这就是当前基于视觉语言模型(Vision-Language Model, 简称 VLM)的端到端自动驾驶面临的核心困境。VLM就是那种既能“看”图,又能“理解”和“生成”语言的AI模型。

大VLM(比如上百亿参数):像“懂王”,语义理解、逻辑推理能力超强,能详细描述场景并给出决策理由,可解释性高。但让它直接输出精确的控制指令或未来路径点(Waypoints),就像让哲学家去开挖掘机——不经过专门的、昂贵的“培训”(微调),根本做不到。

小VLM(比如几亿参数):像“老司机”,计算量小,容易微调,可以很快学会预测准确的未来路径,适合实时控制。但一微调,它原本那点可怜的“常识”和“推理能力”就可能退化,变成一个只会机械反应的“哑巴司机”,无法理解复杂场景。

用一个模型同时搞定高级推理和精细控制,似乎是个“鱼与熊掌不可兼得”的难题。德州农工大学的研究者们挠了挠头:为啥非要二选一呢?让“懂王”和“老司机”组队干活不香吗?

图1:大VLM与小VLM在推理和规划上的困境对比。(a) 大VLM推理能力强但无法生成准确的驾驶动作;(b) 小VLM经过微调能预测未来路径点,但推理能力下降;(c) NaviDriveVLM将两者解耦,保留了强推理能力的同时优化了驾驶性能。拆解思维与行动:NaviDriveVLM的“导航员”与“驾驶员”

于是,NaviDriveVLM 应运而生。这个名字就透露了它的核心思想:Navigator(导航员)+ Driver(驾驶员)。

这个框架像是一个精密的驾驶协作系统,明确分工,各司其职:

1. 导航员 (Navigator):动嘴的“大脑”

由一个大参数量的、冻结的(不更新参数)VLM担任。它的任务不是开车,而是“看”和“想”。

输入包括:车辆周围的环视摄像头图像、自车状态(速度、加速度等)、一个高级导航指令(如“左转”、“直行”)。然后,它需要输出一份结构化的“思维报告”,包含三部分:

• 场景描述: “前方有停止标志,左侧有车辆接近。”

由一个轻量级的、可训练的VLM担任。它的任务是把“导航员”的“思维报告”转化成具体的、可执行的行动。

它接收导航员的“思维报告”(作为关键的文本输入),再加上(通常是前视)图像和自车状态。然后,它的目标是预测未来一段时间(例如6秒)内,车辆应该遵循的一系列路径点坐标((x, y))。

• 保留了大模型的“智商”:导航员参数冻结,其强大的推理能力不会被下游的驾驶任务“污染”或遗忘。

• 降低了训练成本:只需要微调小体量的驾驶员模型,计算开销和所需数据量都大幅减少。

• 实现了可解释性:“导航员”生成的“思维报告”是一个明确、可读的中间表示。我们不仅知道车要往哪开,还知道它为什么这么开!这对于安全至关重要的自动驾驶来说,价值巨大。

图2:NaviDriveVLM整体架构图。框架解耦为作为导航员的大VLM和作为驾驶员的轻量级VLM。(a) 多视角环视图像被编码为视觉token(蓝色)。导航员提示和自车状态被标记为文本token(粉色和橙色)。(b) 导航员VLM生成推理token(绿色),这些token与前视图像token、驾驶员提示和自车状态token拼接后输入驾驶员VLM。(c) 驾驶员VLM被微调以预测未来路径点或驾驶动作。推理token可被解码为文本以提供可解释性。

如何让“导航员”说人话?“驾驶员”听指挥?

知道了分工,具体怎么实现呢?关键在两点:提示工程和训练策略。

要让大VLM输出结构化的推理,不能只问“现在怎么办?”。必须给出清晰的指令。NaviDriveVLM为导航员设计了详细的系统提示,相当于一份工作手册:

你是一个自动驾驶导航专家。请逐步推理并严格遵守以下规则:

1. 坐标系:当前自车位置为 (0,0)。X轴正方向为前方,Y轴正方向为左方。

2. 注意力优先级:重点关注“动态危险物”和“交通管制标志”。

3. 输出格式:以简洁的“感知”摘要开始,然后是“行动”,最后是简要的“推理”。

用户提示则提供具体的图像、状态和高级指令(如“前方路口右转”)。通过这样严格的提示,导航员就能生成格式规整、内容相关的“思维报告”。

驾驶员模型的提示则不同,它需要引导模型利用“思维报告”来预测路径。系统提示会告诉它:“你是一个驾驶专家,使用提供的推理、图像和状态来预测未来路径点。”

在训练时,驾驶员模型以自回归的方式进行监督微调。它的输入是导航员生成的“思维报告”(文本token)、图像token和状态token。输出目标是一系列真实的未来路径点坐标。

这个过程可以用公式来表达。导航员的推理生成过程为:

公式:导航员VLM的推理生成过程,其中OR是推理输出,GN是导航员模型,I是图像,Oego是自车状态,QN和SN是用户和系统提示。

公式:导航员VLM的推理生成过程,其中OR是推理输出,GN是导航员模型,I是图像,Oego是自车状态,QN和SN是用户和系统提示。

公式:驾驶员VLM预测未来路径点W,其中GD是驾驶员模型,OR是推理输出,其他输入与之前类似。

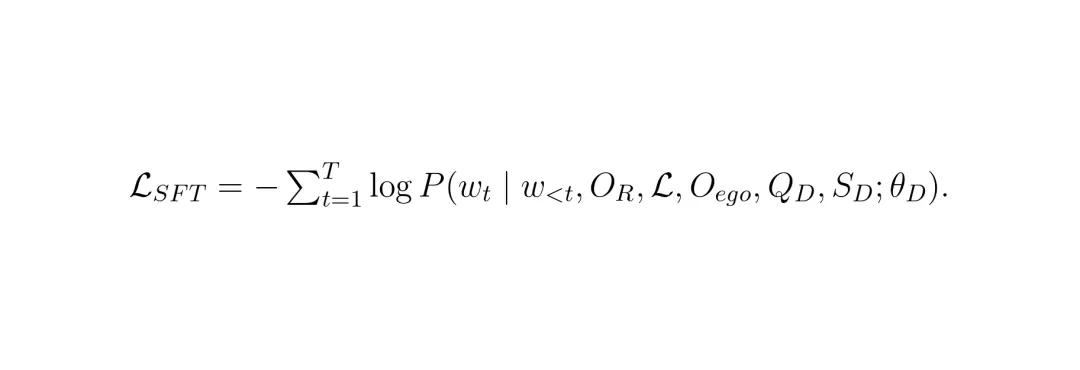

训练的目标是让驾驶员模型预测的路径点概率最大化,损失函数采用标准的负对数似然:

公式:驾驶员VLM预测未来路径点W,其中GD是驾驶员模型,OR是推理输出,其他输入与之前类似。

训练的目标是让驾驶员模型预测的路径点概率最大化,损失函数采用标准的负对数似然:

公式:监督微调(SFT)的损失函数,通过最小化未来路径点序列的负对数似然来优化驾驶员参数θD。

公式:监督微调(SFT)的损失函数,通过最小化未来路径点序列的负对数似然来优化驾驶员参数θD。实验结果:解耦框架真的能“鱼与熊掌兼得”吗?

理论很美好,实战行不行?论文在著名的自动驾驶数据集nuScenes上进行了全面的实验验证。

先来看直观的定性对比。下图展示了在三个典型场景(A. 停车标志前停车,B. 礼让行人,C. 通过绿灯路口)下,不同方法的表现:

图4:三种不同驾驶场景下的定性结果对比。预测的路径点用蓝色遮罩和蓝点可视化,真实路径点用绿色显示。括号内显示了6秒内的最小平均L2误差(米)。第一行代表未微调的大VLM,能生成合理的高级推理,但预测的未来路径点与真实值偏差很大。第二行对应经过微调的小VLM,能生成适用于控制的准确未来路径点,但缺乏强大的场景理解和推理能力。第三行展示了本文提出的NaviDriveVLM框架,它结合了可靠的高级推理和准确的未来路径点预测。

• 只大不小(第一行):推理说得头头是道,但预测的路径(蓝色)和真实路径(绿色)差之千里,误差巨大(L2误差高达9.4米、1.37米、10.79米)。

• 只小不大(第二行):路径预测准了,误差很小(0.93米、0.58米、0.06米),但生成的推理要么错误(把“停车”说成“直行”),要么过于简略缺乏信息量。

• NaviDriveVLM(第三行):既准又好!不仅推理完整正确,路径预测的精度也极高(0.93米、0.58米、0.06米),真正实现了“鱼与熊掌兼得”。

再看看硬核的定量指标。下表是在nuScenes上的开环运动规划结果,衡量的是预测路径点与真实值之间的L2距离(越小越好):

表I:在nuScenes数据集上的端到端运动规划实验结果。

• NaviDriveVLM(使用2B参数的驾驶员)在3秒预测时域上,超越了诸多强大的基线模型,包括ST-P3、Ego-MLP、UniAD等。

• 更重要的是,与单一的Driver-VLM基线(仅使用8B模型微调,没有独立的导航员)相比,NaviDriveVLM(2B+导航员)取得了全面领先的成绩(平均L2误差0.46 vs 0.60)。这说明,解耦设计引入的明确推理信息,实实在在地提升了规划性能,而不仅仅是参数量的差异。

论文还探索了直接预测控制动作(加速度、曲率)与预测路径点的区别:

结果表明,路径点预测在短期(1s, 2s, 3s)更准,而直接的动作预测在长期(6s)平均表现稍好。两者都是可行的输出形式。

表III:NaviDriveVLM输入组件的消融研究。

• 导航员的推理(Reason)和高级命令(Command)对提升性能至关重要。缺少它们,误差会显著增加。

• 有趣的是,图像(Images)输入带来的增益相对较小。这可能是因为导航员提供的文本推理已经包含了最关键的场景语义信息,图像中的大量细节对驾驶员模型来说有时反而是冗余的。未来之路:更智能、更安全的自动驾驶系统

NaviDriveVLM的“解耦”思想,为VLM在自动驾驶中的应用推开了一扇新的大门。它不仅仅是一个性能更强的模型,更代表了一种兼顾性能、效率与可解释性的系统设计范式。

对于未来的研究,这条路线上还有许多可以探索的方向:如何进一步提升“导航员”推理的质量和可靠性?如何将这种开环预测框架扩展到闭环的、与仿真或真实环境交互的强化学习系统中?“驾驶员”能否从单一的路径预测,进化到能处理多模态、不确定性的决策?随着世界模型等新技术的融入,这个“导航员-驾驶员”二人组的能力边界又在哪里?

归根结底,让AI像人类一样“思行合一”,是通向高级自动驾驶的必由之路。NaviDriveVLM告诉我们,也许不必强求一个“全能超人”,培养一个配合默契的“精英团队”,会是更务实、更高效的选择。毕竟,好的驾驶,既需要看清路的眼睛和思考的头脑,也需要稳住方向盘的手。

龙迷三问

这篇论文最核心解决了什么问题?它解决了在端到端自动驾驶中使用单一视觉语言模型(VLM)时,无法同时兼顾“强大语义推理能力”和“精准运动规划能力”的矛盾。大模型推理强但控制差,小模型好控制但推理弱。本文通过“导航员-驾驶员”解耦框架,让大模型专职推理,小模型专职规划,从而实现了两者优势的结合。

“导航员”和“驾驶员”具体有什么区别?导航员(Navigator)是一个冻结的、大型的VLM,负责高级场景理解和思维链推理,输出可读的“场景-行动-理由”报告。驾驶员(Driver)是一个可微调的、轻量级的VLM,负责接收导航员的报告和其他感知信息,输出具体的未来路径点或控制指令。一个动“脑”(嘴),一个动“手”。

什么是VLM和端到端自动驾驶?VLM(Vision-Language Model)是视觉语言模型,能同时处理图像和文本,理解两者间的关联。端到端自动驾驶是指用一个统一的模型,直接从传感器输入(如图像)映射到控制输出(如方向盘转角、油门),省去了传统流水线中感知、预测、规划等独立模块。本文的VLM用于实现这种端到端映射,但创新性地将其拆成了“理解”和“执行”两个子模块。

如果你还有哪些想要了解的,欢迎在评论区留言或者讨论~龙哥点评

论文创新性分数:★★★★☆

将大模型的推理能力作为明确的中间表示来辅助小模型进行规划,这个“解耦”思路清晰且巧妙,在VLM用于自动驾驶的范式上做出了有价值的创新。实验合理度:★★★★☆

在nuScenes标准数据集上与多种基线进行了充分对比,并设置了合理的消融实验(Driver-VLM基线)来证明推理信息的单独贡献,结论支撑有力。学术研究价值:★★★★☆

为如何平衡AI模型的“智能”与“可控”提供了一个经典案例,对可解释AI、模型高效适配、多智能体协作等方向都有启发。开源代码进一步提升了其研究价值。稳定性:★★★☆☆

框架本身是稳定的,但其性能上限依赖于“导航员”大模型生成推理的质量。若大模型产生幻觉或错误推理,会直接传导给“驾驶员”。目前还只是开环预测评估。适应性以及泛化能力:★★★☆☆

依赖于预训练VLM的泛化能力。在训练分布外的极端场景(如罕见天气、事故现场),导航员的推理和驾驶员的规划都可能失效。需要大量多样性数据来提升。硬件需求及成本:★★★☆☆

推理阶段需要运行一个大模型(导航员)和一个小模型(驾驶员),计算和内存开销高于单个小模型,但远低于微调或运行单个大模型。训练成本因只需微调驾驶员而显著降低。复现难度:★★★★☆

论文方法描述清晰,代码已开源,使用的Qwen等模型也容易获取。主要难点在于需要生成并管理“推理”数据集,以及可能的大模型API调用或本地部署成本。产品化成熟度:★★☆☆☆

目前仍处于研究原型阶段。要产品化,必须通过闭环仿真和实车测试验证其安全性、实时性(需优化推理速度)和面对长尾场景的鲁棒性。从原型到车规级产品有很长距离。可能的问题:本文的评估集中于开环路径预测精度,但真实的驾驶安全需要闭环测试。“导航员”的推理质量缺乏客观评估标准,可能存在“说得对但做得差”或“说得好但做不对”的风险。此外,双模型串行推理的延迟需重点优化。

Ximeng Tao, Pardis Taghavi, Dimitar Filev, Reza Langari, Gaurav Pandey. "NaviDriveVLM: Decoupling High-Level Reasoning and Motion Planning for Autonomous Driving." arXiv preprint arXiv:2603.07901v1 (2026).官方开源代码仓库: https://github.com/TAMU-CVRL/NaviDrive*本文仅代表个人理解及观点,不构成任何论文审核或者项目落地推荐意见,具体以相关组织评审结果为准。欢迎就论文内容交流探讨,理性发言哦~ 想了解更多原文细节的小伙伴,可以点击左下角的"阅读原文",查看更多原论文细节哦!

🚗 想和更多自动驾驶、机器人领域的大佬一起“解耦”讨论,碰撞思维火花吗?

欢迎加入龙哥读论文粉丝群,

扫描下方二维码或者添加龙哥助手微信号加群:kangjinlonghelper。

一定要备注:研究方向+地点+学校/公司+昵称(如 自动驾驶+北京+清华+龙哥),根据格式备注,可更快被通过且邀请进群。