2026 年刚刚过去两个多月,AI 领域已经进入「提效与落地」的新阶段:大模型升级不停,芯片和算力竞赛加剧,行业应用也从试验走向真正创造价值。

一、大模型:从“更大”走向“更聪明”过去两年大家都在比模型有多大、参数有多少,而现在,主流厂商开始集体转向「更聪明、更高效」。

新一代通用大模型在推理能力、长文本处理、多模态理解等方面持续进化,不再只拼体型,而是拼「单位成本的智能含量」。

更长的上下文意味着,一个模型可以读完整个项目文档、合同甚至代码仓库,再给出综合分析和决策建议。多模态能力则让模型可以同时理解文字、图片、音频甚至视频,为内容创作、设计、教育等行业打开更多空间。

对普通企业来说,更大的变化在于:过去「看上去很强,但用不上」,正在变成「可以低成本接入业务流程」。

二、算力与芯片:AI 的“新基建”

没有算力,就没有大模型。

海外厂商在数据中心级 GPU 上持续迭代,瞄准的是「万亿参数时代」的训练和高效推理。

国内厂商则在自研 AI 芯片上加速追赶,重点放在:能耗更低、成本更可控、对本地数据更友好。

云厂商一边上新 AI 专用实例,一边把大模型能力抽象成标准化服务,让中小企业,也能用上曾经「只有巨头玩得起」的模型能力。

从企业视角看,这是算力从「稀缺资源」走向「可配置资源」的过程——未来像买云主机一样买 AI 推理能力,会越来越常见。

三、多模态与行业模型:从 Demo 走向生产

这一波 AI 升级,有两个非常明显的方向:

多模态一体化

一个模型同时搞定文字、图片、音视频,意味着:做内容的,可以从「文字+图片」一键生成短视频;做工业/设计的,可以从草图到 3D 方案一条龙;做客服和运营的,可以用一个模型覆盖文档问答、图片识别、简单语音服务。

垂直行业深耕

通用模型解决「能不能」的问题,行业模型解决「好不好用」的问题。医疗领域:从阅片辅助、病历总结,到给医生提供决策参考,已经在逐步落地。自动驾驶:算法持续进化、算力成本下降,叠加政策逐步开放,实际路测和运营里 AI 扮演的角色越来越重。内容与创意行业:短视频脚本、剪辑建议、封面图设计,逐渐变成「AI 打底,人类润色」。

简单理解:AI 不再只是一个“会聊天的工具”,而是在快速长成一个「各行业都有分身」的基础设施。

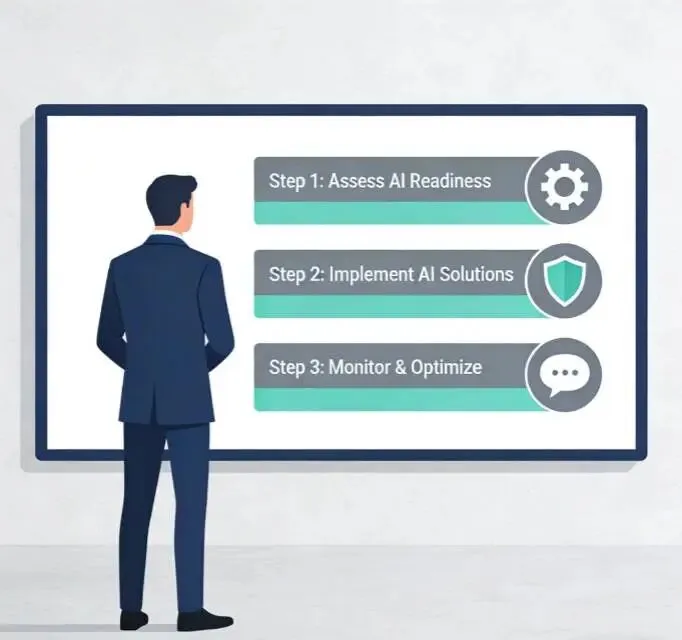

四、对企业的三个实用建议

如果你是企业负责人、产品经理或营负责人,下面三点可以直接当成行动清单:

梳理可 AI 化场景,先从低风险、高收益入手

。优先考虑:客服问答、内部知识检索、报表和文档生成、市场分析等环节。

原则是:对外风险小、流程结构化、数据相对干净。

算力与数据合规要及早规划

自建还是上云,是否引入本地化私有部署,需要根据业务敏感度、数据合规要求、预算综合权衡。对于有隐私和敏感数据的行业(医疗、金融、政企等),建议提前给出「哪些数据可以上云,哪些必须本地」的边界。

不要只停留在“有个聊天机器人”层面把大模型当作「智能协作者」:接任务、接流程,而不是孤立的问答窗口。评估一个 AI 项目的价值,不要只看技术炫不炫,而要看是否真正缩短了决策链条、降低了人力成本、提升了用户体验。

五、给读者的收尾:为什么是现在

如果说 2023–2024 年是「大模型觉醒期」,那 2025–2026 年,更像是 AI 真正「下沉到行业」的关键两年。模型能力已经足够强,成本正在可控区间内滑落。工具链、平台和生态逐步完善,开发和接入的门槛快速降低。监管和标准开始跟上,让更多企业敢于把关键业务交给 AI 协作。

对每一个个人和企业来说,现在都是重新审视自己和 AI 关系的好时机:

不是「要不要用」,而是「在哪些地方率先用起来,能先拿到红利」。