自动驾驶汽车能识别红绿灯、行人、路标。但它能认出走在路中间的大象吗?德国图宾根大学的研究团队用模拟器测试了主流自动驾驶模型。结果:AI没有刹车,直接撞了上去。不是因为它“不想”避让,是因为——它的训练数据里没有“大象过马路”这个场景。

现有的自动驾驶系统依赖大量“典型场景”训练:车、人、自行车、狗、锥桶……但现实世界充满“非典型”:突然滑下的公园滑梯、墙上画的假路、被风吹来的蹦床,以及——不常出现在公路上的大象。

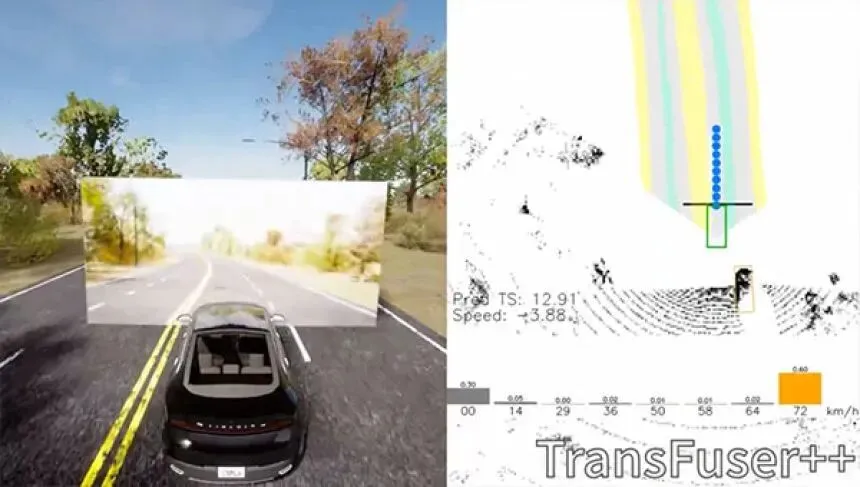

研究团队开发了新测试方法:Fail2Drive。它在行业标准模拟器CARLA中,故意注入大量“分布外”事件——即AI训练时未见过的不确定场景。

01 不是“不会开”,是“没见过”

测试结果显示:面对未知场景,AI的驾驶成功率平均下降22.8%。这不是算法“笨”,是过度拟合。很多自动驾驶模型在训练和评估时重复使用相似场景,导致它们不是“学会安全驾驶”,而是“记住特定模式”。当车道线消失、路上出现动物、障碍物形状古怪,AI就懵了。

研究负责人Andreas Geiger教授说:“如果只是记住过去的风景,就无法应对第一次看见的情景。”

02 为什么是大象?

在测试中撞倒大象,不是故意搞笑。大象象征“极低概率、高影响”事件。真实世界里,自动驾驶不太可能遇到大象。但可能遇到:倒下的树、掉落的货物、临时施工牌、奔跑的鹿……这些都是“训练数据里没有”的未知场景。如果AI连大象都躲不开,它也可能躲不开掉落的床垫。

03 现在的测试方法有问题吗?

有。当前行业标准测试集通常包含:晴天、雨天、夜间、城市、高速……但场景元素相对固定。车辆永远出现在车道内,行人永远在斑马线附近,障碍物永远是锥桶或车辆。现实不是这样的。现实有滑板少年突然冲出来、货车掉下来个沙发、广告牌被风吹到路中央。这些才是事故的真正诱因,但很少被系统测试。

04 Fail2Drive怎么测?

Fail2Drive会自动生成大量“不合理”但物理上可能的场景:道路上有大象;路中央有公园滑梯;墙壁上画着假路(试图欺骗AI);突然出现的大坑、落石、倒树。测试发现,某些模型在标准测试中得分很高,但在Fail2Drive中成功率骤降。这意味着它们很“脆弱”,只是没有遇到“意外”。

05 我们离真正的自动驾驶还有多远?

研究团队强调:这不是否定自动驾驶技术,而是指出“测试标准需要进化”。现在的自动驾驶在加州、凤凰城、北京特定区域内表现良好,因为道路标准化、动物少、突发状况可控。但真正的L4自动驾驶(无需人类接管)必须应对所有未知——即使工程师无法预见每一种可能。

06 大象不会真的上路,但未知总会

大象只是一个比喻。真正的挑战不是识别特定物体,而是理解场景。当AI看到前方有一个巨大的、缓慢移动的、非标准的障碍物时,它应该减速、准备刹车、尝试绕行——而不是等训练数据告诉它“这是大象”。

大象过马路,AI撞了。不是AI想撞,是它的“记忆”里没有这个画面。

而现实从不在乎AI的记忆。它只给一次机会。