纯视觉的自动驾驶路线依然是争论的焦点——关于Tesla中国一篇公众号所引发的争议

- 2026-04-16 05:50:24

===卷首语===================

在知乎上看到的相关话题,然后返回去看了Tesla特斯拉中国的公众号,中规中矩。很有意思的是,知乎上相关问题下边大部分的答案还是对特斯拉这种对纯视觉方案的推广方法持负面意见的。

相关联的知乎下其他几个类似的纯技术线路讨论问题(有的相关问题居然有五六百个答案规模),我看也是“反对”是更主流的声音。说明什么?说明现在公众关注自动驾驶技术生态的热度和密集度都在上升,而且大众逐步会因为国内新能源车强势、自动驾驶配套硬件产品化强势(比如我们确实造得出又好又便宜的Lidar上车),逐步产生了一种对于自动驾驶智能技术生态同样强势的自信。

总的来说,这没啥大问题。

==============车右智能===

但是对于自动驾驶技术的技术路线选择,我倒觉得没什么必要非得支持一个,就必须踩另一个……没必要(这包括Elon Musk在2019年公开说过的那些狠话,Anyone relying on Lidar is doomed-任何依赖激光雷达的人都会注定失败)。百花齐放才是春嘛!个人角度出发,传感器方案的选择不应该是自动驾驶技术领域内最核心的那个部分,显然,自动驾驶结构的整体方案(包括技术范式、数据获取手段和训练方法的一系列规范)现在必须应该是更高更核心的一个地位。

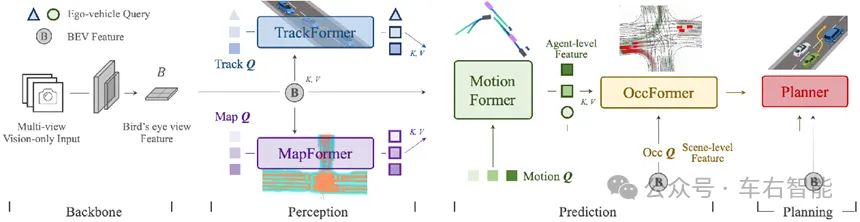

Part-I:端到端并不限定感知数据的性质

从去年CVPR 2023的那篇自动驾驶领域的最佳论文UniAD开始,端到端的自动驾驶范式已经开始显露出更明确的关注:对于如何组织感知数据从感知系统一直无损失、且不过多受人为定义规则地流向方向盘和油门输出——争取一张网络和一个训练过程打到底。能看出自动驾驶的智能范式正在越来越严重地受到GPT/chatGPT的影响,受到人类在NLP自然语言处理领域用统一的智能架构完成所有自然语言任务,并能挖掘出人类智能的影响。

图表 1图片来自论文《Planning-oriented Autonomous Driving》插图

上图就是UniAD,网络流程上能看到的所谓模块还是按照传统定义来区分,但是已经不再是每个模块独立各自为战、各自优化并有明显的上下游的先后关系了。核心任务是planning,从CNN到BEV的feature之后,数据的流向在很大程度上是由网络自己决定,只要能生成符合要求的安全的和流畅的路径,其他都是隐式的。基于Transformer的QKV方法,把所有信息都集成在一起,包括以前的各种感知和预测、障碍物占用等独立任务的定义和优化,都不再必要了(当然如果你需要维护一个舱内显示UI给乘客那另说)。

随后我们看到了Musk和Ashock在去年夏天突然给出的FSD end to end版本的驾驶直播,虽然那次直播出现了明显的、也非常有趣的“逻辑错误”,但也体现出非常有意思的“错误的逻辑”(具体可以查看相关视频资料,网上很多)。到今年规模性的FSDv12去除beta版本状态之后的推广,各方面的反应都还是比较积极的。因为Tesla并未给出端到端的架构原型(也许会在AIDay 2024吧),我们并不能猜测具体结构是如何实现和组织数据流向端到端的,但其实也大概差不多。类似UniAD架构中的好多独立任务,其实也是Tesla首创的,或者是我个人第一次从Tesla的公开资料中看到的,包括CNN的多头任务、BEV、OCC……(Tesla除了规控以外,几乎距离端到端就差一口气了)所以Tesla能快速以某种方法快速转到端到端不是没可能的。

但更需要关注的是,实际上“端到端”这种可能是最适合解决或者至少缓解corner case的方法,实际上并不限定传感器的性质。这和第一性原理无关(我们不应该在支持或者反对自动驾驶领域的第一性原理必须选边站)。在这方面我既不支持对齐人类的视觉能力就是无人撼动的第一性原理,就是王道;也不支持必须要增加超越人类的视觉能力才能更好地完成自动驾驶任务(不考虑产品力问题,这肯定是中国无敌制造业的强项)。二者都极端了。

Part-II:关键任务还应该是Planning

焦点应该还是应该放在Planning上,这才是终极命题。也就是放在怎么才能通过L2的落地数据,能快速迭代到L4,让更多人能尽可能安全和舒适滴享用通勤时光。毕竟L2+用多了早晚会出事儿,而L3本身就是个人性的悖论。坦白说,就目前看Tesla的存量和2019年即已经开始部署的shadow mode(阴影模式)可能是端到端架构下最值钱的数据来源了,由于较为合理地统一了camera+驾驶员干预的数据结构,可以很完美地对应端到端模型的数据需求,记录并搜集人类标注过的planning data。如果Tesla的robotaxi计划被证明在北美确实可行,那么常年的shadow mode功不可没。

其他关于自动驾驶能力的目标是对齐人类还是超越人类,我觉得这种话题谈了还太远,没什么实际意义。和“雁是蒸着吃还是煮着吃”的问题一样,在我们能摸到L4能力的边缘之前,这个问题并非一个迫切的问题,虽然超越人类的驾驶能力就需要超越人类的感知能力这个命题听起来很正确。但也需要同时考虑到,如果理论上超越人类的感知传感器真的是自动驾驶能力超越人类的前提条件,那么有没人考虑过超越人类的自动驾驶,人类是否真的能承受得住?好,交通整体效率在自动驾驶的加持下提供了150%的最大承载力,但在这个尺度下,人类的下车呕吐率会不会同步增加200%?不是开玩笑,有机生命体在长期进化的尺度下,也坚强也脆弱。Apple的Vision pro十年磨一剑,还是在这种半入侵的配台设备上引发人类不适。所以我更倾向于较为保守、以提高交通安全效率,并广泛解放人类驾驶员注意力和体力消耗为第一目标,其他更高的目标,在可见的未来,都是次要的。

综上,语无伦次想到哪里说到哪里啰嗦了几句,我的态度是,我支持两条路线:纯视觉路线和武装到牙齿的感知路线,双箭齐发,早日命中靶心!!!

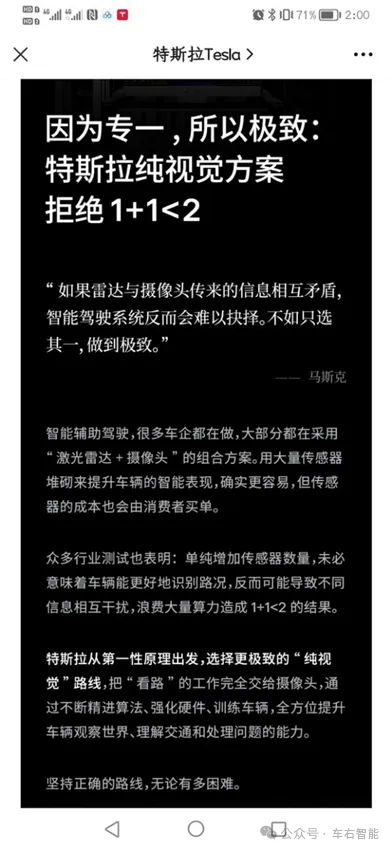

Part-III:另,关于Tesla广告的争议

多说一点点,至于引发主流非议的Tesla的这个广告文案:

我觉得更多还是各自的理解问题。关注自动驾驶和Tesla发展历史的同学应该还记得,早期(大概是2016年)Tesla因为佛州那个Model S钻到集装箱卡车底部(整个Model S顶部被切掉)的致死案,直接导致和Mobileye(当时是Tesla Autopilot摄像头硬件和L2系统整体供货商)的分手。

这对于Musk和Tesla都是个非常大的刺激,因为事后的事故调查过程中,Mobileye的技术观点是,事故原因是你Tesla的AEB子系统不行。而当时Autopilot的AEB功能是Tesla和大陆(还是博世)的毫米波雷达和Tesla自己的控制方案,和Mobileye无关。是因为你Tesla的AEB没让车辆在最后关头减速,或者说你Tesla对于毫米波雷达的点云信号处理不行,没在后期或者最后关头接管车辆;而Tesla认为,事故事后的数据分析表明,Mobileye的视觉系统把那辆集卡在长距离上识别成广告牌(或者是天边的云)才是真正的问题。

双方争夺的结果就是Tesla希望Mobileye开放视觉原始数据给Autopilot,让Tesla自己来整合毫米波和视觉数据来做最终判断,而Sashua(mobileye的创始人)坚决不肯,他希望在Autopilot占据主导地位,而且Mobileye是实际上的当时的L2系统的绝对王者。双方各不让步最终促成Tesla自己下场自动驾驶(实际上早晚的事儿)。——AEB和自动驾驶系统之间的关系到今天依然是一件非常复杂的事情,因为要同时考虑消灭假阴同时控制假阳两个方向上的问题,何小鹏同志和老余同志前几个月还在撕B……历史老大难了。

我感觉从那时候开始,Musk同志就是对异构数据极度不信任的,同时也对于光子photon所能承载信息的丰都极度自信。在自己亲力亲为之后,到底是逐步把mmRadar甚至超声波全部取消了,有成本问题,更是自己的技术洁癖问题。这些广告词在今天还这么写,当然是绝对自信的表现(毕竟FSD还是口碑整体上不错的),但也确实有点挤兑人(比如“传感器成本有消费者买单”这句就不太合适)。

此一时彼一时啊,我们作为消费者,最终还是看疗效的。请诸位自动驾驶和主机厂从业者奉为圭臬!

车右智能

一个一直用心仿真的自动驾驶技术信徒

info@co-driver.ai

备注:

1封面图来自https://mp.weixin.qq.com/s/IoPWy7VfaxIpK-fBvCHRXA的插图截取部分;