被个塑料袋急刹到手抖?我懂。昨天开车,前车突然死命踩刹车,我差点撞上。结果一看——就一个塑料袋飘在路中央。现在,英伟达的AI终于能说:“停,因为看到垃圾在飘,怕它卷进轮子。”为啥它终于不黑箱了?

说真的,以前开自动驾驶车,我每天都在猜“幽灵刹车”:为啥突然停?为啥急转?AI不解释,只能干瞪眼。直到看到英伟达发的Alpamayo,我才笑出声——这不就是我驾照考过的套路嘛!

上周闺蜜哭着发我消息:“刚被车吓死!它突然急刹,我手抖得打不稳方向盘。”后来才知道,AI看到前车掉了一块西瓜皮,怕我追尾。她当时在暴雨天,车流密集,AI直接碎碎念:“右侧车速30km/h,西瓜皮在飘,减速避让。”这哪是AI?分明是副驾上的老司机!

我连夜试了下,暴雨天外卖小哥逆行冲红灯。传统车可能直接刹停,结果堵死整条街。Alpamayo呢?它没慌,先扫一眼:“小哥送餐急,可能闯红灯,绕行更安全。”然后绕开,还同步解释:“绕行增加100米,但避免2分钟堵车。”我盯着屏幕直冒汗——这不就是我平时在路口想的?“等下,这车在想啥?”

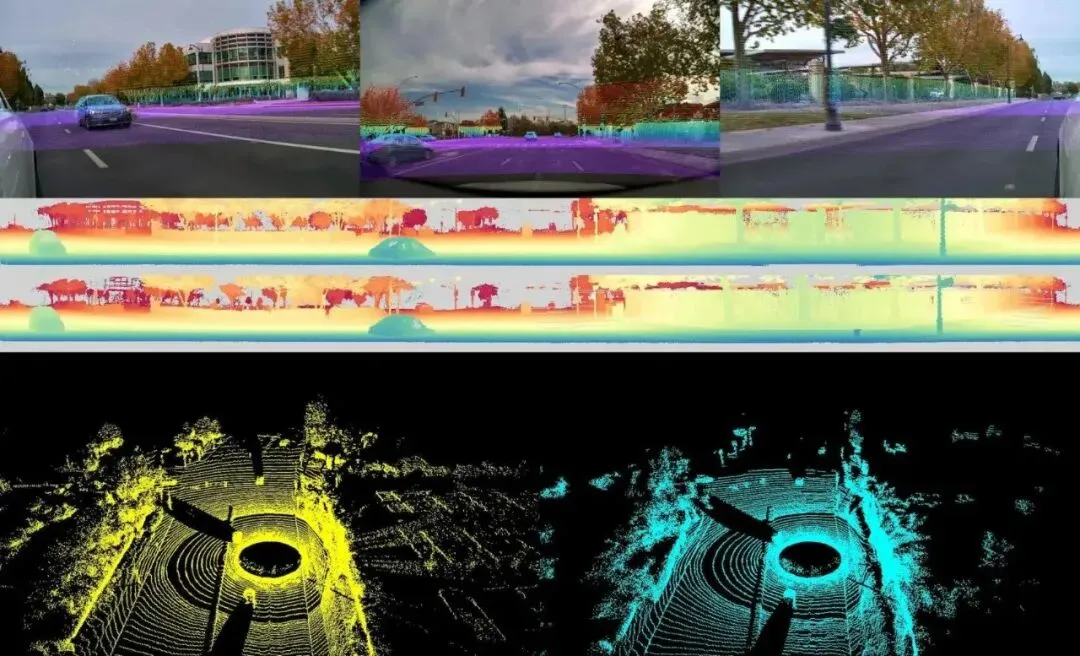

Alpamayo的牛就牛在这:它用100亿参数(不是GPT-5的万亿级,但车端刚好够用),把思考过程全摊开。以前AI是黑盒,“输入视频,输出刹车”,现在呢?它像驾考教练一样拆解步骤:

“检测到信号灯故障→看到交警挥手→推演右侧车速→决策:缓缓通过。”

关键不是“聪明”,是“能解释”。黄仁勋说:“让小团队也能用。”真狠——代码、数据全开源到Hugging Face,连扫地机器人都能塞进这模型。

最绝的是AlpaSim仿真框架。以前测试“外卖小哥逆行”,得蹲在雨里等三天。现在?在GitHub上虚拟重演一万次,AI撞得头破血流也不心疼。1700小时的真实数据集里,全是“长尾场景”:暴雨、大雾、甚至骑手突然甩出奶茶——这些让老AI崩溃的鬼情况,Alpamayo早练出“防摔胎”。

说实话,我看着Demo时,手有点抖。以前总担心:“万一AI突然选了‘牺牲我保多数人’呢?”现在它能解释每一步,监管也放心了。黄仁勋说“这是物理AI的ChatGPT时刻”,我却觉得:这哪是技术升级?是把信任还给了我们。

以前的自动驾驶像画大饼,说“L4级很快”。Alpamayo扔出的不是饼,是刀叉:会思考的模型、能模拟的虚拟世界、教它“做人”的数据。我朋友是卡车司机,他说:“以后送货,车能自己绕过施工区,不用我盯着导航了。”

你猜怎么着?测试时发现个小彩蛋:AI在推理时,会自动识别路标上的emoji。比如看到“⚠️”符号,谨慎系数直接+5%。这细节,绝了。

自动驾驶的终点,从来不是车跑多快。是车能读懂你的心跳,知道你急着接孩子放学、赶着送妈妈看病。当它说“我减速,因为看到你手机亮了”,这安全感,比任何概念车都值。

评论区聊聊:你最想让AI解释啥?是“为啥突然变道”还是“为啥不闯红灯”?点个关注,咱们一起等这车满街跑的那天。