(迷雾中手术:微创介入手术需在复杂的X 光屏幕上,盯住毫米级的微型医疗器械。这就像在暴雨夜的浓雾中驾驶,屏幕布满噪声,血管、骨骼重重遮挡。长期以来,医生不仅要承受高强度的辐射风险,还要靠肉眼和经验进行“盲操”)

微创手术的微型医疗设备在临床转化中,有望推动生物医学工程的变革性发展,可实现更高的手术精度、更小的患者创伤和更快的术后恢复。然而,在实时X射线引导(一种广泛应用的手术成像方式)下,这类设备,在复杂解剖结构中的有效部署仍面临挑战,如成像质量不佳、空间控制困难等问题。人工识别与操作不仅劳动强度大且易出错。同时,基于深度学习的自动化方法因标注的X射线数据集稀缺而发展受限——这源于数据采集成本高昂、标注工作繁琐以及隐私保护约束。

近日,德国马普智能系统所王春翔博士,香港城市大学康文斌教授、美国夏威夷大学王添路教授,土耳其Koc大学Metin Sitti校长等在Nature Machine Intelligence上发文,提出了MicroSyn-X 框架。通过合成生成高保真、像素级精确、自动标注且领域随机化的X射线图像,可训练计算机视觉模型实现微型医疗设备的机器人化远程操控,彻底摒弃人工数据标注流程。

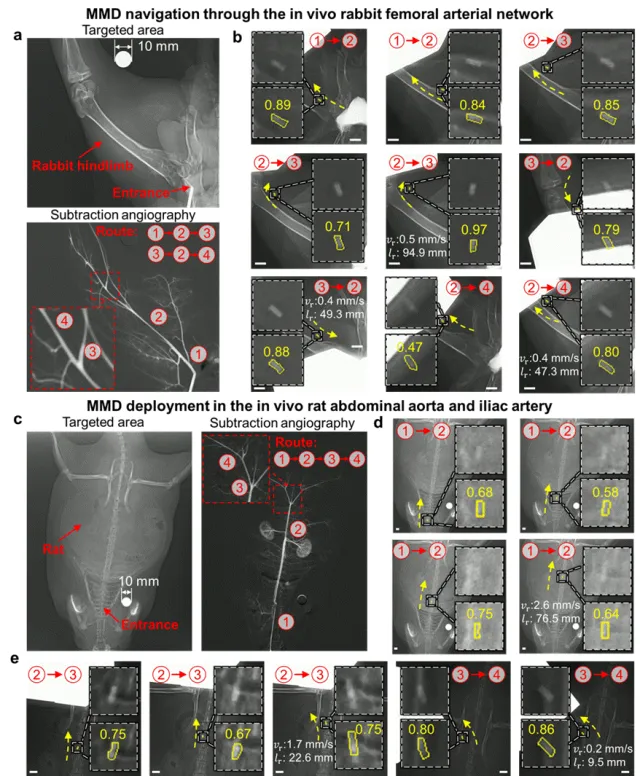

将该框架集成至远程操控机器人系统后,在离体及动态体内环境中,实时定位与导航磁性软体微型设备和磁流控微型设备,在低对比度、高噪声及遮挡等复杂成像条件下,展现出稳健性能。开源了X射线微型设备数据集以建立性能基准。

这项研究,通过攻克数据稀缺难题、实现实时机器人导航,正推动微型设备辅助微创手术迈向下一代精准介入治疗。

第一作者:Chunxiang Wang

通讯作者:Wenbin Kang,Tianlu Wang & Metin Sitti

通讯单位:德国马普智能系统所,夏威夷大学,香港城市大学,土耳其Koc大学

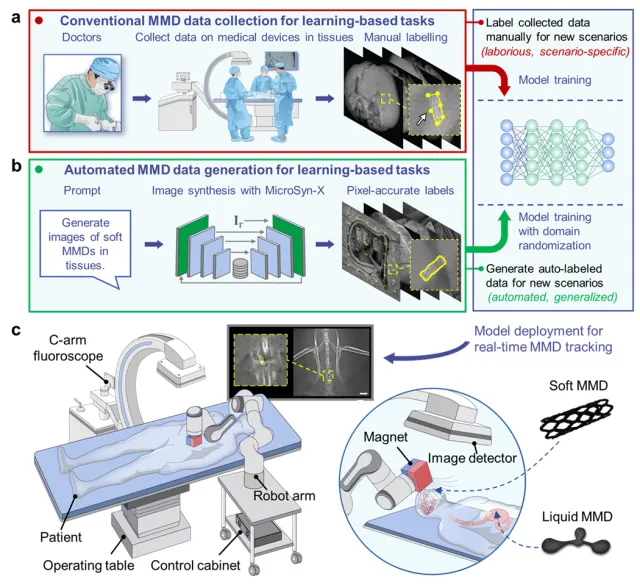

图1 基于合成X光的微型器械追踪与部署

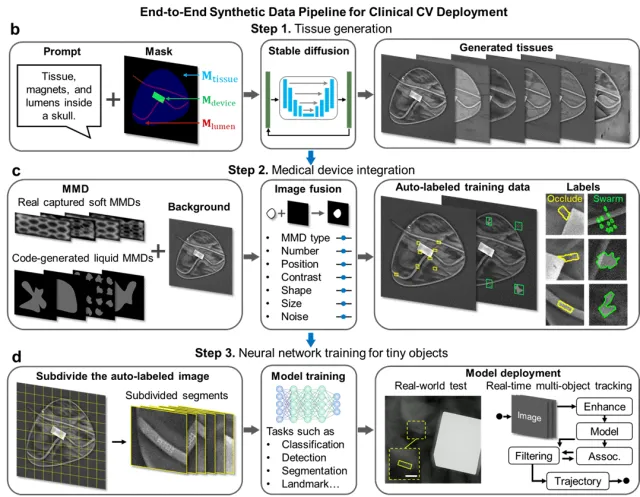

结合了生成式 AI(扩散模型)与强域随机化(Domain Randomization)策略,建立了高保真合成影像生成流程。该框架能够自动生成包含复杂组织背景、骨骼结构及金属器械干预的 X 射线场景,并模拟真实的物理衰减、噪声分布与运动伪影(很多场景是真实世界中难以采集的)。由于合成过程完全可控,系统能够自动生成像素级的精确标注,摆脱了对人工标注数据的依赖。

图2 数据生成流程

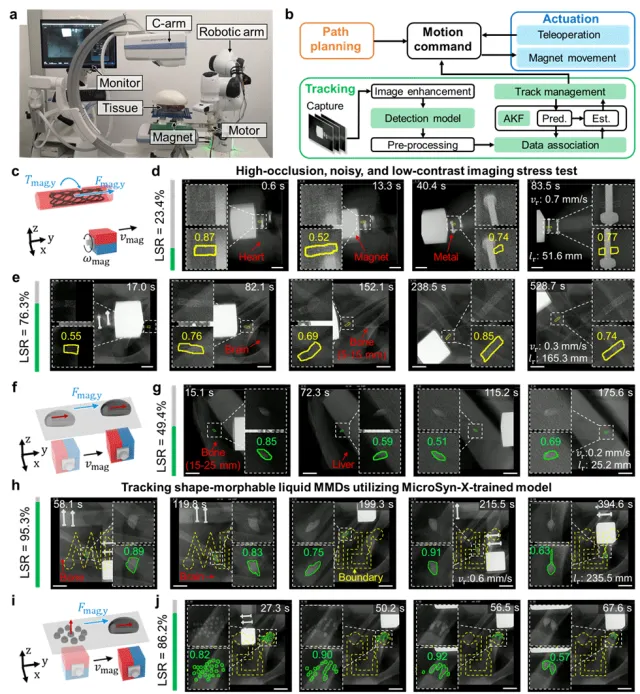

通过“合成数据驱动”训练出的视觉模型,表现出极强的泛化能力。不仅在离体(Ex vivo)组织中运行稳定,在活体小鼠(In vivo)实验中也展现了出色的稳健性。

图3 合成数据驱动的视觉模型与磁驱和x光影像系统的软硬件结合,实现复杂环境下微型医疗器械的鲁棒追踪与控制。

在活体场景下,微型机器人常被脊柱严重遮挡,且受到呼吸、心跳带来的剧烈动态干扰。在这种极低对比度的环境下,MicroSyn-X 训练出的模型依然能够实现实时的鲁棒追踪。测试数据表明,模型的识别结果与临床专家的共识高度一致,在某些极端条件下,模型甚至能捕捉到人眼难以可靠判别的微弱信号。

图4 微型医疗器械在活体动物中的追踪与部署

MicroSyn-X 框架,不再强求采集真实的医生操作数据,而是利用生成式 AI 打造了“高保真 X 光模拟器”。让 AI识别模型 在数百万个合成的、被骨骼和噪声淹没的场景中“疯狂练习”。无需再为每一种新器械长时间积累数据,让精准、低辐射的微创手术成为可能。

核心亮点

·打破数据壁垒: 仅通过高保真合成数据,即可训练出能够胜任真实临床环境(Ex vivo & In vivo)的医疗视觉模型,摆脱对人工标注和海量真实影像的依赖。

·真实手术场景下的高精度鲁棒检测: 在毫米级器械被脊柱严重遮挡、且伴随强烈心跳干扰的极端噪声环境下,实现了比经验医生更稳定、更敏锐的实时追踪。

·即插即用范式:无需重新采集临床数据,数小时合成训练即可实现快速部署。降低了微创器械的应用门槛,缩短从实验室到手术室的距离。

·工程与临床的闭环: 在真实机器人系统和活体动物实验中完成了闭环验证,审稿人“为微型医疗器械的未来医疗应用奠定重要技术基础”的高度评价。

·开源赋能: 代码和数据已开源(Hugging Face )

论文链接:

Wang, C., Kang, W., Sun, M. et al. Synthetic X‑ray‑driven tracking and control of miniature medical devices. Nat Mach Intell (2026). https://doi.org/10.1038/s42256-026-01190-3

课题组投稿,可发送至yuxianglong@cmrs.org.cn,并抄送至chinese_mrs@163.com