港大开源ReconDrive:自动驾驶场景重建的快速前馈4D高斯泼溅

- 2026-05-08 06:20:23

点击下方卡片,关注「3DCV」公众号选择星标,干货第一时间送达

来源:3DCV

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内有20多门3D视觉系统课程、3DGS独家系列视频讲解、顶会论文最新解读、海量3D视觉行业源码、项目承接、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎加入!

论文信息

标题:ReconDrive: Fast Feed-Forward 4D Gaussian Splatting for Autonomous Driving Scene Reconstruction

作者:Haibao Yu, Kuntao Xiao, Jiahang Wang, Ruiyang Hao, Yuxin Huang, Guoran Hu, Haifang Qin, Bowen Jing, Yuntian Bo, Ping Luo

机构:Tuojing Intelligence、The University of Hong Kong、King’s College London、The University of Sydney、Mohamed bin Zayed University of Artificial Intelligenc

原文链接:https://arxiv.org/abs/2603.07552

代码链接:https://github.com/TuojingAI/ReconDrive

导读

高保真度的视觉重建与新型场景的合成,是实现自动驾驶中真实感强、闭环效果良好的评估机制所不可或缺的关键技术。虽然4D高斯散布算法在精度与效率之间取得了理想的平衡,但现有的基于单场景的优化方法需要大量的迭代处理,因此难以应用于复杂的城市环境。而目前的前馈式处理方法则往往会导致图像的质量下降。为了解决这些问题,我们提出了ReconDrive这一前馈式框架。该框架利用并扩展了3D基础模型VGGT,从而实现了快速、高保真的4D高斯散布效果。我们的架构采用了两项创新设计,以便让基础模型能够更好地适应动态驾驶场景:其一为混合高斯预测机制,该机制将空间坐标与外观属性的预测分开处理,从而克服了传统基础模型在处理光度信息时的局限性;其二为静态-动态4D合成技术,该技术通过速度建模来捕捉时间变化,从而更准确地再现复杂的动态环境。在nuScenes测试平台上进行的测试结果显示,ReconDrive在视觉重建、新型场景合成以及3D感知方面均远远优于现有的前馈式算法。其性能可与基于单场景的优化方法相媲美,但处理速度却快了许多倍。因此,ReconDrive为实现真实的驾驶模拟提供了既实用又高效的解决方案。

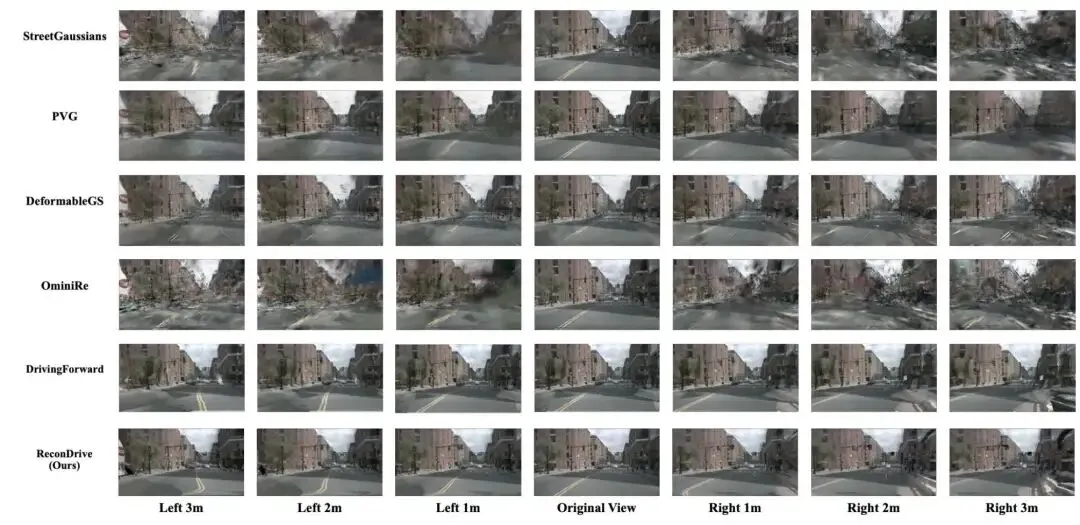

效果展示

Soene 重建与新视图合成效果的视觉对比。与逐场景优化方法(Street Gaussians、PVG、DeformableGSOminiRe)相比,Cur ReconDrive在场景重建(原始视图)和新视图合成(向左和向右移动1-3米)时均保持了高质量的视觉渲染效果。与前馈方法DrivingForward相比,ReconDrive保持了精确的几何一致性一一这在树木和周围环境中都有所体现一一而随着移动距离的增加,性能提升愈发明显。此外,它表现出较少的图像失真和模糊现象,尤其是在图像边界区域。

引言

闭环评估对于端到端自动驾驶日益重要,这要求自车在仿真环境中接收与其动作真实对应的传感器观测数据。基于真实世界多视角图像的视觉场景重建与新视角合成为此类仿真提供了基础。现有方法大致分为三类:导入到游戏引擎(如CARLA)中的资产、基于NeRF或视频扩散的隐式表示、以及显式几何建模。其中,4D高斯泼溅是3D高斯泼溅在时间维度的扩展,能够有效平衡几何精度、光度保真度和实时渲染,因而成为交互式驾驶仿真的理想选择。

然而,传统的4D高斯泼溅方法(如Street Gaussian)依赖于逐场景优化。这些方法通过迭代优化高斯核以最小化渲染损失,通常需要激光雷达先验进行初始化。这种非数据驱动的范式无法利用跨场景的共享结构知识,且每个新环境都会产生巨大的计算开销,限制了可扩展性。相比之下,前馈模型(如VGGT)通过直接生成显式几何,展示了3D基础模型在高效重建方面的潜力。然而,将VGGT扩展到自动驾驶的4D高斯重建面临三个主要挑战。第一是光度信息不足,因为VGGT特征缺乏回归高保真外观属性所需的精细细节。第二是时间静态性,静态主干网络无法表示交通参与者的动态运动。第三是领域与标定不匹配,数据差异导致3D几何预测错误,并且无法利用驾驶数据集中固有的预标定传感器内参和外参。

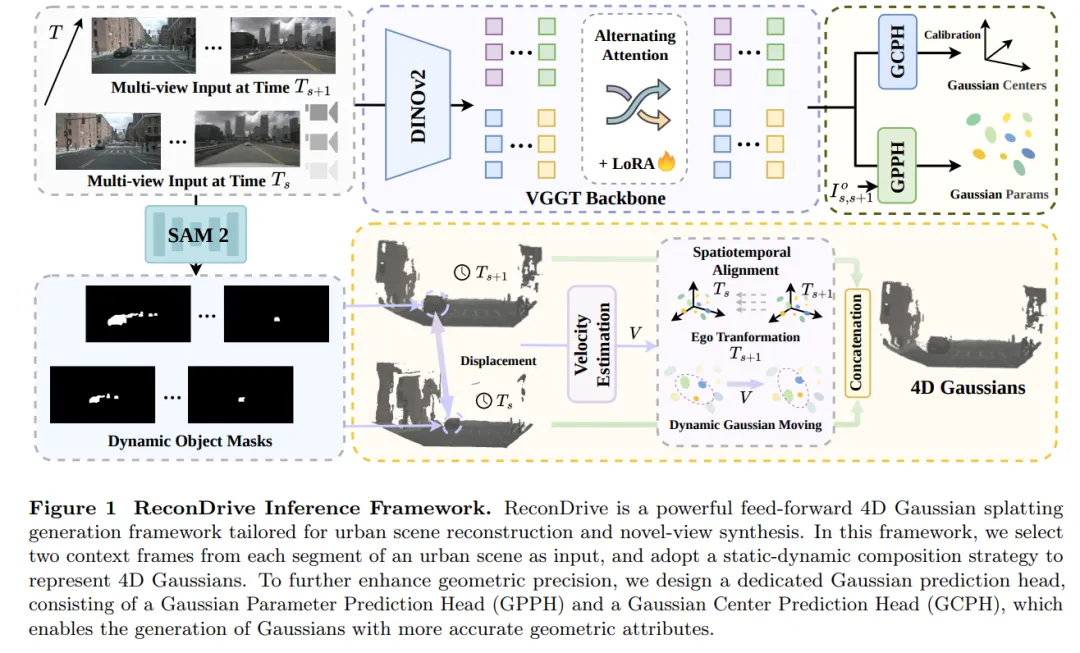

为了解决这些局限,我们提出了ReconDrive,一个仅从视觉输入重建4D高斯泼溅表示的前馈框架。ReconDrive利用预训练的VGGT风格骨干网络直接回归时空高斯参数,无需逐场景优化即可实现大规模高效重建。推理流程基于三个设计支柱。首先,我们采用混合高斯预测头:将原始图像与密集像素级特征拼接,为回归不透明度和球谐系数等外观属性提供所需的光度线索,同时将相机标定直接融入中心头以实现精确的空间定位。其次,我们利用静态-动态4D组合策略,借助SAM2基础模型提取物体掩码,并通过像素级对应关系为动态高斯分配时间速度。第三,我们实现了分段时序融合,通过将场景划分为多个片段并将局部高斯聚类合并为统一的4D表示,来处理长时序驾驶序列中的视角稀疏性问题。整体推理框架如图1所示。在训练过程中,我们冻结VGGT的预训练权重,并应用LoRA对城市驾驶数据进行参数高效微调。我们引入了一种新颖的帧投影损失,以促进针对未见时序视角的稳定几何重建。

为了确保公平比较,我们在nuScenes数据集上建立了一个全面的基准测试,在统一协议下复现了五种具有代表性的优化方法和前馈方法。我们评估了场景重建、新视角合成以及下游任务(如3D目标检测与跟踪)的性能。在该基准测试中,ReconDrive在所有指标上显著优于现有前馈方法,并且在九个类别中有八个类别超越了逐场景优化方法。我们的结果表明,前馈方法能够达到具有竞争力甚至更优的新视角合成性能,同时生成高斯所需的资源大幅减少。这凸显了前馈范式在自动驾驶大规模重建中的巨大潜力。

主要贡献

我们的贡献可总结如下:

• 我们提出了ReconDrive,一个无需逐场景优化即可直接生成4D高斯泼溅的前馈框架,用于重建城市场景并实现跨时间的新视角合成。

• 我们引入了混合高斯预测头、静态-动态组合策略以及分段时序融合表示。结合专门的训练,这些组件使得3D基础模型能够应用于动态城市环境。

• 我们通过在nuScenes上复现典型基线方法,构建了自动驾驶场景重建基准测试。我们的ReconDrive在前馈方法中达到了最先进的性能,并在多个评估协议下与基于优化的基线方法取得了具有竞争力的结果。

方法

ReconDrive是一个强大的前馈4D高斯泼溅生成框架,专为城市场景重建和新视角合成而设计。在该框架中,我们从城市场景的每个片段中选择两个上下文帧作为输入,并采用静态-动态组合策略来表示4D高斯。为了进一步提升几何精度,我们设计了一个专用的高斯预测头,由高斯参数预测头和高斯中心预测头组成,能够生成具有更精确几何属性的高斯。

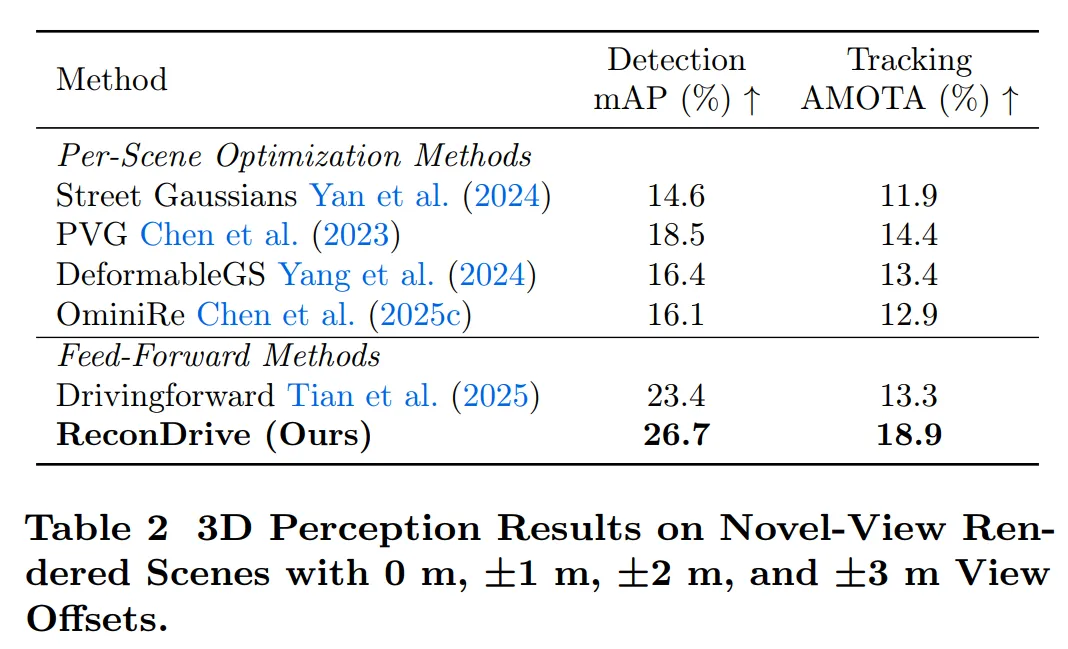

实验结果

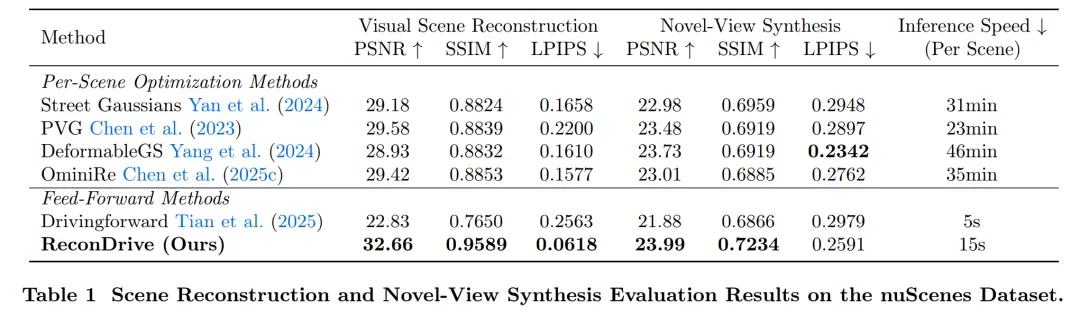

视觉场景重建。如表1所示,逐场景优化方法由于其迭代参数调整而表现出强劲的性能。具体而言,PVG和OminiRe分别达到了最高的PSNR(29.58)和最高的SSIM(0.8853),而DeformableGS在LPIPS上领先。相比之下,现有的前馈基线方法明显落后(例如Drivingforward的PSNR为22.83),凸显了可泛化重建与特定场景重建之间的传统性能差距。ReconDrive有效弥合了这一差距。它在像素、结构和感知指标上均优于所有基线,取得了32.66的PSNR、0.9589的SSIM和0.0618的LPIPS的卓越表现。

新视角合成评估。如表1所示,逐场景优化方法在新视角合成上通常优于先前的前馈基线,因为迭代参数调整能更好地捕捉复杂的视角依赖变化。例如,DeformableGS和Street Gaussians的PSNR分别为23.73和22.98,而前馈方法Drivingforward仅达到21.88。ReconDrive有效弥合了效率与质量之间的性能差距,为前馈4D高斯泼溅树立了新的标杆。在与最佳基线保持相当感知质量(LPIPS)的同时,ReconDrive在PSNR上显著超过DeformableGS达0.26 dB,在SSIM上超过0.0315。此外,ReconDrive相比现有前馈方法取得了大幅提升,在PSNR上超过Drivingforward达2.11 dB,在SSIM上超过0.0368,同时感知误差(LPIPS)显著降低了0.0388。这些结果证明,ReconDrive不仅消除了推理速度与合成质量之间的传统权衡,而且为复杂城市场景中的新视角生成提供了更优的结构和感知一致性。

总结 & 未来工作

开发高效且可扩展的场景重建方法是自动驾驶行业构建闭环评估与仿真平台的基石需求。在本文中,我们提出了ReconDrive,一个专为大规模驾驶场景设计的高效4D高斯泼溅生成前馈框架。与需要大量计算资源的现有逐场景优化方法不同,我们的模型通过单次前向传播即可生成完整的场景表示。这一效率是通过静态-动态组合策略和分段高斯聚合实现的,并结合我们专门设计的高斯预测架构,有效地适配了3D基础模型。

在我们基于nuScenes的新基准测试上的实验结果表明,ReconDrive在几乎所有的评估指标上都优于最先进的逐场景优化基线。据我们所知,这项工作首次通过全面的实验证明了前馈方法在重建和新视角合成性能上能够超越基于优化的方法。这些发现为开发面向大规模自动驾驶的可扩展、生成式仿真环境提供了明确的方向和新的信心。

对更多实验结果和文章细节感兴趣的读者,可以阅读一下论文原文~

本文仅做学术分享,如有侵权,请联系删文。

3D视觉方向论文辅导来啦!可辅导SCI期刊、CCF会议、本硕博毕设、核心期刊等。

添加微信:cv3d001,备注:姓名+方向+单位,邀请入群。