计算机 | 北航团队发布自动驾驶3D占据预测综述,系统梳理三大技术路线与未来趋势

- 2026-03-21 01:38:37

FCS“优秀青年计算机科学家论坛”于2019年启动,以尊重科学贡献、传播更多优秀成果为宗旨。论坛作者审视自己的研究领域,介绍研究方向和研究进展。本论坛所有文章均为特邀稿件。

本期“优秀青年计算机科学家论坛”推出北京航空航天大学黄迪教授团队的成果——自动驾驶3D占据预测综述,系统梳理三大技术路线与未来趋势。

作者简介

黄迪,北京航空航天大学教授。长期从事计算机视觉、模式识别、具身智能方向基础理论与关键技术的研究工作,具体内容涉及通用视觉模型构建与适配、多模态视觉感知(二维/三维目标检测与识别、视觉抓取)、视觉生成、生物特征识别及情感计算等。

引用格式:

Yanan ZHANG, Jinqing ZHANG, Zengran WANG, Junhao XU, Di HUANG. Vision-based 3D occupancy prediction in autonomous driving: a review and outlook. Front. Comput. Sci., 2026, 20(1): 2001301 DOI:10.1007/s11704-024-40443-5阅读原文:

摘要

北京航空航天大学研究团队发表基于视觉的自动驾驶3D占据预测综述,系统总结特征增强、部署友好和标签高效三类方法,并分析从2D到3D特征转换困难、体素计算负载高等瓶颈。文章指出,3D占据预测以体素方式构建细粒度场景结构,为识别不规则障碍物提供更稳健方案,并展望结合数据生成和世界模型的发展方向,对构建低成本、高精度感知系统具有参考价值。

文章精要

北京航空航天大学软件开发环境国家重点实验室团队发布了关于视觉驱动的3D占据预测技术的全面综述,回顾该领域的重要进展并讨论未来发展趋势。

在自动驾驶感知中,传统3D目标检测依赖“3D边界框”,只能粗略描述物体外形,对施工障碍、倒木等不规则物体常力不从心。3D占据预测以体素网格描述空间,为每个小单元判断占据状态及语义类别,如同用积木构建周围世界,具备更精细的空间表达能力,可显著提升系统对异形、未知类别障碍物的识别能力。

弥补传统视觉感知在复杂物体识别上的不足

传统边界框方法依赖物体的整体外轮廓,对植被、碎石等长尾障碍物覆盖不足,也难以提供背景区域信息。3D占据预测提供细粒度三维场景结构,更适用于开放道路环境,能够为自动驾驶决策模块提供更全面、更鲁棒的环境理解,是构建低成本视觉感知系统的重要技术路径。

三大技术路线与关键挑战

本文对该领域的现有研究进行了详尽的分类和性能对比,揭示了当前技术方法的三大方向:

特征增强型:通过 BEV、TPV 或直接体素特征缓解2D向3D映射中的信息损失;

部署友好型:以视角分解或粗到细预测策略减少体素计算成本;

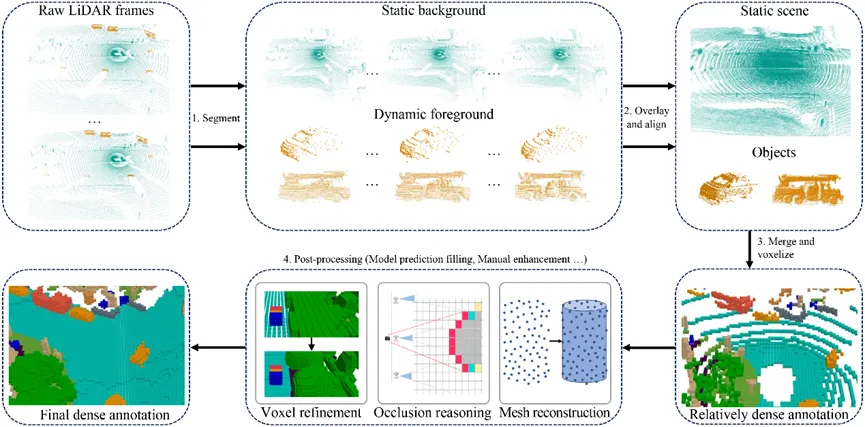

标签高效型:利用NeRF渲染进行自监督或跨模态蒸馏降低3D标注需求。

基于 SemanticKITTI、Occ3D-nuScenes 等数据集的对比显示,特征增强方法如 FB-OCC 的 mIoU 可达52.79%,展现视觉感知上限;部署友好方法如 FlashOcc 在牺牲部分精度的情况下提供更高推理速度。

综述指出,三类方法均面临三大核心瓶颈:2D图像缺乏深度信息导致的3D恢复难度、体素计算带来的巨大运算开销,以及细粒度标注的高成本。

技术全景与路线演进

综述进一步分析不同框架的工作机制。特征增强方法提升空间表达;部署友好方法通过分解或多阶段预测提高效率;标签高效方法则引入生成式渲染与跨模态知识,推动模型以更少标注学习高质量场景结构。多路技术共同推进3D占据预测向更精准、高效、经济的方向演进。

未来展望:迈向数据生成与4D预测时代

文章指出,未来研究将沿两条方向发展:其一是将AIGC用于可控数据生成,弥补真实数据不足;其二是将3D占据扩展为4D时空表征,通过世界模型预测场景动态变化,为自动驾驶提供更前瞻的环境理解。这些方向有望成为下一代感知系统的重要基础。

期刊简介

Frontiers of Computer Science (FCS)是由教育部主管、高等教育出版社和北京航空航天大学共同主办,南京大学支持,SpringerNature 公司海外发行的英文学术期刊。本刊于 2007 年创刊,月刊,全球发行。主要刊登计算机科学领域具有创新性的综述论文、研究论文等。本刊主编为周志华院士,共同主编为熊璋教授。编委会及青年 AE 团队由国内外知名学者及优秀青年学者组成。本刊被 SCI、Ei、DBLP、INSPEC、SCOPUS 和中国科学引文数据库(CSCD)核心库等收录,为 CCF 推荐B类期刊;两次入选“中国科技期刊国际影响力提升计划”;入选“第4届中国国际化精品科技期刊”;两次入选“中国科技期刊卓越行动计划”(一期梯队、二期领军)。

往期目录

2026 No.2

2026 No.1

2025 No.12

2025 No.11

2025 No.10

2025 No.9

2025 No.8

2025 No.7

2025 No.6

2025 No.5

2025 No.4

2025 No.3

2025 No.2

2025 No.1

2024 No.6

2024 No.5