什么是自动驾驶四要素?感定规控

- 2026-05-02 08:22:49

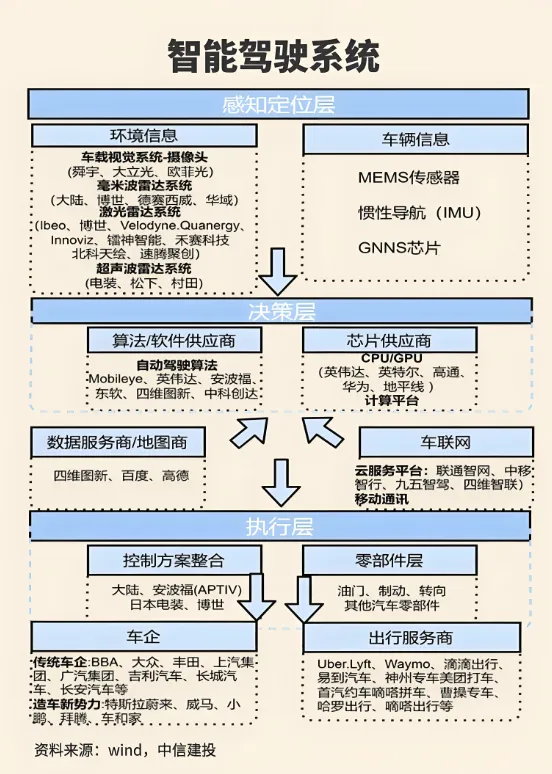

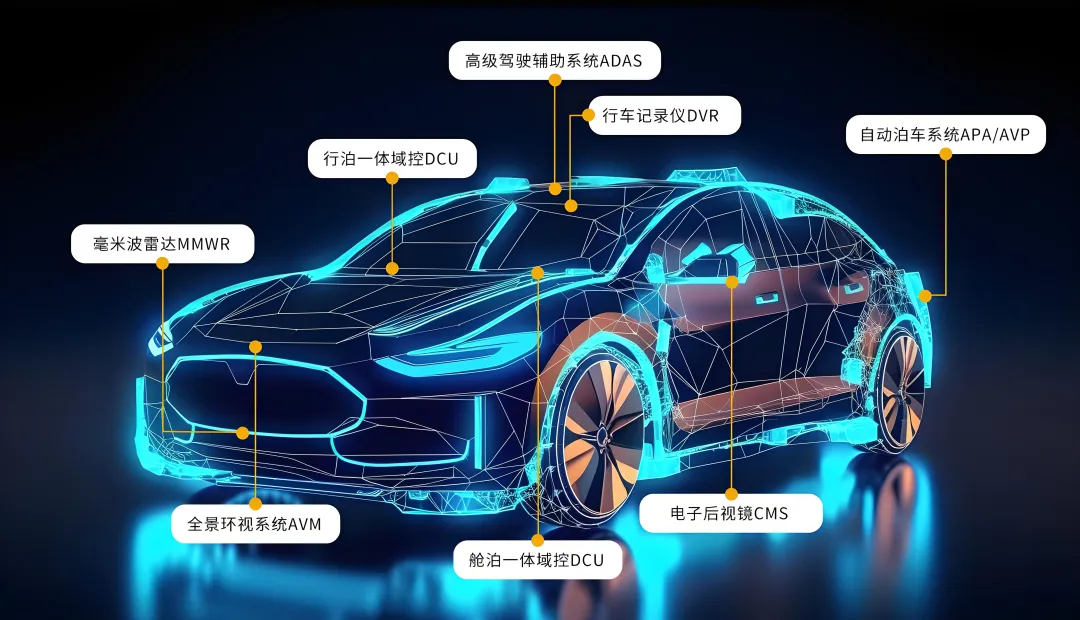

一、感知模块:环境信息的实时获取与处理

1. 功能定义与核心任务

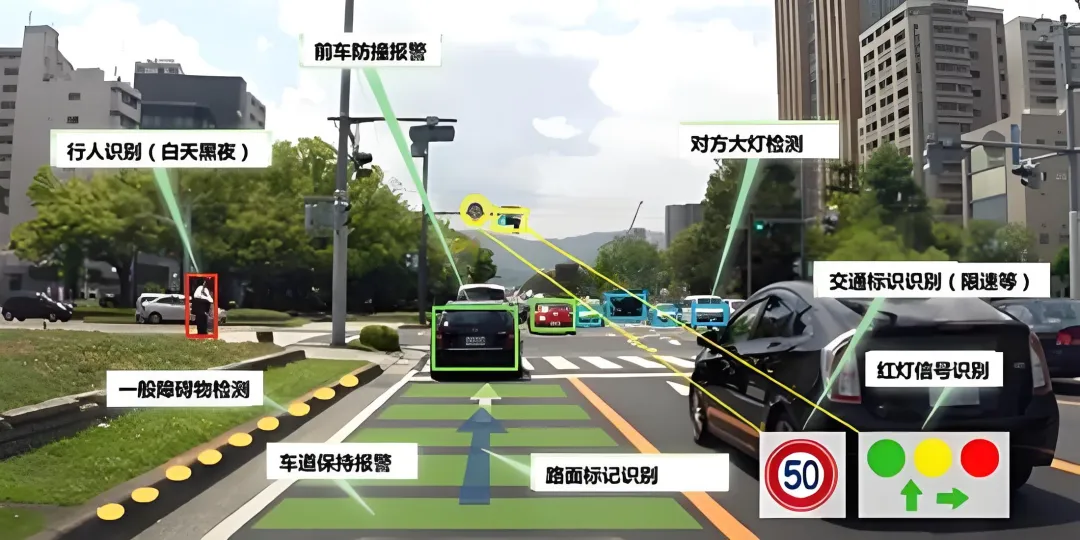

感知模块是智能驾驶系统的“感官”,负责通过传感器实时捕捉车辆周围环境信息,包括道路结构、障碍物、交通标志、行人等。其核心任务包括:

目标检测与分类:识别车辆、行人、自行车等动态障碍物。

语义分割:区分道路、车道线、路肩、绿化带等静态元素。

运动状态估计:计算目标物体的速度、加速度及运动轨迹。

多传感器融合:整合不同传感器数据,提升感知精度与鲁棒性。

2. 技术路线与传感器配置

2.1 主流传感器类型及特性

2.2 多传感器融合策略

前融合(Early Fusion):在原始数据层进行融合,如将激光雷达点云与摄像头图像像素级对齐。

技术实现:标定传感器外参(旋转矩阵与平移向量),应用卡尔曼滤波或深度学习模型(如PointPainting)进行数据关联。

优势:保留原始信息完整性,提升小目标检测能力。

后融合(Late Fusion):各传感器独立处理数据后,在目标级进行融合。

技术实现:匈牙利算法匹配不同传感器的检测结果,加权投票确定最终目标属性。

优势:计算资源需求低,容错性强。

2.3 深度学习在感知中的应用

目标检测模型:

Two-Stage模型:Faster R-CNN通过区域建议网络(RPN)生成候选框,再分类与回归。

One-Stage模型:YOLO(You Only Look Once)直接输出目标位置与类别,实时性更优。

语义分割模型:

U-Net:编码器-解码器结构,跳跃连接保留细节信息,适用于道路分割。

DeepLab系列:采用空洞卷积扩大感受野,精准识别复杂场景。

多任务学习:

MTL(Multi-Task Learning):共享骨干网络,并行输出检测、分割、深度估计结果,提升计算效率。

3. 极端场景处理技术

恶劣天气补偿:

激光雷达:采用1550nm波长提升雨雾穿透性,点云滤波算法(如DBSCAN)去除噪声。

摄像头:HDR成像+去雾算法(如暗通道先验)增强图像质量。

动态遮挡应对:

轨迹预测:基于LSTM网络预测被遮挡物体的运动路径。

概率占据栅格:构建栅格地图并计算每个栅格的障碍物存在概率。

二、定位模块:高精度位置与姿态确定

1. 功能定义与精度要求

定位模块需实现:

绝对定位:车辆在地球坐标系中的经纬度(误差<10cm)。

相对定位:相对于车道、交通标志的局部位置(误差<5cm)。

姿态估计:航向角、俯仰角、横滚角(误差<0.1°)。

2. 技术路线与核心算法

2.1 多源定位技术融合

2.2 高精度定位算法

卡尔曼滤波(KF/EKF):

线性卡尔曼滤波:适用于高斯线性系统,融合GNSS与IMU数据。

扩展卡尔曼滤波(EKF):处理非线性系统,如车辆运动模型。

粒子滤波(PF):

用大量粒子表示概率分布,适用于多模态定位问题(如路口歧义)。

图优化(Graph Optimization):

因子图:将GNSS、IMU、视觉观测作为约束节点,批量优化位姿。

2.3 高精度地图匹配

地图特征:

语义图层:车道线、交通标志、红绿灯位置。

几何图层:道路曲率、坡度、高程。

匹配算法:

ICP(迭代最近点):激光雷达点云与地图点云配准。

NDT(正态分布变换):将地图表示为概率分布,提升匹配效率。

3. 典型挑战与解决方案

隧道/城市峡谷效应:

多传感器冗余:IMU+轮速+视觉里程计构成紧耦合系统。

预存地图辅助:通过激光SLAM提前构建隧道内地图。

动态环境干扰:

动态物体过滤:结合感知模块输出,移除移动障碍物对定位的影响。

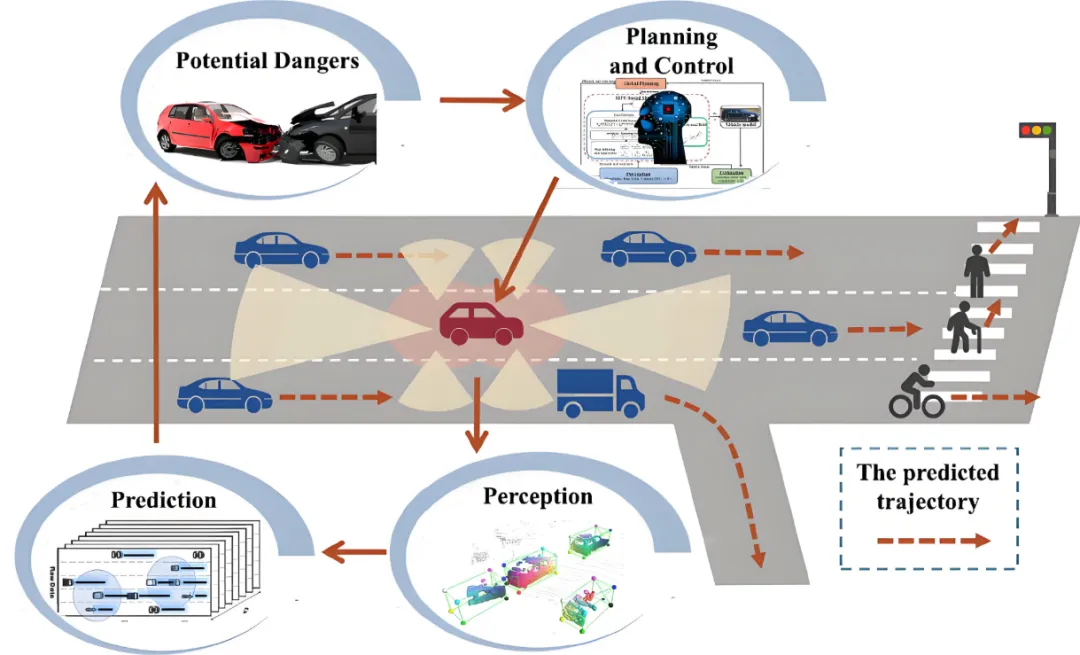

三、规划模块:安全高效的路径生成

1. 功能层次划分

全局路径规划:

基于高精度地图,规划起点到终点的最优路线(考虑拥堵、限速、能耗)。

局部行为决策:

确定超车、跟车、换道等策略,符合交通规则与驾驶礼仪。

运动轨迹生成:

生成平滑、动力学可行的具体路径。

2. 技术路线与算法实现

2.1 全局路径规划

图搜索算法:

A*:启发式搜索,平衡效率与最优性,适合道路网络。

Dijkstra:保证最优解,但计算量较大。

机器学习方法:

强化学习(RL):通过仿真训练选择最小时间/能耗路径。

2.2 行为决策

有限状态机(FSM):

定义“跟车”、“换道”、“超车”等状态及转移条件。

博弈论模型:

预测其他交通参与者行为,求解纳什均衡策略。

深度学习:

LSTM+Attention:建模多车交互,输出决策概率分布。

2.3 轨迹生成

多项式曲线:

五次多项式:满足位置、速度、加速度连续性约束。

最优控制:

LQR(线性二次调节器):最小化跟踪误差与控制量。

采样优化:

*RRT(快速探索随机树)**:在复杂障碍环境中生成可行路径。

3. 场景化优化策略

高速巡航:

采用恒定速度模型,保持安全车距(时间间隔2-3秒)。

拥堵跟车:

IDM(智能驾驶员模型)调节加速度,减少急刹。

紧急避障:

TTC(碰撞时间)计算,触发最大减速度(>0.8g)。

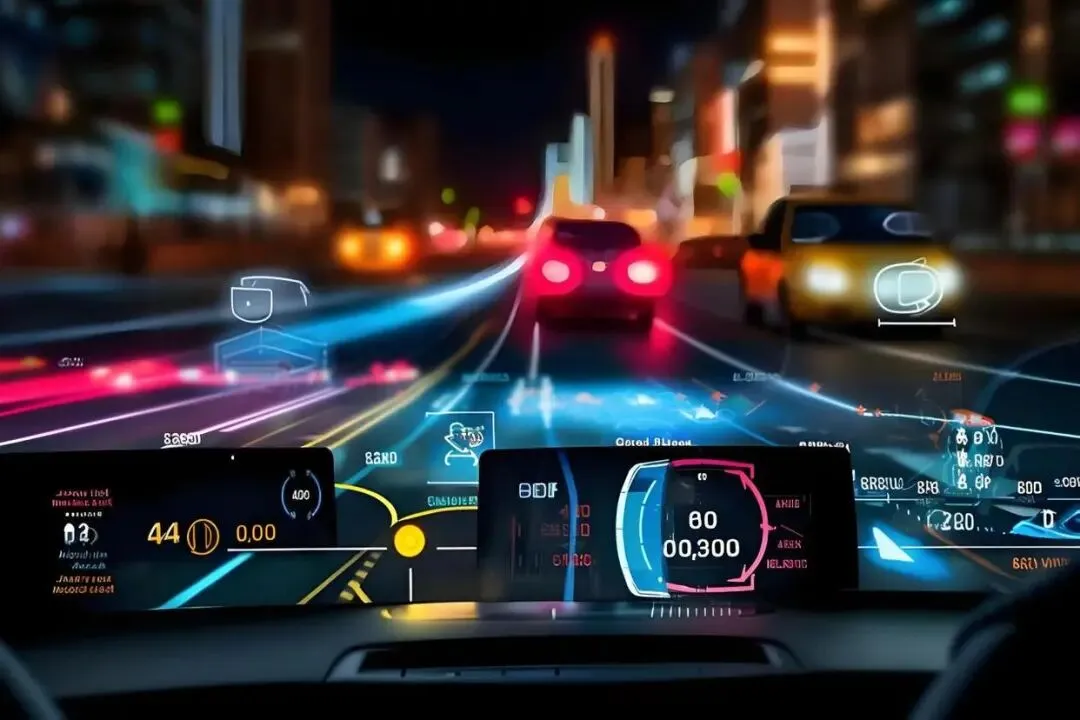

四、控制模块:精准执行规划指令

1. 功能分解

纵向控制:调节油门与刹车,实现速度跟踪。

横向控制:控制转向角,保持路径跟踪精度。

横纵向协同:解决过弯速度与转向的耦合关系。

2. 控制算法与技术实现

2.1 经典控制方法

PID控制:

比例项(P):快速响应误差。

积分项(I):消除稳态误差。

微分项(D):抑制超调。

局限:参数调优困难,非线性系统适应性差。

2.2 现代控制理论

模型预测控制(MPC):

建立车辆动力学模型,滚动优化未来数步控制量。

优势:显式处理约束(如轮胎摩擦圆)。

滑模控制(SMC):

设计滑模面,强制系统状态沿预定轨迹运动。

特点:强鲁棒性,适合不确定扰动场景。

2.3 车辆动力学模型

自行车模型:

简化转向几何关系,适用于低速场景。

公式:δ=LR+K⋅eδ=RL+K⋅e其中,δ为前轮转角,L为轴距,R为转弯半径,e为横向误差,K为控制增益。

二自由度模型:

考虑横摆与侧向运动耦合,表达式:{m(v˙y+vxψ˙)=Fyf+FyrIzψ¨=lfFyf−lrFyr{m(v˙y+vxψ˙)=Fyf+FyrIzψ¨=lfFyf−lrFyrm为质量,vx,vyvx,vy为纵向/侧向速度,ψ为横摆角,Fyf,FyrFyf,Fyr为前/后轮侧向力。

3. 执行器接口与容错设计

线控系统:

线控转向(SBW):无机械连接,响应延迟<50ms。

线控制动(BBW):电信号触发液压/电机制动,建压时间<150ms。

冗余设计:

双ECU架构,主控制器失效时备用系统接管。

制动系统保留机械冗余(如电子+液压双回路)。

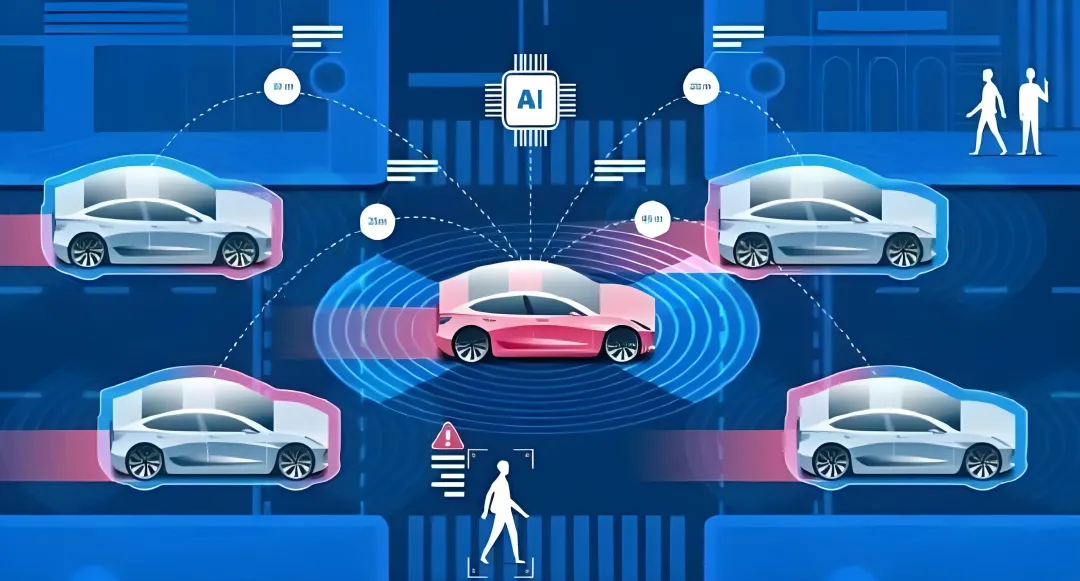

五、四大模块协同工作机制

1. 数据流与实时交互

感知→定位:提供动态障碍物位置,辅助定位模块排除干扰。

定位→规划:输出车辆位姿,作为路径规划的初始条件。

规划→控制:下发轨迹点序列(位置、速度、曲率)。

控制→感知/定位:反馈执行状态(如实际转向角),用于闭环校正。

2. 典型场景协同案例

2.1 城市道路行人避让

感知:摄像头检测到前方10米有行人横穿,激光雷达确认距离。

定位:结合高精地图,确定车辆处于人行道前50米。

规划:决策紧急制动,生成减速度曲线与绕行轨迹。

控制:线控制动系统触发最大减速度,同时微调转向避免碰撞。

2.2 高速公路自动变道

感知:毫米波雷达探测相邻车道后车距离120米,速度匹配。

定位:确认车辆处于高速中央车道,允许变道。

规划:计算最佳变道时机,生成五次多项式过渡轨迹。

控制:MPC控制器协调转向与油门,平滑完成变道。

3. 系统级挑战与优化方向

时序同步:各模块采用PTP(精确时间协议)对齐时间戳,误差<1ms。

资源分配:域控制器(如英伟达Orin)动态分配算力,确保实时性。

功能安全:ISO 26262 ASIL-D认证,单点故障覆盖率>99%。

六、技术发展趋势与行业展望

1. 感知:多模态融合与边缘计算

4D成像雷达:增加高度维度信息,分辨率提升至0.1°。

光子芯片激光雷达:固态化、低成本化(目标<$500)。

车载超算:算力向2000TOPS迈进,支持Transformer大模型部署。

2. 定位:众包建图与量子导航

Crowdsourcing HD Maps:通过量产车实时更新地图,鲜度<1小时。

量子惯性导航:基于冷原子干涉仪,定位精度厘米级/小时。

3. 规划:类脑决策与群体智能

神经符号系统:结合深度学习与知识推理,处理长尾场景。

V2X协同规划:车辆编队通行效率提升30%,能耗降低15%。

4. 控制:全驱全转向与预见性控制

轮毂电机:独立控制每个车轮扭矩,实现坦克转向。

云控平台:基于5G上传路况,提前调整控制参数

总而言之这四大技术形成一个紧密的闭环:

感知系统 实时扫描周围环境,识别出“前方50米有辆慢车”。

定位系统 同时确认“我正行驶在中间车道,位置精确到厘米”。

规划系统 接收到以上信息后,做出决策:“需要向左变道以超车”。随后,它计算出一条安全、平滑的变道轨迹。

线控系统 接收到变道轨迹指令,精确地控制转向、驱动和制动系统,协同完成变道动作。

在整个过程中,这个循环以极高的频率(每秒数十次)不断重复,确保车辆能够安全、平稳、智能地应对各种复杂的交通场景。