自动驾驶汽车的“道德双标”:我们竟要求AI比人类更“护主”?

- 2026-05-08 18:24:36

📚 期刊:Cognition 254 (2025) 106011

🌐 DOI:10.1016/j.cognition.2024.106011

🏷️ 英文标题:Morality on the road: Should machine drivers be more utilitarian than human drivers?

👥 作者:Peng Liu, Yueying Chu, Siming Zhai, Tingru Zhang, Edmond Awad(浙江大学、天津大学、深圳大学、牛津大学、埃克塞特大学、马克斯·普朗克人类发展研究所)

如果一辆自动驾驶汽车必须在撞死一个路人和撞死自己的乘客之间做选择,它应该怎么做?如果换成人类司机呢?一项跨越6个研究、近7000名被试的大型心理学实验发现:作为旁观者,我们对人类司机和AI司机竟然持有双重标准——我们更愿意原谅人类司机保护自己,却要求自动驾驶汽车必须“忠于”乘客。背后的原因,颠覆了我们的直觉。

🧭 问题背景:机器司机该比人类更“功利”吗?

随着自动驾驶汽车(AV)即将上路,一个经典的道德困境摆在我们面前:当事故不可避免时,AV应该牺牲谁?是保护车内乘客,还是牺牲一个乘客去救更多行人?

以往研究多从用户视角出发,发现消费者希望自己的AV更“自私”(Gill, 2020)。但作为旁观者(公众、政策制定者),我们是否也持同样的立场?从“无知之幕”的公正立场出发,旁观者或许会要求AV比人类司机更功利、更无私。然而,本研究的发现恰恰相反:旁观者竟然也要求AV更“护主”——而且这种“双标”背后,是因为人们将AV视为乘客的“仆人”。

🧪 研究框架与方法概览

研究共包含6个主要研究(10个实验),所有数据均在中国收集,总样本量。所有实验均采用情景模拟、被试间设计。

核心因变量:

道德规范(prospective moral norm):你认为司机【应该】怎么做?(二选一:直行/变道)

道德判断(retrospective moral judgment):司机实际做出某个决定后,你认为它在多大程度上是道德的(10分量表,3项,改编自Scheutz & Malle, 2021)

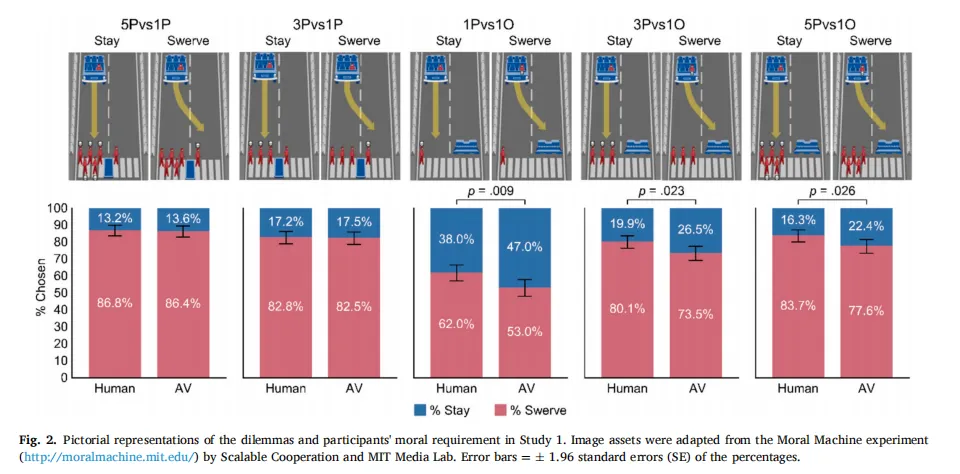

典型情景(如图2所示):

行人困境:直行撞5/3个行人,变道撞1个行人(车内无人受伤)

乘客困境:直行撞1/3/5个行人,变道牺牲车内1名乘客(人类司机即自牺牲)

统计方法:

卡方检验(比较二选一比例)

双因素/三因素方差分析

中介分析(PROCESS Model 4,5000次Bootstrap)

敏感度分析保证统计功效(检测小效应量 的power达80%)

📊 核心发现:从“对称”到“非对称”的转折

研究1:道德规范——行人困境对称,乘客困境非对称

设计:2(Agent:人类司机 vs. AV)× 5种困境(2个行人困境 + 3个乘客困境),844人。

结果(图2):

行人困境中:>80%的人要求两种司机都变道救更多人,无显著差异(对称)。

乘客困境中:要求AV变道牺牲乘客的比例显著低于要求人类司机自牺牲的比例(例如1Pvs1O:53.0% vs. 62.0%)。机械司机被要求更“护主”。

补充研究 S1(预注册)将功利行为改为不作为(即直行牺牲乘客),结果一致:人们依然更不愿意要求AV牺牲乘客。

研究2 & 3:道德判断——同样的牺牲,判断更严

设计:研究2为审慎决策(司机“决定”怎么做),研究3为随机决策(“随机选择”怎么做)。均为2×2×2(Agent × 困境 × 决策)被试间。

结果(图3):

当司机选择变道牺牲乘客时,AV的决定被评价为更不道德(人类司机 vs. AV,评分差约2分)。

当司机选择直行牺牲行人时,两者评价无差异。

随机决策(研究3)与审慎决策结果一致,排除决策风格干扰。

研究4:乘客能动性——不是中介

假设:AV乘客无法控制车辆,因此人们更倾向于保护他们。

设计:研究4a测量乘客的可控性感知(3项,7分量表,改编自Jörling et al., 2019),同时测量道德规范和道德判断。研究4b仅聚焦牺牲乘客的决策,再做一次中介检验。

结果:

人类司机被感知为更高可控性(5.39 vs. 3.47)

但在道德规范上,可控性未起中介作用(间接效应CI包含0)。

在道德判断上,研究4a发现可控性起完全中介;但研究4b(用标准道德判断量表)未发现显著中介(CI包含0)。结论:乘客能动性不是稳定解释。

研究5:牺牲的自愿性——也不是解释

假设:人类司机是自愿牺牲自己,而AV乘客是非自愿——这可能是人们双重标准的原因。

设计:引入两个新条件——远程人类司机(远程操控,自己不受伤)和同车人类司机(有乘客,自己不受伤)。共4种Agent(Only‑H, R‑H, I‑H, AV)。

结果(图5C):

无论是人类司机还是AV,只要是为乘客做决定(即非自愿牺牲),人们都更倾向于保护乘客。但AV仍然比人类司机更被要求保护乘客(例如3Pvs1O中,67.9%要求AV保护乘客,而仅58.9%要求I-H保护乘客)。

人类的“非自愿牺牲”并不能完全解释AV的“护主优势”。

研究6:社会关系——机器是“仆人”

核心机制验证。

研究6a:测量感知到的仆人关系(1项,10分量表,改编自Kim & Kramer, 2015)。同时测量道德规范和公平/正义/背叛感知(后发现无差异)。

结果(图6):

AV被感知为更“仆人”(6.74 vs. 5.50)。

仆人关系显著中介了Agent对道德规范的影响(间接效应,95% CI [−0.70, −0.23])。

研究6b(预注册):操纵AV的仆人角色。在AV‑as‑servant条件,告知被试“AV应当服务乘客、优先保障乘客安全”;控制组无此描述。

结果:

操纵组中更多人要求AV保护乘客(37.8% vs. 27.7%)。

虽然操纵对测量到的仆人关系未达显著(可能因天花板效应),但内部分析显示:要求AV保护乘客的人,其仆人感知显著更强(7.71 vs. 5.63)。

结论:人们视AV为乘客的“仆人”,因此要求它无条件优先保护乘客——这是道德双重标准的根本心理机制。

💡 核心启示:为什么这个发现很重要?

打破“无知之幕”直觉

按照罗尔斯的“无知之幕”推理,公正的旁观者应要求AI更无私、更功利。但实验证明,旁观者反而要求AV更“护主”——这意味着“公正立场”在人与机器的关系中并不成立。人机关系决定道德期待

我们把人类司机视为平等的伙伴,所以接受他“自私”一点(保护自己)。但把AV视为仆人,所以要求它“绝对忠诚”——即使牺牲自己也要保护主人。这揭示了社会角色认知对机器伦理的深刻影响。用户与公众罕见达成共识

此前Gill(2020)发现用户希望自己的AV自私;本研究则发现旁观者也要求AV“护主”。两个关键群体在“AV应该偏向乘客”上竟然意见一致,这对政策制定者而言是重要信号——设计“自私”的AV可能比设计“无私”的AV更能被社会接受。

🚥 实践与政策启示

对齐问题不只要模仿人类:AV不能简单复制人类司机的道德直觉。在某些情境下,AV需要被明确赋予“偏向乘客”的道德规则,即使这与纯粹功利主义相悖。

沟通社会角色:如果制造商将AV宣传为“忠实仆人到你的安全管家”,公众可能更容易接受其“自私”行为。反之,若宣扬“公正无私的AI”,反而会引发道德愤怒。

进一步验证:本研究仅在中国进行。文化差异(如个人/集体主义)可能影响“仆人”隐喻的接受度,需跨文化复制。

⚠️ 局限与未来方向

电车困境的生态效度:假想情景与现实驾驶仍有距离,未来可引入更真实的模拟驾驶实验。

单一文化样本:中国被试对“仆人”角色的接受度可能高于西方平等主义文化,需跨文化比较。

未测试的机制:心智感知(如Gray et al., 2007)也可能解释双重标准,未来可将“仆人关系”与“心智赋予”模型整合。

英文文献阅读全流程:从文献如何“搜”到怎么“管”再到“读”的一站式攻略

END

点击关注,发送 "消费者道德" 即可获取全文PDF